初识人工智能,一文读懂贝叶斯优化进阶的知识文集(7)

![]()

作者简介,普修罗双战士,一直追求不断学习和成长,在技术的道路上持续探索和实践。

多年互联网行业从业经验,历任核心研发工程师,项目技术负责人。

欢迎 点赞✍评论⭐收藏

人工智能领域知识

| 链接 | 专栏 |

|---|---|

| 人工智能专业知识学习一 | 人工智能专栏 |

| 人工智能专业知识学习二 | 人工智能专栏 |

| 人工智能专业知识学习三 | 人工智能专栏 |

| 人工智能专业知识学习四 | 人工智能专栏 |

| 人工智能专业知识学习五 | 人工智能专栏 |

| 人工智能专业知识学习六 | 人工智能专栏 |

| 人工智能专业知识学习七 | 人工智能专栏 |

| 人工智能专业知识学习八 | 人工智能专栏 |

| 人工智能专业知识学习九 | 人工智能专栏 |

初识人工智能领域(贝叶斯优化进阶)

一、贝叶斯优化进阶(1)

01. 贝叶斯优化和梯度下降的区别是什么?

贝叶斯优化和梯度下降都是优化算法,但它们有不同的优点和缺点。

贝叶斯优化

贝叶斯优化是一种基于贝叶斯统计的优化算法。它使用贝叶斯方法来计算目标函数的概率分布,并使用该分布来指导优化过程。贝叶斯优化的一个优点是它可以处理非凸问题。

梯度下降

梯度下降是一种基于梯度的优化算法。它使用目标函数的梯度来计算下一步的搜索方向。梯度下降的一个优点是它很简单,易于实现。

贝叶斯优化和梯度下降的区别

以下是贝叶斯优化和梯度下降的一些区别:

- 贝叶斯优化可以处理非凸问题,而梯度下降不可以。

- 贝叶斯优化需要更长的时间来收敛,而梯度下降更快。

- 贝叶斯优化需要更多的计算资源,而梯度下降更少。

总结

贝叶斯优化和梯度下降都是优化算法,但它们有不同的优点和缺点。贝叶斯优化可以处理非凸问题,但需要更长的时间来收敛,并且需要更多的计算资源。梯度下降更简单,易于实现,并且更快,但它不能处理非凸问题。

以下用表格说明其两者区别:

| 贝叶斯优化 | 梯度下降 |

|---|---|

| 使用贝叶斯方法来计算目标函数的概率分布 | 使用目标函数的梯度来计算下一步的搜索方向 |

| 可以处理非凸问题 | 不能处理非凸问题 |

| 需要更长的时间来收敛 | 更快 |

| 需要更多的计算资源 | 更少 |

02. 什么是贝叶斯优化的收敛性?

贝叶斯优化的收敛性是指贝叶斯优化算法在有限次迭代后收敛到目标函数的局部最优解的可能性。贝叶斯优化算法可以保证在有限次迭代后收敛到目标函数的局部最优解,但不能保证收敛到全局最优解。

贝叶斯优化算法的收敛性取决于以下因素:

- 目标函数的性质

- 贝叶斯优化算法的参数设置

- 贝叶斯优化算法的实现

如果目标函数是凸函数,那么贝叶斯优化算法可以保证在有限次迭代后收敛到目标函数的全局最优解。如果目标函数是非凸函数,那么贝叶斯优化算法只能保证在有限次迭代后收敛到目标函数的局部最优解。

贝叶斯优化算法的参数设置也会影响其收敛性。例如,如果贝叶斯优化算法的步长设置得太大,那么算法可能会跳过目标函数的局部最优解。如果贝叶斯优化算法的步长设置得太小,那么算法可能会收敛得非常慢。

贝叶斯优化算法的实现也会影响其收敛性。例如,如果贝叶斯优化算法的实现不够高效,那么算法可能会收敛得非常慢。

总之,贝叶斯优化的收敛性取决于目标函数的性质、贝叶斯优化算法的参数设置和贝叶斯优化算法的实现。如果目标函数是凸函数,那么贝叶斯优化算法可以保证在有限次迭代后收敛到目标函数的全局最优解。如果目标函数是非凸函数,那么贝叶斯优化算法只能保证在有限次迭代后收敛到目标函数的局部最优解。

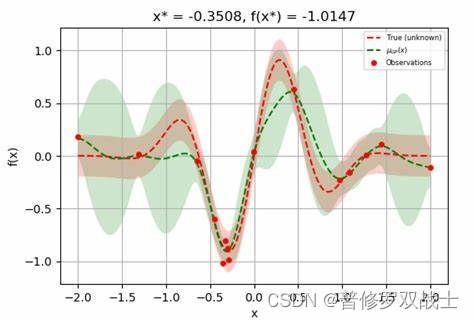

03. 贝叶斯优化如何处理噪声?

贝叶斯优化可以处理噪声,因为它使用贝叶斯方法来计算目标函数的概率分布。贝叶斯方法可以将噪声视为目标函数的随机变量,并将其纳入优化过程。这使得贝叶斯优化能够找到目标函数的局部最优解,即使目标函数受到噪声的影响。

贝叶斯优化处理噪声的方法有两种:

- 先验概率:贝叶斯优化可以使用先验概率来描述目标函数的噪声。先验概率是关于目标函数噪声的先验知识,它可以帮助贝叶斯优化找到目标函数的局部最优解。

- 后验概率:贝叶斯优化可以使用后验概率来描述目标函数的噪声。后验概率是关于目标函数噪声的后验知识,它可以帮助贝叶斯优化找到目标函数的局部最优解。

例如,假设我们有一个目标函数 $f(x)$,它受到噪声的影响。我们可以使用贝叶斯方法来计算目标函数的概率分布 $p(f(x))$。然后,我们可以使用贝叶斯优化算法来找到目标函数的局部最优解。

贝叶斯优化算法的工作原理是,它首先从一个随机初始点开始。然后,它会根据目标函数的概率分布 $p(f(x))$ 来计算下一个搜索点。这个过程会一直持续下去,直到贝叶斯优化算法找到目标函数的局部最优解。

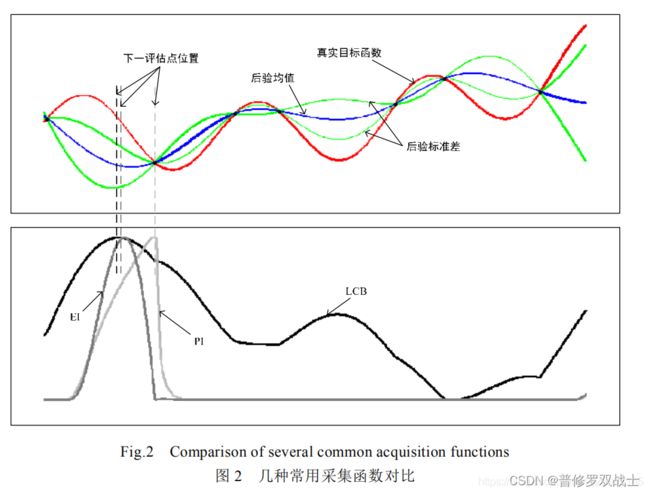

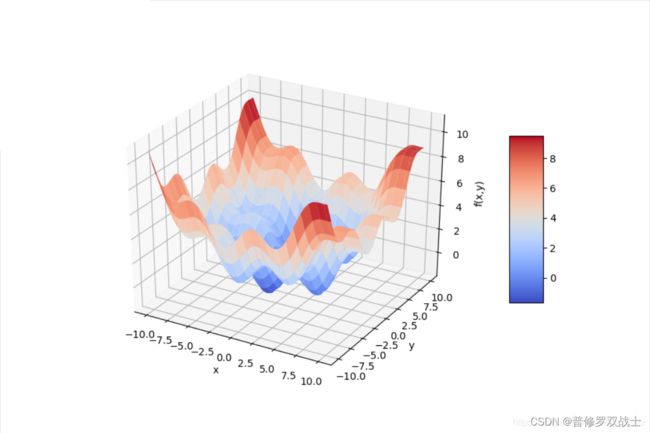

04. 贝叶斯优化如何处理非凸问题?

贝叶斯优化可以处理非凸问题,因为它使用贝叶斯方法来计算目标函数的概率分布。贝叶斯方法可以将非凸问题视为一个随机过程,并将其纳入优化过程。这使得贝叶斯优化能够找到目标函数的局部最优解,即使目标函数是非凸的。

贝叶斯优化处理非凸问题的方法有两种:

- 先验概率:贝叶斯优化可以使用先验概率来描述目标函数的非凸性。先验概率是关于目标函数非凸性的先验知识,它可以帮助贝叶斯优化找到目标函数的局部最优解。

- 后验概率:贝叶斯优化可以使用后验概率来描述目标函数的非凸性。后验概率是关于目标函数非凸性的后验知识,它可以帮助贝叶斯优化找到目标函数的局部最优解。

例如,假设我们有一个非凸目标函数 $f(x)$,我们希望找到它的局部最优解。我们可以使用贝叶斯优化算法来找到这个局部最优解。

贝叶斯优化算法的工作原理是,它首先从一个随机初始点开始。然后,它会使用贝叶斯方法来计算目标函数的概率分布。这个概率分布可以帮助我们判断哪些方向是值得探索的,哪些方向是没有必要探索的。

贝叶斯优化算法会不断地迭代,直到找到目标函数的局部最优解。这个局部最优解可能不是全局最优解,但是它是一个很好的近似值。

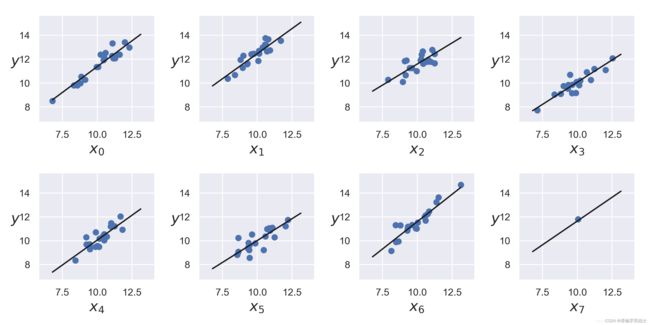

05. 贝叶斯优化如何处理高维问题?

5.1 什么是高维问题?

高维问题是指特征数量很多的问题。在机器学习和数据挖掘中,我们通常会遇到大量的特征,这些特征的数量可能成千上万,这样的问题就被称为高维问题。由于高维特征的数量很大,因此会对计算和存储资源造成很大的压力,同时也会对模型的解释性和可解释性造成一定的影响。因此,处理高维问题是一个具有挑战性的问题。贝叶斯优化是一种可以有效处理高维问题的优化方法。它使用贝叶斯统计来对优化问题进行建模,并使用贝叶斯推理来计算最优解。

5.2 贝叶斯优化应用于高维问题的方法?

当贝叶斯优化应用于高维问题时,可以使用以下方法来处理:

- 特征选择:在高维数据中,往往只有一小部分特征对目标函数的优化有重要影响,其他特征则可以忽略。因此,可以使用特征选择算法来筛选出对目标函数影响最大的特征,然后只使用这些特征进行优化。

- 特征提取:对于高维数据,可以使用特征提取算法将数据从高维空间映射到低维空间,以减少特征数量。这样可以降低贝叶斯优化的复杂度,提高优化效率。

- 随机搜索:在高维参数空间中,可以使用随机搜索方法来选择参数进行评估。虽然随机搜索的效率较低,但它可以用于初始化其他更高效的优化方法,以加速优化过程。

- 预处理器:在进行贝叶斯优化之前,可以使用预处理器对输入数据进行缩放或归一化,以便更好地处理高维数据。常见的预处理器包括MinMaxScaler和StandardScaler。

- 模型选择:选择适合高维问题的模型,例如树模型或核方法。这些模型可以自动从高维数据中学习特征,并进行有效的预测。

例如,在优化一个具有100个特征的函数时,可以使用特征选择算法来筛选出对目标函数影响最大的5个特征,然后只使用这5个特征进行优化。或者,可以使用特征提取算法将数据从100维映射到2维,然后使用2维数据进行优化。这样可以减少计算复杂度,提高优化效率。

06. 贝叶斯优化如何处理并行计算?

6.1 什么是并行计算?

并行计算是指同时执行多个计算任务的方法。这可以通过使用多个处理器或内核来实现,或者通过在多个计算机上分布计算任务。并行计算可以提高计算速度,因为它可以将计算任务分解为更小的任务,这些任务可以同时执行。

并行计算有许多应用,包括科学计算、机器学习和图像处理。在科学计算中,并行计算可以用于加速复杂的数值模拟。在机器学习中,并行计算可以用于训练大型模型。在图像处理中,并行计算可以用于加速图像处理任务,如图像分割和图像识别。

并行计算可以通过使用多个处理器或内核来实现。在多处理器系统中,每个处理器可以执行自己的计算任务。在多核系统中,每个内核可以执行自己的计算任务。

并行计算也可以通过在多个计算机上分布计算任务来实现。在这种情况下,每个计算机都会执行一部分计算任务。然后,计算机将结果汇总在一起,以生成最终结果。

并行计算可以提高计算速度,因为它可以将计算任务分解为更小的任务,这些任务可以同时执行。然而,并行计算也需要额外的资源,如处理器和内存。因此,在决定是否使用并行计算时,需要权衡计算速度和资源成本。

并行计算是一种强大的方法,可以加速计算任务。它在许多领域都有应用,包括科学计算、机器学习和图像处理。当计算任务足够大,并且有足够的资源时,并行计算可以带来显著的性能提升。

6.2 贝叶斯优化处理并行计算的方法?

贝叶斯优化可以通过并行计算来加速优化过程。

具体方法如下:

- 划分样本空间:将样本空间划分为多个区域,每个区域分配给不同的处理器进行计算。

- 并行评估:每个处理器并行评估分配给它的区域中的参数配置。这样可以同时获得多个参数配置的评估结果。

- 数据融合:将各个处理器返回的评估结果进行融合,更新先验分布和后验分布,然后选择下一个待评估的参数配置。

- 负载均衡:根据各个处理器的评估结果,重新划分样本空间,将负载均衡到各个处理器上,以提高优化效率。

贝叶斯优化可以通过并行计算来加速优化过程。例如,可以将样本空间划分为多个区域,每个区域分配给不同的处理器进行计算。每个处理器并行评估分配给它的区域中的参数配置,然后将各个处理器返回的评估结果进行融合,更新先验分布和后验分布,选择下一个待评估的参数配置。此外,还可以根据各个处理器的评估结果,重新划分样本空间,将负载均衡到各个处理器上,以提高优化效率。这样,贝叶斯优化就可以在并行计算上实现加速。需要注意的是,并行计算会带来一些额外的开销,例如通信和同步开销。因此,在使用并行计算时需要权衡计算效率和开销。

07. 贝叶斯优化如何处理稀疏数据?

7.1 什么是稀疏数据?

稀疏数据是指数据中大部分值为零的数据。例如,在一个包含一百万个元素的向量中,如果只有一千个元素不为零,那么这个向量就是稀疏的。

稀疏数据在许多领域都有应用,包括机器学习、图像处理和信号处理。在机器学习中,稀疏数据可以用于训练更高效的模型。在图像处理中,稀疏数据可以用于减少图像的大小。在信号处理中,稀疏数据可以用于提高信号的质量。

处理稀疏数据有许多挑战。一个挑战是如何存储稀疏数据。由于稀疏数据中大部分值为零,因此存储稀疏数据需要更少的空间。另一个挑战是如何处理稀疏数据。由于稀疏数据中大部分值为零,因此传统的算法可能无法有效地处理稀疏数据。

为了解决这些挑战,人们提出了许多不同的方法来处理稀疏数据。其中一种方法是使用稀疏矩阵。稀疏矩阵是指矩阵中大部分元素为零的矩阵。稀疏矩阵可以使用更少的空间来存储,并且可以使用专门的算法来处理。

另一种方法是使用稀疏表示。稀疏表示是指将数据表示为一个稀疏矩阵。稀疏表示可以使用更少的维度来表示数据,并且可以使用专门的算法来处理稀疏表示。

稀疏数据是一种重要的数据类型,它在许多领域都有应用。处理稀疏数据有许多挑战,但也有许多不同的方法可以解决这些挑战。

7.2 贝叶斯优化处理稀疏数据的方法?

当贝叶斯优化应用于稀疏数据时,可以使用以下方法来处理:

- 特征选择:在稀疏数据中,往往只有一小部分特征对目标函数的优化有重要影响,其他特征则可以忽略。因此,可以使用特征选择算法来筛选出对目标函数影响最大的特征,然后只使用这些特征进行优化。

- 数据填充:对于稀疏数据中的缺失值,可以使用数据填充方法来填充为合适的值,以增加数据的稠密性。例如,可以使用均值填充或中位数填充来填充缺失值。

- 预处理器:在进行贝叶斯优化之前,可以使用预处理器对输入数据进行缩放或归一化,以便更好地处理稀疏数据。常见的预处理器包括MinMaxScaler和StandardScaler。这些预处理器可以将数据缩放到相同的范围,以便更好地进行优化。

- 模型选择:选择适合稀疏数据的模型,例如决策树模型或核方法。这些模型可以自动从稀疏数据中学习特征,并进行有效的预测。例如,决策树模型可以自动选择对目标函数影响最大的特征,并构建决策树来进行优化。

例如,在优化一个具有100个特征的函数时,可以使用特征选择算法来筛选出对目标函数影响最大的5个特征,然后只使用这5个特征进行优化。或者,可以使用数据填充方法将缺失值填充为合适的值,然后使用预处理器对输入数据进行缩放或归一化,最后使用决策树模型来进行优化。这样可以减少计算复杂度,提高优化效率。

08. 贝叶斯优化如何处理异步计算?

8.1 什么是异步计算?

异步计算是指在不同的时间点执行计算任务的方法。这与同步计算形成对比,同步计算是指在同一时间点执行计算任务。异步计算可以提高计算性能,因为它可以让计算任务在等待其他任务完成时继续执行。

异步计算有许多应用,包括科学计算、机器学习和图像处理。在科学计算中,异步计算可以用于加速复杂的数值模拟。在机器学习中,异步计算可以用于训练大型模型。在图像处理中,异步计算可以用于加速图像处理任务,如图像分割和图像识别。

异步计算可以通过使用多处理器或多核处理器来实现。在多处理器系统中,每个处理器可以执行自己的计算任务。在多核处理器系统中,每个内核可以执行自己的计算任务。

异步计算也可以通过使用分布式计算来实现。在分布式计算中,计算任务被分发到多个计算机上。然后,计算机可以并行地执行计算任务。

异步计算可以提高计算性能,但也有一些挑战。一个挑战是,异步计算可能会导致数据竞争。数据竞争是指多个计算任务同时访问同一块数据。数据竞争可能会导致数据损坏或计算错误。

另一个挑战是,异步计算可能会导致同步问题。同步问题是指多个计算任务必须等待其他计算任务完成才能继续执行。同步问题可能会导致计算延迟。

尽管存在这些挑战,异步计算仍然是一种有效的方法来提高计算性能。异步计算在许多领域都有应用,包括科学计算、机器学习和图像处理。

8.2 贝叶斯优化处理异步计算的方法?

在贝叶斯优化中,如果需要处理异步计算,可以采用以下方法:

- 异步请求:在发送参数进行计算时,可以使用异步请求的方式,即在发送请求后立即返回,而不是等待计算结果返回后再继续优化。

- 并行计算:可以将多个参数的计算任务分配给多个处理器进行并行计算,以提高计算效率。

- 数据融合:在多个计算任务完成后,需要将计算结果进行融合,以更新先验分布和后验分布,并选择下一个待评估的参数配置。

例如,假设需要优化一个函数,该函数的计算需要3秒才能完成。在使用贝叶斯优化时,可以将该函数的计算过程设计为异步计算。首先,将参数发送进行计算,并在发送请求后立即返回。然后,将返回的结果进行记录,并选择下一个待评估的参数配置。当多个计算任务完成后,将计算结果进行融合,以更新先验分布和后验分布,并选择下一个待评估的参数配置。这样,就可以在异步计算的情况下,实现贝叶斯优化的高效优化过程。

09. 贝叶斯优化如何处理在线学习?

9.1 什么是在线学习?

在线学习是指通过互联网进行学习。它可以通过各种方式进行,包括视频、音频、课程、电子书和社交媒体。在线学习越来越受欢迎,因为它提供了一种灵活和方便的方式来学习新知识。

在线学习有许多优势。首先,它可以让学生在任何时间、任何地点学习。这使得它非常适合那些有忙碌工作或家庭的人。第二,在线学习通常比传统的面授学习更便宜。第三,在线学习可以让学生与来自世界各地的其他学生互动。这可以帮助他们拓宽视野,并获得不同的观点。

然而,在线学习也有一些缺点。首先,它可能不适合那些需要面对面指导的学生。第二,在线学习可能不适合那些没有自律的学生。第三,在线学习可能不适合那些没有良好互联网连接的学生。

总体而言,在线学习是一种有效的学习方式。它可以让学生在任何时间、任何地点学习新知识。在线学习通常比传统的面授学习更便宜。在线学习可以让学生与来自世界各地的其他学生互动。这可以帮助他们拓宽视野,并获得不同的观点。

9.2 贝叶斯优化处理在线学习的方法?

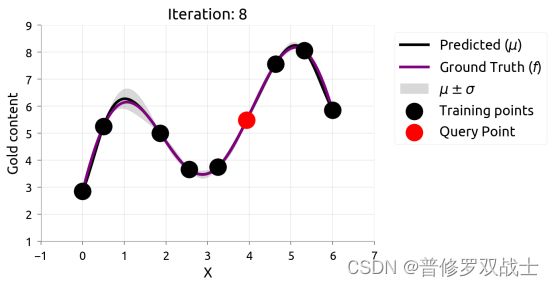

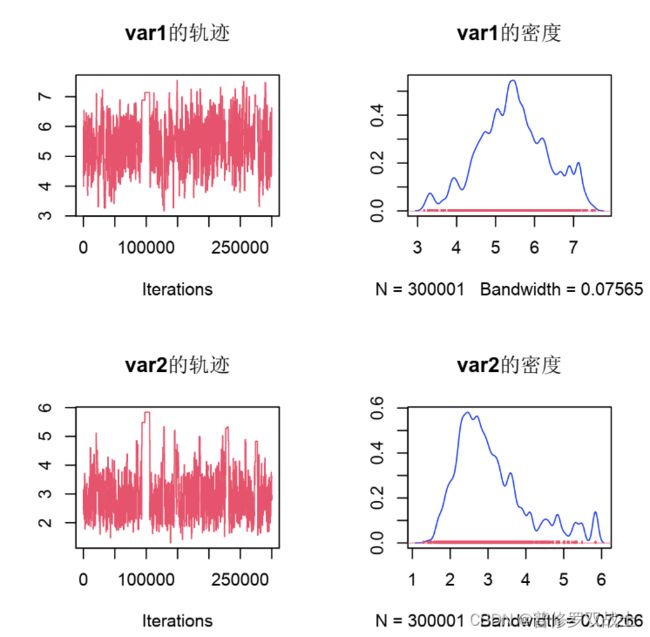

在贝叶斯优化中,处理在线学习的方法可以采用以下步骤:

- 初始化:首先需要初始化先验分布,可以选择高斯过程模型作为先验分布,其中模型的参数可以使用最大熵法或者拉普拉斯分布法进行初始化。

- 计算目标函数:根据当前的参数配置,计算得到目标函数的值。

- 更新先验分布:将得到的目标函数值反馈到先验分布中,通过贝叶斯公式更新后验分布。

- 选择下一个参数配置:根据后验分布,选择下一个待评估的参数配置。

- 更新模型参数:根据选择的参数配置,更新高斯过程模型的参数。

- 重复步骤2-5:重复执行步骤2-5,直到满足停止条件为止。

例如,假设需要优化一个函数,该函数的参数配置为[1, 2, 3]。首先,根据当前的参数配置,计算得到目标函数的值。然后,使用得到的目标函数值更新先验分布,得到后验分布。接下来,根据后验分布,选择下一个待评估的参数配置[4, 5, 6]。然后,根据选择的参数配置,更新高斯过程模型的参数。最后,重复执行步骤2-5,直到满足停止条件为止。这样,就可以通过在线学习的方式,实现贝叶斯优化的高效优化过程。

10. 贝叶斯优化如何处理强化学习?

10.1 什么是强化学习?

强化学习是一种机器学习算法,它可以让机器学习如何在环境中采取行动,以最大化某个长期目标。强化学习与监督学习和无监督学习不同。监督学习是指机器学习从带有标签的数据中学习。无监督学习是指机器学习从没有标签的数据中学习。强化学习是指机器学习从环境中学习,通过试错和奖励来改进其行为。

强化学习的应用包括游戏、机器人控制、自动驾驶汽车、金融投资和医疗保健。在游戏中,强化学习可以让机器人学习如何玩游戏,并在游戏中击败人类玩家。在机器人控制中,强化学习可以让机器人学习如何在复杂的环境中导航和执行任务。在自动驾驶汽车中,强化学习可以让汽车学习如何在交通中安全行驶。在金融投资中,强化学习可以让机器人学习如何在金融市场中进行交易。在医疗保健中,强化学习可以让机器人学习如何诊断和治疗疾病。

强化学习是一种强大的机器学习算法,它可以让机器学习如何在环境中采取行动,以最大化某个长期目标。强化学习的应用包括游戏、机器人控制、自动驾驶汽车、金融投资和医疗保健。

10.2 贝叶斯优化处理强化学习的方法?

在贝叶斯优化中,处理强化学习的方法可以采用以下步骤:

- 初始化:首先需要初始化智能体和环境,以及先验分布,可以选择高斯过程模型作为先验分布,其中模型的参数可以使用最大熵法或者拉普拉斯分布法进行初始化。

- 选择动作:根据当前的智能体状态,通过高斯过程模型的后验分布,选择一个动作。

- 执行动作:将选择的动作执行在环境中,并观察到环境的反馈。

- 更新先验分布:将观察到的环境反馈值反馈到先验分布中,通过贝叶斯公式更新后验分布。

- 更新智能体:根据观察到的环境反馈值,更新智能体的策略。

- 重复步骤2-5:重复执行步骤2-5,直到满足停止条件为止。

例如,假设智能体需要在一个环境中移动,以最大化累积奖励。首先,根据当前的智能体状态,通过高斯过程模型的后验分布,选择一个移动方向。然后,将选择的移动方向执行在环境中,并观察到环境的反馈值,如当前位置的奖励值。接下来,将观察到的奖励值反馈到先验分布中,通过贝叶斯公式更新后验分布。然后,根据观察到的奖励值,更新智能体的移动策略。最后,重复执行步骤2-5,直到满足停止条件为止。这样,就可以通过贝叶斯优化的方法,实现强化学习的高效学习过程。