- Spark教程1:Spark基础介绍

Cachel wood

大数据开发spark大数据分布式计算机网络数据库数据仓库

文章目录一、Spark是什么?二、Spark的核心优势三、Spark的核心概念四、Spark的主要组件五、Spark的部署模式六、Spark与Hadoop的关系七、Spark应用开发流程八、Spark的应用场景九、Spark版本更新与社区一、Spark是什么?ApacheSpark是一个开源的分布式大数据处理引擎,最初由加州大学伯克利分校AMPLab开发,2013年捐赠给Apache软件基金会,如

- 实战Spark从入门到精通(五):Spark开发实操,先搞定Spark集群规划!

元飞聊技术

实战Spark从入门到精通spark大数据分布式linuxcentos

系列文章目录实战Spark从入门到精通(一):一文带你全面了解Spark大数据处理框架实战Spark从入门到精通(二):Spark急速上手,给小白的3分钟入门指南实战Spark从入门到精通(三):深入理解SparkRDD,大数据处理的核心引擎实战Spark从入门到精通(四):揭秘Spark架构,这才是Spark速度快的真正秘密!文章目录系列文章目录前言Spark集群规划,先搞定Spark基础运行环

- Spark基础笔记之启动命令顺序

java刘先生

spark笔记大数据

系统环境(三台虚拟机)node1192.168.32.101(主)node2192.168.32.102node3192.168.32.1031、启动hdfs、yarn、historyserver(hadoop用户启动)#启动dfs,启动后的服务名:DataNode、SecondaryNameNode、NameNodesh/export/hadoop/sbin/start-dfs.sh#启动yar

- Spark基础篇-Application、Job、Stage 和 Task

数据大包哥

#Sparkspark大数据分布式

Spark基础篇单独看看Application、Job、Stage和Task在ApacheSpark中,Application、Job、Stage和Task是任务调度和执行的四个核心层级概念,它们构成从宏观到微观的完整执行流程。以下是对它们的详细解释及其关系:1.Application(应用程序)定义:一个完整的Spark程序,对应用户通过spark-submit提交的一个独立进程。它包含Driv

- Spark基础学习笔记06:搭建Spark On YARN集群

酒城译痴无心剑

Spark基础学习笔记javaYARNSpark

文章目录零、本讲学习目标一、SparkOnYARN架构(一)client提交方式(二)cluster提交方式二、搭建SparkOnYARN集群(一)搭建SparkStandalone集群(二)修改Spark环境配置文件三、提交Spark应用到集群运行(一)启动HDFS和YARN(二)运行Spark应用程序(三)查看应用程序运行结果零、本讲学习目标学会搭建SparkOnYARN模式的集群能够将Spa

- Spark基础学习笔记:搭建spark on yarn 集群

Connie_2022

spark学习bigdata

一、SparkOnYARN架构SparkOnYARN模式遵循YARN的官方规范,YARN只负责资源的管理和调度,运行哪种应用程序由用户自己实现,因此可能在YARN上同时运行MapReduce程序和Spark程序,YARN很好地对每一个程序实现了资源的隔离。这使得Spark与MapReduce可以运行于同一个集群中,共享集群存储资源与计算资源。SparkOnYARN模式与Standalone模式一样

- spark基础介绍

满分对我强制爱

spark大数据分布式

一)Spark概述Spark是一种基于内存的快速、通用、可拓展的大数据分析计算引擎。Hadoop是一个分布式系统基础架构。1)官网地址:ApacheSpark™-UnifiedEngineforlarge-scaledataanalytics2)文档查看地址:Redirecting…3)下载地址:Downloads|ApacheSparkhttps://archive.apache.org/dis

- Spark基础介绍

小白的白是白痴的白

spark大数据分布式

(一)Spark概述Spark是一种基于内存的快速、通用、可拓展的大数据分析计算引擎。Hadoop是一个分布式系统基础架构。1)官网地址:ApacheSpark™-UnifiedEngineforlarge-scaledataanalytics2)文档查看地址:Redirecting…3)下载地址:Downloads|ApacheSparkhttps://archive.apache.org/di

- spark数据分析基于python语言 中文版pdf_Spark数据分析:基于Python语言

weixin_39901332

中文版pdf

译者序前言引言第一部分Spark基础第1章大数据、Hadoop、Spark介绍21.1大数据、分布式计算、Hadoop简介21.1.1大数据与Hadoop简史21.1.2Hadoop简介31.2Spark简介81.2.1Spark背景91.2.2Spark的用途91.2.3Spark编程接口91.2.4Spark程序的提交类型101.2.5Spark应用程序的输入/输出类型111.2.6Spark

- spark与kafka

zqk-Sun

bigdatasparkkafka

sparkspark基础知识spark的任务提交流程shuffle过程分析rdd的特点与五大属性spark整合kafka1、SparkStreaming+Kafka----Receiver用的是Kafka高层次的消费者api,不能自己维护offsetobjectSparkkafka08ReceiverDStream{defmain(args:Array[String]):Unit={valspar

- Spark基础之Scala知识总结

Jason_0to

大数据scalasparkjava

史上最全的Scala知识点整理第一章变量及基本数据类型1.1注释1.2标识符命名规范1.3变量1.4字符串1.5数据读取1.6数据类型1.6.1概述1.6.2类型转换1.7运算符第二章流程控制2.1块表达式2.2If判断2.3For循环2.3.1Scala中方法调用的两种方式2.3.2基本语法2.3.3循环返回值2.4While循环2.5Switch2.6中断循环第三章面向函数编程3.1概念3.2

- 【自学笔记】Spark基础知识点总览-持续更新

Long_poem

笔记spark大数据

提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档文章目录ApacheSpark基础知识点总览目录简介核心组件SparkSQLDataFrame与DatasetAPIRDD(弹性分布式数据集)SparkStreamingMLlib(机器学习库)GraphX(图处理框架)部署模式示例代码创建SparkContext创建RDD并执行操作使用DataFrameAPI使用SparkSQL总结

- 分布式计算入门(PySpark处理NASA服务器日志)

闲人编程

Python数据分析实战精要服务器运维统计分析日志NASA服务器分布式计算PySpark

目录分布式计算入门(PySpark处理NASA服务器日志)1.引言2.分布式计算概述2.1分布式计算的基本概念2.2ApacheSpark与PySpark3.NASA服务器日志数据集介绍3.1数据背景3.2数据格式与挑战4.PySpark基础与分布式日志处理4.1PySpark基本架构4.2日志数据加载与解析4.3数据清洗与内存优化4.4GPU加速与SparkRAPIDS5.实验环境与依赖库6.数

- Spark基础【RDD依赖关系--源码解析】

OneTenTwo76

Sparksparkscala大数据

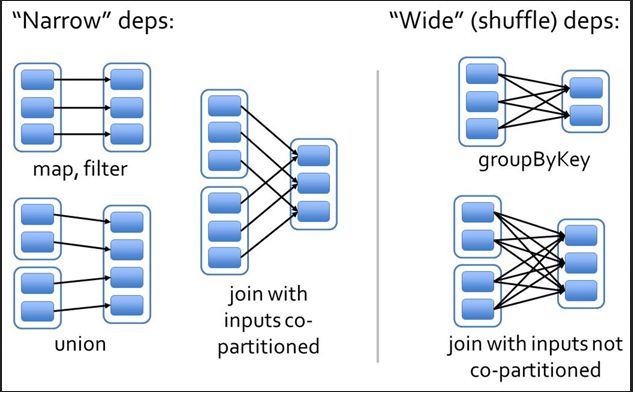

文章目录一RDD依赖关系1RDD血缘关系2RDD依赖关系3RDD阶段划分4RDD任务划分一RDD依赖关系1RDD血缘关系相邻两个RDD之间的关系,称之为依赖关系,多个连续的依赖关系称之为血缘关系RDD只支持粗粒度转换,即在大量记录上执行的单个操作。将创建RDD的一系列Lineage(血统)记录下来,以便恢复丢失的分区。RDD的Lineage会记录RDD的元数据信息和转换行为,当该RDD的部分分区数

- 分布式离线计算—Spark—基础介绍

测试开发abbey

人工智能—大数据

原文作者:饥渴的小苹果原文地址:【Spark】Spark基础教程目录Spark特点Spark相对于Hadoop的优势Spark生态系统Spark基本概念Spark结构设计Spark各种概念之间的关系Executor的优点Spark运行基本流程Spark运行架构的特点Spark的部署模式Spark三种部署方式Hadoop和Spark的统一部署摘要:Spark是基于内存计算的大数据并行计算框架Spar

- Spark面试题

golove666

面试题大全spark大数据分布式面试

Spark面试题1.Spark基础概念1.1解释Spark是什么以及它的主要特点Spark是什么?Spark的主要特点1.2描述Spark运行时架构和组件主要的Spark架构组件:1.3讲述Spark中的弹性分布式数据集(RDD)和数据帧(DataFrame)弹性分布式数据集(RDD)主要特征:创建和转换:使用场景:数据帧(DataFrame)主要特征:创建和操作:使用场景:RDD与DataFra

- PySpark数据分析基础:PySpark基础功能及DataFrame操作基础语法详解_pyspark rdd

2401_84187537

数据分析数据挖掘

DataFrame.show()使用格式:df.show()df.show(1)+---+---+-------+----------+-------------------+|a|b|c|d|e|+---+---+-------+----------+-------------------+|1|2.0|string1|2000-01-01|2000-01-0112:00:00|+---+---

- PySpark数据分析基础:PySpark基础功能及DataFrame操作基础语法详解_pyspark rdd(1)

2401_84181368

程序员数据分析数据挖掘

dfDataFrame[a:bigint,b:double,c:string,d:date,e:timestamp]####通过由元组列表组成的RDD创建rdd=spark.sparkContext.parallelize([(1,2.,‘string1’,date(2000,1,1),datetime(2000,1,1,12,0)),(2,3.,‘string2’,date(2000,2,1),

- PySpark数据分析基础:PySpark基础功能及DataFrame操作基础语法详解_pyspark rdd(2)

2401_84181403

程序员数据分析数据挖掘

轻松切换到pandasAPI和PySparkAPI上下文,无需任何开销。有一个既适用于pandas(测试,较小的数据集)又适用于Spark(分布式数据集)的代码库。熟练使用pandas的话很快上手3.StreamingApacheSpark中的Streaming功能运行在Spark之上,支持跨Streaming和历史数据的强大交互和分析应用程序,同时继承了Spark的易用性和容错特性。SparkS

- Spark基础

Tom无敌宇宙猫

spark大数据分布式

一.基础1.RDD机制 1.rdd分布式弹性数据集,简单的理解成⼀种数据结构,是spark框架上的通⽤货币。所有算⼦都是基于rdd来执⾏的,不同的场景会有不同的rdd实现类,但是都可以进⾏互相转换。rdd执⾏过程中会形成dag图,然后形成lineage血缘关系保证容错性等。从物理的⾓度来看rdd存储的是block和node之间的映射。 2.RDD是spark提供的核⼼抽象,全称为弹性分布式数据

- Python学习路线 - Python高阶技巧 - PySpark案例实战

mry6

Pythonpython

Python学习路线-Python高阶技巧-PySpark案例实战前言介绍Spark是什么PythonOnSparkPySparkWhyPySpark基础准备PySpark库的安装构建PySpark执行环境入口对象PySpark的编程模型数据输入RDD对象Python数据容器转RDD对象读取文件转RDD对象数据计算map方法flatMap方法reduceByKey方法练习案例1filter方法di

- Spark大数据分析与实战笔记(第二章 Spark基础-06)

想你依然心痛

#Spark大数据分析与实战spark数据分析笔记

文章目录每日一句正能量2.6IDEA开发WordCount程序2.6.1本地模式执行Spark程序2.6.2集群模式执行Spark程序每日一句正能量我们全都要从前辈和同辈学习到一些东西。就连最大的天才,如果想单凭他所特有的内在自我去对付一切,他也决不会有多大成就。2.6IDEA开发WordCount程序Spark-Shell通常在测试和验证我们的程序时使用的较多,然而在生产环境中,通常会在IDEA

- Spark基础

cjyang

Spark基础几个重要的概念:RDD:是弹性分布式数据集(ResilientDistributedDataset)的简称,是分布式内存的一个抽象概念,提供了一种高度受限的共享内存模型;DAG:是DirectedAcyclicGraph(有向无环图)的简称,反映RDD之间的依赖关系;Executor:是运行在工作节点(WorkerNode)上的一个进程,负责运行任务,并为应用程序存储数据;应用:用户

- Spark3学习笔记

魅Lemon

大数据spark

文章目录一、Spark基础1、Spark概述1.1Spark简介1.2SparkVSHadoop1.3Spark特点1.4Spark入门Demo2、Spark运行模式2.1概述2.2Local模式2.3Standalone模式2.4配置高可用(Standalone+HA)2.5Yarn模式2.6K8S&Mesos模式2.7Windows模式2.8部署模式对比2.9端口号3、Spark运行架构3.1

- Spark基础学习--基础介绍

Yan_bigdata

spark学习大数据mapreduce对比入门案例词频统计

1.Spark基本介绍1.1定义Spark是可以处理大规模数据的统一分布式计算引擎。1.2Spark与MapReduce的对比在之前我们学习过MapReduce,同样作为大数据分布式计算引擎,究竟这两者有什么区别呢?首先我们回顾一下MapReduce的架构:MR基于HDFS实现大数据存储,基于Yarn做资源调度,且MR是基于进程处理数据的总结一下MR的缺点:1.MR是基于进程进行数据处理,进程相对

- Spark基础

中长跑路上crush

Spark阶段spark大数据分布式

Spark基础建库一定要指定字符集,错了好多次了pip卸载某个模块pipuninstallpandas--下载其它的改掉pandas即可pipinstall-ihttps://pypi.tuna.tsinghua.edu.cn/simplepandas更新最新版本pippython-mpipinstall--upgradepip1、启动服务Hadoop启动全部服务*****/hadoop/sbin

- spark基础--学习笔记

祈愿lucky

大数据spark学习笔记

1spark介绍1.1spark概念ApacheSpark是专为大规模数据处理而设计的快速通用的分布式计算引擎,是开源的类HadoopMapReduce的通用分布式计算框架。和MapReduce一样,都是完成大规模数据的计算处理。简而言之,Spark借鉴了MapReduce思想发展而来,保留了其分布式并行计算的优点并改进了其明显的缺陷。让中间数据存储在内存中提高了运行速度、并提供丰富的操作数据的A

- 大数据之PySpark的RDD介绍

敲键盘的杰克

Spark大数据spark

文章目录前言一、RDD简介二、RDD的特性三、RDD的特点总结前言之前的文章主要介绍Spark基础知识,例如集群角色、Spark集群运行流程等,接下来会进一步讨论Spark相对核心的知识,让我们拭目以待,同时也期待各位的精彩留言!一、RDD简介RDD称为弹性分布式数据集,是Spark中最基本的数据抽象,其为一个不可变、可分区、元素可并行计算的集合;RDD中的数据是分布式存储,可用于并行计算,同时,

- Spark基础原理

小希 fighting

spark大数据python

SparkOnYarnSparkOnYarn的本质Spark专注于分布式计算,Yarn专注于资源管理,Spark将资源管理的工作交给了Yarn来负责SparkOnYarn两种部署方式Spark中有两种部署方式,Client和Cluster方式,默认是Client方式。这两种方式的本质区别,是Driver进程运行的地方不一样。Client部署方式:Driver进程运行在你提交程序的那台机器上优点:将

- Spark基础二

MSJ3917

spark大数据分布式

一.Spark入门案例总结1.读取文件:textFile(path):读取外部数据源,支持本地文件系统和hdfs文件系统.2.将结果数据输出文件上:saveAsTextFile(path):将数据输出到外部存储系统,支持本地文件系统和hdfs文件系统.3.文件路径协议:本地:file///路径hdfs:hdfs://虚拟机ip地址:8020/路径4.排序相关的API:sortBy(参数1,参数2)

- html页面js获取参数值

0624chenhong

html

1.js获取参数值js

function GetQueryString(name)

{

var reg = new RegExp("(^|&)"+ name +"=([^&]*)(&|$)");

var r = windo

- MongoDB 在多线程高并发下的问题

BigCat2013

mongodbDB高并发重复数据

最近项目用到 MongoDB , 主要是一些读取数据及改状态位的操作. 因为是结合了最近流行的 Storm进行大数据的分析处理,并将分析结果插入Vertica数据库,所以在多线程高并发的情境下, 会发现 Vertica 数据库中有部分重复的数据. 这到底是什么原因导致的呢?笔者开始也是一筹莫 展,重复去看 MongoDB 的 API , 终于有了新发现 :

com.mongodb.DB 这个类有

- c++ 用类模版实现链表(c++语言程序设计第四版示例代码)

CrazyMizzz

数据结构C++

#include<iostream>

#include<cassert>

using namespace std;

template<class T>

class Node

{

private:

Node<T> * next;

public:

T data;

- 最近情况

麦田的设计者

感慨考试生活

在五月黄梅天的岁月里,一年两次的软考又要开始了。到目前为止,我已经考了多达三次的软考,最后的结果就是通过了初级考试(程序员)。人啊,就是不满足,考了初级就希望考中级,于是,这学期我就报考了中级,明天就要考试。感觉机会不大,期待奇迹发生吧。这个学期忙于练车,写项目,反正最后是一团糟。后天还要考试科目二。这个星期真的是很艰难的一周,希望能快点度过。

- linux系统中用pkill踢出在线登录用户

被触发

linux

由于linux服务器允许多用户登录,公司很多人知道密码,工作造成一定的障碍所以需要有时踢出指定的用户

1/#who 查出当前有那些终端登录(用 w 命令更详细)

# who

root pts/0 2010-10-28 09:36 (192

- 仿QQ聊天第二版

肆无忌惮_

qq

在第一版之上的改进内容:

第一版链接:

http://479001499.iteye.com/admin/blogs/2100893

用map存起来号码对应的聊天窗口对象,解决私聊的时候所有消息发到一个窗口的问题.

增加ViewInfo类,这个是信息预览的窗口,如果是自己的信息,则可以进行编辑.

信息修改后上传至服务器再告诉所有用户,自己的窗口

- java读取配置文件

知了ing

1,java读取.properties配置文件

InputStream in;

try {

in = test.class.getClassLoader().getResourceAsStream("config/ipnetOracle.properties");//配置文件的路径

Properties p = new Properties()

- __attribute__ 你知多少?

矮蛋蛋

C++gcc

原文地址:

http://www.cnblogs.com/astwish/p/3460618.html

GNU C 的一大特色就是__attribute__ 机制。__attribute__ 可以设置函数属性(Function Attribute )、变量属性(Variable Attribute )和类型属性(Type Attribute )。

__attribute__ 书写特征是:

- jsoup使用笔记

alleni123

java爬虫JSoup

<dependency>

<groupId>org.jsoup</groupId>

<artifactId>jsoup</artifactId>

<version>1.7.3</version>

</dependency>

2014/08/28

今天遇到这种形式,

- JAVA中的集合 Collectio 和Map的简单使用及方法

百合不是茶

listmapset

List ,set ,map的使用方法和区别

java容器类类库的用途是保存对象,并将其分为两个概念:

Collection集合:一个独立的序列,这些序列都服从一条或多条规则;List必须按顺序保存元素 ,set不能重复元素;Queue按照排队规则来确定对象产生的顺序(通常与他们被插入的

- 杀LINUX的JOB进程

bijian1013

linuxunix

今天发现数据库一个JOB一直在执行,都执行了好几个小时还在执行,所以想办法给删除掉

系统环境:

ORACLE 10G

Linux操作系统

操作步骤如下:

第一步.查询出来那个job在运行,找个对应的SID字段

select * from dba_jobs_running--找到job对应的sid

&n

- Spring AOP详解

bijian1013

javaspringAOP

最近项目中遇到了以下几点需求,仔细思考之后,觉得采用AOP来解决。一方面是为了以更加灵活的方式来解决问题,另一方面是借此机会深入学习Spring AOP相关的内容。例如,以下需求不用AOP肯定也能解决,至于是否牵强附会,仁者见仁智者见智。

1.对部分函数的调用进行日志记录,用于观察特定问题在运行过程中的函数调用

- [Gson六]Gson类型适配器(TypeAdapter)

bit1129

Adapter

TypeAdapter的使用动机

Gson在序列化和反序列化时,默认情况下,是按照POJO类的字段属性名和JSON串键进行一一映射匹配,然后把JSON串的键对应的值转换成POJO相同字段对应的值,反之亦然,在这个过程中有一个JSON串Key对应的Value和对象之间如何转换(序列化/反序列化)的问题。

以Date为例,在序列化和反序列化时,Gson默认使用java.

- 【spark八十七】给定Driver Program, 如何判断哪些代码在Driver运行,哪些代码在Worker上执行

bit1129

driver

Driver Program是用户编写的提交给Spark集群执行的application,它包含两部分

作为驱动: Driver与Master、Worker协作完成application进程的启动、DAG划分、计算任务封装、计算任务分发到各个计算节点(Worker)、计算资源的分配等。

计算逻辑本身,当计算任务在Worker执行时,执行计算逻辑完成application的计算任务

- nginx 经验总结

ronin47

nginx 总结

深感nginx的强大,只学了皮毛,把学下的记录。

获取Header 信息,一般是以$http_XX(XX是小写)

获取body,通过接口,再展开,根据K取V

获取uri,以$arg_XX

&n

- 轩辕互动-1.求三个整数中第二大的数2.整型数组的平衡点

bylijinnan

数组

import java.util.ArrayList;

import java.util.Arrays;

import java.util.List;

public class ExoWeb {

public static void main(String[] args) {

ExoWeb ew=new ExoWeb();

System.out.pri

- Netty源码学习-Java-NIO-Reactor

bylijinnan

java多线程netty

Netty里面采用了NIO-based Reactor Pattern

了解这个模式对学习Netty非常有帮助

参考以下两篇文章:

http://jeewanthad.blogspot.com/2013/02/reactor-pattern-explained-part-1.html

http://gee.cs.oswego.edu/dl/cpjslides/nio.pdf

- AOP通俗理解

cngolon

springAOP

1.我所知道的aop 初看aop,上来就是一大堆术语,而且还有个拉风的名字,面向切面编程,都说是OOP的一种有益补充等等。一下子让你不知所措,心想着:怪不得很多人都和 我说aop多难多难。当我看进去以后,我才发现:它就是一些java基础上的朴实无华的应用,包括ioc,包括许许多多这样的名词,都是万变不离其宗而 已。 2.为什么用aop&nb

- cursor variable 实例

ctrain

variable

create or replace procedure proc_test01

as

type emp_row is record(

empno emp.empno%type,

ename emp.ename%type,

job emp.job%type,

mgr emp.mgr%type,

hiberdate emp.hiredate%type,

sal emp.sal%t

- shell报bash: service: command not found解决方法

daizj

linuxshellservicejps

今天在执行一个脚本时,本来是想在脚本中启动hdfs和hive等程序,可以在执行到service hive-server start等启动服务的命令时会报错,最终解决方法记录一下:

脚本报错如下:

./olap_quick_intall.sh: line 57: service: command not found

./olap_quick_intall.sh: line 59

- 40个迹象表明你还是PHP菜鸟

dcj3sjt126com

设计模式PHP正则表达式oop

你是PHP菜鸟,如果你:1. 不会利用如phpDoc 这样的工具来恰当地注释你的代码2. 对优秀的集成开发环境如Zend Studio 或Eclipse PDT 视而不见3. 从未用过任何形式的版本控制系统,如Subclipse4. 不采用某种编码与命名标准 ,以及通用约定,不能在项目开发周期里贯彻落实5. 不使用统一开发方式6. 不转换(或)也不验证某些输入或SQL查询串(译注:参考PHP相关函

- Android逐帧动画的实现

dcj3sjt126com

android

一、代码实现:

private ImageView iv;

private AnimationDrawable ad;

@Override

protected void onCreate(Bundle savedInstanceState)

{

super.onCreate(savedInstanceState);

setContentView(R.layout

- java远程调用linux的命令或者脚本

eksliang

linuxganymed-ssh2

转载请出自出处:

http://eksliang.iteye.com/blog/2105862

Java通过SSH2协议执行远程Shell脚本(ganymed-ssh2-build210.jar)

使用步骤如下:

1.导包

官网下载:

http://www.ganymed.ethz.ch/ssh2/

ma

- adb端口被占用问题

gqdy365

adb

最近重新安装的电脑,配置了新环境,老是出现:

adb server is out of date. killing...

ADB server didn't ACK

* failed to start daemon *

百度了一下,说是端口被占用,我开个eclipse,然后打开cmd,就提示这个,很烦人。

一个比较彻底的解决办法就是修改

- ASP.NET使用FileUpload上传文件

hvt

.netC#hovertreeasp.netwebform

前台代码:

<asp:FileUpload ID="fuKeleyi" runat="server" />

<asp:Button ID="BtnUp" runat="server" onclick="BtnUp_Click" Text="上 传" />

- 代码之谜(四)- 浮点数(从惊讶到思考)

justjavac

浮点数精度代码之谜IEEE

在『代码之谜』系列的前几篇文章中,很多次出现了浮点数。 浮点数在很多编程语言中被称为简单数据类型,其实,浮点数比起那些复杂数据类型(比如字符串)来说, 一点都不简单。

单单是说明 IEEE浮点数 就可以写一本书了,我将用几篇博文来简单的说说我所理解的浮点数,算是抛砖引玉吧。 一次面试

记得多年前我招聘 Java 程序员时的一次关于浮点数、二分法、编码的面试, 多年以后,他已经称为了一名很出色的

- 数据结构随记_1

lx.asymmetric

数据结构笔记

第一章

1.数据结构包括数据的

逻辑结构、数据的物理/存储结构和数据的逻辑关系这三个方面的内容。 2.数据的存储结构可用四种基本的存储方法表示,它们分别是

顺序存储、链式存储 、索引存储 和 散列存储。 3.数据运算最常用的有五种,分别是

查找/检索、排序、插入、删除、修改。 4.算法主要有以下五个特性:

输入、输出、可行性、确定性和有穷性。 5.算法分析的

- linux的会话和进程组

网络接口

linux

会话: 一个或多个进程组。起于用户登录,终止于用户退出。此期间所有进程都属于这个会话期。会话首进程:调用setsid创建会话的进程1.规定组长进程不能调用setsid,因为调用setsid后,调用进程会成为新的进程组的组长进程.如何保证? 先调用fork,然后终止父进程,此时由于子进程的进程组ID为父进程的进程组ID,而子进程的ID是重新分配的,所以保证子进程不会是进程组长,从而子进程可以调用se

- 二维数组 元素的连续求解

1140566087

二维数组ACM

import java.util.HashMap;

public class Title {

public static void main(String[] args){

f();

}

// 二位数组的应用

//12、二维数组中,哪一行或哪一列的连续存放的0的个数最多,是几个0。注意,是“连续”。

public static void f(){

- 也谈什么时候Java比C++快

windshome

javaC++

刚打开iteye就看到这个标题“Java什么时候比C++快”,觉得很好笑。

你要比,就比同等水平的基础上的相比,笨蛋写得C代码和C++代码,去和高手写的Java代码比效率,有什么意义呢?

我是写密码算法的,深刻知道算法C和C++实现和Java实现之间的效率差,甚至也比对过C代码和汇编代码的效率差,计算机是个死的东西,再怎么优化,Java也就是和C