- ZooKeeper在Hadoop中的协同应用:从NameNode选主到分布式锁实现

码字的字节

hadoop布道师分布式zookeeperhadoop分布式锁

Hadoop与ZooKeeper概述Hadoop与ZooKeeper在大数据生态系统中的核心位置和交互关系Hadoop的架构与核心组件作为大数据处理的基石,Hadoop生态系统由多个关键组件构成。其核心架构主要包含HDFS(HadoopDistributedFileSystem)和YARN(YetAnotherResourceNegotiator)两大模块。HDFS采用主从架构设计,由NameNo

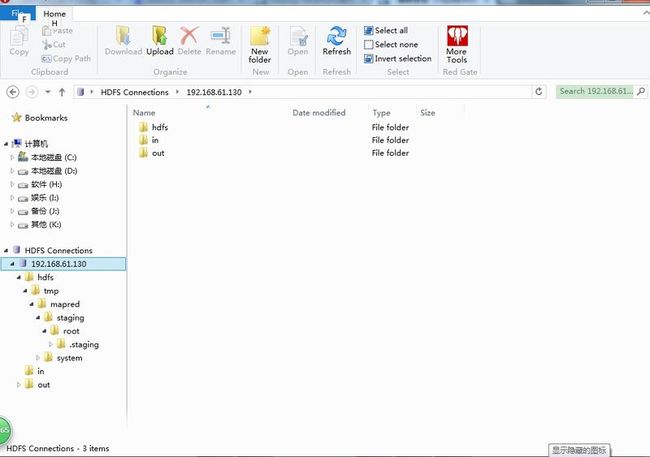

- HDFS常用命令

BenChuat

大数据学习hdfshadoop大数据

常用命令说明:-put和-get:上传和下载文件,是HDFS和本地文件系统交互的关键命令。-rm和-mkdir:删除和创建文件/目录,-rm支持递归删除。-ls和-cat:文件查看操作中最常用的命令,分别用于列出文件和查看内容。权限管理:通过-chmod、-chown和-chgrp命令对HDFS文件的权限、所有者和所属组进行管理。检查文件状态:通过-stat和-checksum命令,可以查看文件的

- Hadoop中MapReduce和Yarn相关内容详解

接上一章写的HDFS说,Hadoop是一个适合海量数据的分布式存储和分布式计算的一个平台,上一章介绍了分布式存储,这一章介绍一下分布式计算——MapReduce。一、MapReduce设计理念map——>映射Reduce——>归纳mapreduce是一种必须构建在hadoop之上的大数据离线计算框架。因为mapreduce是给予磁盘IO来计算存储文件的,所以它具有一定的延时性,因此一般用来处理离线

- 大数据领域Hadoop集群搭建的详细步骤

AI天才研究院

ChatGPT实战ChatGPTAI大模型应用入门实战与进阶大数据hadoop分布式ai

大数据领域Hadoop集群搭建的详细步骤关键词:Hadoop集群、HDFS、YARN、大数据平台、分布式系统、集群配置、故障排查摘要:Hadoop作为大数据领域的基石框架,其集群搭建是数据工程师和运维人员的核心技能。本文从Hadoop核心架构出发,结合生产环境实践,详细讲解从环境准备、配置文件调优到集群启动验证的全流程,并涵盖常见问题排查与最佳实践。无论你是初学者还是需要优化现有集群的工程师,本文

- Hive/Spark小文件解决方案(企业级实战)–参数和SQL优化

陆水A

大数据hivehadoopsparkpython

重点是后面的参数优化一、小文件的定义在Hadoop的上下文中,小文件的定义是相对于Hadoop分布式文件系统(HDFS)的块(Block)大小而言的。HDFS是Hadoop生态系统中的核心组件之一,它设计用于存储和处理大规模数据集。在HDFS中,数据被分割成多个块,每个块的大小是固定的,这个大小在Hadoop的不同版本和配置中可能有所不同,但常见的默认块大小包括128MB、256MB等。基于这个背

- C++与Hive、Spark、libhdfs、ACID交互技巧

KENYCHEN奉孝

C++开发语言springC++hivespark

C++与Hive交互的实例以下是C++与Hive交互的实例代码片段,涵盖连接、查询、数据操作等常见场景。假设使用libhdfs或thrift接口实现,部分示例需要结合Hive环境配置。基础连接与查询示例1:通过Thrift连接HiveServer2#include#include#includeusingnamespaceapache::thrift;usingnamespaceapache::h

- Spark大数据处理讲课笔记4.8 Spark SQL典型案例

酒城译痴无心剑

#Spark基础学习笔记(1)spark笔记sql

文章目录零、本讲学习目标一、使用SparkSQL实现词频统计(一)提出任务(二)实现任务1、准备数据文件2、创建Maven项目3、修改源程序目录4、添加依赖和设置源程序目录5、创建日志属性文件6、创建HDFS配置文件7、创建词频统计单例对象8、启动程序,查看结果9、词频统计数据转化流程图二、使用SparkSQL计算总分与平均分(一)提出任务(二)完成任务1、准备数据文件2、新建Maven项目3、修

- 【大数据学习 | Spark-Core】RDD的概念与Spark任务的执行流程

Vez'nan的幸福生活

大数据sparkoraclesqljson

1.RDD的设计背景在实际应用中,存在许多迭代式计算,这些应用场景的共同之处是,不同计算阶段之间会重用中间结果,即一个阶段的输出结果会作为下一个阶段的输入。但是,目前的MapReduce框架都是把中间结果写入到HDFS中,带来了大量的数据复制、磁盘IO和序列化开销。显然,如果能将结果保存在内存当中,就可以大量减少IO。RDD就是为了满足这种需求而出现的,它提供了一个抽象的数据架构,我们不必担心底层

- 数据库和数据仓库区别

hhhecker

Hadoop学习数据仓库数据库hive

HIve与Mysql对比HiveMysql数据存储位置HDFS本地磁盘数据格式用户定义系统决定数据更新不支持(不支持修改和删除)支持(支持增删改查)索引有,但较弱,一般很少用有,经常使用的执行MapReduceExecutor执行延迟高低可扩展性高低数据规模大小数据库与数据仓库对比数据库:传统的关系型数据库主要应用在基本的事务处理,例如银行交易之类的场景数据库支持增删改查这些常见的操作。数据仓库:

- Spark RDD 之 Partition

博弈史密斯

SparkRDD怎么理解RDD的粗粒度模式?对比细粒度模式SparkRDD的task数量是由什么决定的?一份待处理的原始数据会被按照相应的逻辑(例如jdbc和hdfs的split逻辑)切分成n份,每份数据对应到RDD中的一个Partition,Partition的数量决定了task的数量,影响着程序的并行度支持保存点(checkpoint)虽然RDD可以通过lineage实现faultrecove

- 深入解析Hadoop中的Region分裂与合并机制

码字的字节

hadoop布道师hadoop大数据分布式Region分裂合并

Hadoop与Region的基本概念Hadoop的分布式架构基础作为大数据处理的核心框架,Hadoop通过分布式存储和计算解决了海量数据的处理难题。其架构核心由HDFS(HadoopDistributedFileSystem)和MapReduce组成,前者负责数据的分布式存储,后者实现分布式计算。在HDFS中,数据被分割成固定大小的块(默认128MB)分散存储在集群节点上,而MapReduce则通

- 大数据技术关键技术组件

大数据技术是一组用于处理、分析和管理大规模数据集的复杂方法和技术。这些数据集的特点是容量大、增长速度快,且结构多样化,包括结构化、半结构化和非结构化数据。传统数据库管理和分析工具在处理此类数据时效率低下或无法胜任,因此需要专门的大数据技术栈来支持高效的数据处理和智能决策。大数据技术的关键组件通常包括:分布式存储系统:HadoopDistributedFileSystem(HDFS):一个高度可扩展

- 大数据领域HDFS的集群资源管理优化

大数据洞察

大数据与AI人工智能大数据AI应用大数据hdfshadoopai

大数据领域HDFS的集群资源管理优化关键词:HDFS;集群资源管理;存储优化;性能调优;副本策略;负载均衡;NameNode优化摘要:HDFS(Hadoop分布式文件系统)作为大数据领域的基石,承载着海量数据的存储与管理重任。随着数据规模爆炸式增长和业务复杂度提升,HDFS集群的资源管理面临着"存不下、跑不快、管不好"的三重挑战:存储资源浪费与不足并存、计算与存储资源匹配失衡、集群运维效率低下。本

- 深入探索Hadoop技术:全面学习指南

引言在大数据时代,高效地存储、处理和分析海量数据已成为企业决策与创新的关键驱动力。Hadoop,作为开源的大数据处理框架,以其强大的分布式存储和并行计算能力,以及丰富的生态系统,为企业提供了应对大规模数据挑战的有效解决方案。本文旨在为初学者和进阶者提供一份详尽的Hadoop技术学习指南,涵盖HDFS、MapReduce、YARN等核心组件,以及Hive、Pig、HBase等生态系统工具,助您踏上H

- HDFS文件系统

HDFS文件系统是hadoop生态系统的核心,主要用于分布式文件存储,它具备高可用,流式读取,文件结构简单,跨平台的特点,它的集群采用的是主从结构,分为命名节点和数据节点,命名节点主要用于元数据管理(例如对目录,文件的创建,数据块与数据节点的关系维护管理)及数据节点管理(例如数据节点之间数据的复制,节点状态的维护,节点间数据的均衡),该文件系统最基本的存储单位是block即数据块,默认大小是64M

- Flink-Hadoop实战项目

Dylan_muc

hadoophdfsflink

项目说明文档1.项目概述1.1项目简介本项目是一个基于ApacheFlink的大数据流处理平台,专门用于处理铁路系统的票务和车次信息数据。系统包含两个核心流处理作业:文件处理作业和数据合并作业,采用定时调度机制,支持Kerberos安全认证,实现从文件读取到数据仓库存储的完整数据处理链路。1.2技术栈流处理引擎:ApacheFlink1.18.1存储系统:HDFS(Hadoop分布式文件系统)数据

- 大数据集群运维常见的一些问题以及处理方式

态);若为YARN节点,重启NodeManager后手动将其加入集群。若为节点整体宕机:排查电源和网络,重启节点后,依次启动HDFS、YARN等服务进程,确认数据块完整性(避免因节点宕机导致副本不足)。2.网络问题现象:节点间通信超时(如HDFS心跳超时、YARN任务调度延迟)、数据传输卡顿。可能原因:交换机故障、网线松动、网络带宽过载、防火墙规则拦截。处理方式:用ping、traceroute检

- hadoop 集群问题处理

一切顺势而行

hadoop大数据分布式

1.1.JournalNode的作用在HDFSHA配置中,为了实现两个NameNode之间的状态同步和故障自动切换,Hadoop使用了一组JournalNode来管理共享的编辑日志。具体来说,JournalNode的主要职责包括:共享编辑日志:JournalNode节点组成了一个分布式系统,用于存储HDFS的编辑日志(EditLogs)。这两个日志文件记录了对HDFS所做的所有更改,如文件创建、删

- sqoop从mysql导数据到hdfs,出现java.lang.ClassNotFoundException: Class QueryResult not found

无级程序员

大数据sqoopmysqlhdfs

运行sqoop从postgresql/mysql导入数据到hdfs,结果出现如下错误:2025-07-1816:59:13,624INFOorm.CompilationManager:HADOOP_MAPRED_HOMEis/opt/datasophon/hadoop-3.3.3Note:/opt/sqoop/bin/QueryResult.javausesoroverridesadeprecat

- hive的sql优化思路-明白底层运行逻辑

ycllycll

hivesqlhadoop

一、首先要明白底层map、shuffle、reduce的顺序之中服务器hdfs数据文件在内存与存储之中是怎么演变的,因为hive的性能瓶颈基本在内存,具体参考以下他人优秀文章:1.HiveSQL底层执行过程详细剖析2.HiveJOIN性能调优二是要明白hive对应的sql它底层的mapreduce的过程中sql字段的执行顺序,来理解map的key、value会填充什么值,才能深刻理解怎么一步一步的

- 六、深度剖析 Hadoop 分布式文件系统(HDFS)的数据存储机制与读写流程

深度剖析Hadoop分布式文件系统(HDFS)的数据存储机制与读写流程在当今大数据领域当中,Hadoop分布式文件系统(HDFS)作为极为关键的核心组件之一,为海量规模的数据的存储以及处理构筑起了坚实无比的根基。本文将会对HDFS的数据存储机制以及读写流程展开全面且深入的探究,通过将原理与实际的实例紧密结合的方式,助力广大读者更加全面地理解HDFS的工作原理以及其具体的应用场景。一、HDFS概述H

- 大数据处理技术:分布式文件系统HDFS

茜茜西西CeCe

hdfshadoop大数据HDFS-JAVA接口文件头歌Java

目录1实验名称:2实验目的3实验内容4实验原理5实验过程或源代码5.1HDFS的基本操作5.2HDFS-JAVA接口之读取文件5.3HDFS-JAVA接口之上传文件5.4HDFS-JAVA接口之删除文件6实验结果6.1HDFS的基本操作6.2HDFS-JAVA接口之读取文件6.3HDFS-JAVA接口之上传文件6.4HDFS-JAVA接口之删除文件1实验名称:分布式文件系统HDFS2实验目的1.理

- cdh6.3.2的hive使用apache paimon格式只能创建不能写报错的问题

明天,今天,此时

hivepaimon

前言 根据官网paimon安装教程,看上去简单,实则报错阻碍使用的信心。解决方法 原带的jars下的zstd开头的包旧了,重新下载zstd较新的包单独放到每个节点的hive/lib下; 然后将hdfsyarn用户下的mr-framework.tar.gz中的zstdjar包替换成新的版本。 重启就可以了总结 国外软件问题,尽量使用英文搜索,特别是google.。方法来源:http

- Hadoop与云原生集成:弹性扩缩容与OSS存储分离架构深度解析

Hadoop与云原生集成的必要性Hadoop在大数据领域的基石地位作为大数据处理领域的奠基性技术,Hadoop自2006年诞生以来已形成包含HDFS、YARN、MapReduce三大核心组件的完整生态体系。根据CSDN技术社区的分析报告,全球超过75%的《财富》500强企业仍在使用Hadoop处理EB级数据,其分布式文件系统HDFS通过数据分片(默认128MB块大小)和三副本存储机制,成功解决了P

- ETL可视化工具 DataX -- 简介( 一)

dazhong2012

软件工具数据仓库dataxETL

引言DataX系列文章:ETL可视化工具DataX–安装部署(二)ETL可视化工具DataX–DataX-Web安装(三)1.1DataX1.1.1DataX概览DataX是阿里云DataWorks数据集成的开源版本,在阿里巴巴集团内被广泛使用的离线数据同步工具/平台。DataX实现了包括MySQL、Oracle、OceanBase、SqlServer、Postgre、HDFS、Hive、ADS、

- Hive简介

文章目录Hive简介Hive特点Hive和RDBMS的对比Hive的架构Hive的数据组织Hive数据类型Hive简介1、Hive由Facebook实现并开源2、是基于Hadoop的一个数据仓库工具3、可以将结构化的数据映射为一张数据库表4、并提供HQL(HiveSQL)查询功能5、底层数据是存储在HDFS上6、Hive的本质是将SQL语句转换为MapReduce任务运行7、使不熟悉MapRedu

- ftp文件服务器有连接数限制,查看ftp服务器连接数命令

赵承铭

ftp文件服务器有连接数限制

查看ftp服务器连接数命令内容精选换一换本章节适用于MRS3.x之前版本。Loader支持以下多种连接,每种连接的配置介绍可根据本章节内容了解。obs-connectorgeneric-jdbc-connectorftp-connector或sftp-connectorhbase-connector、hdfs-connector或hive-connectorOBS连接是Loa“数据导入”章节适用于

- ClickHouse高频面试题

野老杂谈

数据库

ClickHouse高频面试题1、简单介绍一下ClickHouse2、ClickHouse具有哪些特点3、ClickHouse作为一款高性能OLAP数据库,存在哪些不足4、ClickHouse有哪些表引擎5、介绍下Log系列表引擎应用场景共性特点不支持6、简单介绍下MergeTree系列引擎7、简单介绍下外部集成表引擎ODBCJDBCMySQLHDFSKafkaRabbitMQ8、ClickHou

- HDFS 伪分布模式搭建与使用全攻略(适合初学者 & 开发测试环境)

huihui450

hdfshadoop大数据

HDFS(HadoopDistributedFileSystem)作为Hadoop生态系统的核心组件,广泛应用于海量数据的分布式存储场景。对于开发者而言,伪分布模式提供了一种低成本、高还原度的学习与测试方式。本文将详细介绍如何在本地搭建并使用HDFS的伪分布模式,包括环境准备、配置过程、常用命令及常见问题排查,帮助你快速入门Hadoop分布式文件系统的实践操作。一、什么是伪分布模式?Hadoop有

- MapReduce学习笔记

1.MapReduce做什么Mapper负责“分”,即把复杂的任务分解为若干个“简单的任务”来处理。Reducer负责对map阶段的结果进行汇总。2.MapReduce工作机制实体一:客户端,用来提交MapReduce作业。实体二:JobTracker,用来协调作业的运行。实体三:TaskTracker,用来处理作业划分后的任务。实体四:HDFS,用来在其它实体间共享作业文件。3.编写MapRed

- java线程的无限循环和退出

3213213333332132

java

最近想写一个游戏,然后碰到有关线程的问题,网上查了好多资料都没满足。

突然想起了前段时间看的有关线程的视频,于是信手拈来写了一个线程的代码片段。

希望帮助刚学java线程的童鞋

package thread;

import java.text.SimpleDateFormat;

import java.util.Calendar;

import java.util.Date

- tomcat 容器

BlueSkator

tomcatWebservlet

Tomcat的组成部分 1、server

A Server element represents the entire Catalina servlet container. (Singleton) 2、service

service包括多个connector以及一个engine,其职责为处理由connector获得的客户请求。

3、connector

一个connector

- php递归,静态变量,匿名函数使用

dcj3sjt126com

PHP递归函数匿名函数静态变量引用传参

<!doctype html>

<html lang="en">

<head>

<meta charset="utf-8">

<title>Current To-Do List</title>

</head>

<body>

- 属性颜色字体变化

周华华

JavaScript

function changSize(className){

var diva=byId("fot")

diva.className=className;

}

</script>

<style type="text/css">

.max{

background: #900;

color:#039;

- 将properties内容放置到map中

g21121

properties

代码比较简单:

private static Map<Object, Object> map;

private static Properties p;

static {

//读取properties文件

InputStream is = XXX.class.getClassLoader().getResourceAsStream("xxx.properti

- [简单]拼接字符串

53873039oycg

字符串

工作中遇到需要从Map里面取值拼接字符串的情况,自己写了个,不是很好,欢迎提出更优雅的写法,代码如下:

import java.util.HashMap;

import java.uti

- Struts2学习

云端月影

最近开始关注struts2的新特性,从这个版本开始,Struts开始使用convention-plugin代替codebehind-plugin来实现struts的零配置。

配置文件精简了,的确是简便了开发过程,但是,我们熟悉的配置突然disappear了,真是一下很不适应。跟着潮流走吧,看看该怎样来搞定convention-plugin。

使用Convention插件,你需要将其JAR文件放

- Java新手入门的30个基本概念二

aijuans

java新手java 入门

基本概念: 1.OOP中唯一关系的是对象的接口是什么,就像计算机的销售商她不管电源内部结构是怎样的,他只关系能否给你提供电就行了,也就是只要知道can or not而不是how and why.所有的程序是由一定的属性和行为对象组成的,不同的对象的访问通过函数调用来完成,对象间所有的交流都是通过方法调用,通过对封装对象数据,很大限度上提高复用率。 2.OOP中最重要的思想是类,类是模板是蓝图,

- jedis 简单使用

antlove

javarediscachecommandjedis

jedis.RedisOperationCollection.java

package jedis;

import org.apache.log4j.Logger;

import redis.clients.jedis.Jedis;

import java.util.List;

import java.util.Map;

import java.util.Set;

pub

- PL/SQL的函数和包体的基础

百合不是茶

PL/SQL编程函数包体显示包的具体数据包

由于明天举要上课,所以刚刚将代码敲了一遍PL/SQL的函数和包体的实现(单例模式过几天好好的总结下再发出来);以便明天能更好的学习PL/SQL的循环,今天太累了,所以早点睡觉,明天继续PL/SQL总有一天我会将你永远的记载在心里,,,

函数;

函数:PL/SQL中的函数相当于java中的方法;函数有返回值

定义函数的

--输入姓名找到该姓名的年薪

create or re

- Mockito(二)--实例篇

bijian1013

持续集成mockito单元测试

学习了基本知识后,就可以实战了,Mockito的实际使用还是比较麻烦的。因为在实际使用中,最常遇到的就是需要模拟第三方类库的行为。

比如现在有一个类FTPFileTransfer,实现了向FTP传输文件的功能。这个类中使用了a

- 精通Oracle10编程SQL(7)编写控制结构

bijian1013

oracle数据库plsql

/*

*编写控制结构

*/

--条件分支语句

--简单条件判断

DECLARE

v_sal NUMBER(6,2);

BEGIN

select sal into v_sal from emp

where lower(ename)=lower('&name');

if v_sal<2000 then

update emp set

- 【Log4j二】Log4j属性文件配置详解

bit1129

log4j

如下是一个log4j.properties的配置

log4j.rootCategory=INFO, stdout , R

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appe

- java集合排序笔记

白糖_

java

public class CollectionDemo implements Serializable,Comparable<CollectionDemo>{

private static final long serialVersionUID = -2958090810811192128L;

private int id;

private String nam

- java导致linux负载过高的定位方法

ronin47

定位java进程ID

可以使用top或ps -ef |grep java

![图片描述][1]

根据进程ID找到最消耗资源的java pid

比如第一步找到的进程ID为5431

执行

top -p 5431 -H

![图片描述][2]

打印java栈信息

$ jstack -l 5431 > 5431.log

在栈信息中定位具体问题

将消耗资源的Java PID转

- 给定能随机生成整数1到5的函数,写出能随机生成整数1到7的函数

bylijinnan

函数

import java.util.ArrayList;

import java.util.List;

import java.util.Random;

public class RandNFromRand5 {

/**

题目:给定能随机生成整数1到5的函数,写出能随机生成整数1到7的函数。

解法1:

f(k) = (x0-1)*5^0+(x1-

- PL/SQL Developer保存布局

Kai_Ge

近日由于项目需要,数据库从DB2迁移到ORCAL,因此数据库连接客户端选择了PL/SQL Developer。由于软件运用不熟悉,造成了很多麻烦,最主要的就是进入后,左边列表有很多选项,自己删除了一些选项卡,布局很满意了,下次进入后又恢复了以前的布局,很是苦恼。在众多PL/SQL Developer使用技巧中找到如下这段:

&n

- [未来战士计划]超能查派[剧透,慎入]

comsci

计划

非常好看,超能查派,这部电影......为我们这些热爱人工智能的工程技术人员提供一些参考意见和思想........

虽然电影里面的人物形象不是非常的可爱....但是非常的贴近现实生活....

&nbs

- Google Map API V2

dai_lm

google map

以后如果要开发包含google map的程序就更麻烦咯

http://www.cnblogs.com/mengdd/archive/2013/01/01/2841390.html

找到篇不错的文章,大家可以参考一下

http://blog.sina.com.cn/s/blog_c2839d410101jahv.html

1. 创建Android工程

由于v2的key需要G

- java数据计算层的几种解决方法2

datamachine

javasql集算器

2、SQL

SQL/SP/JDBC在这里属于一类,这是老牌的数据计算层,性能和灵活性是它的优势。但随着新情况的不断出现,单纯用SQL已经难以满足需求,比如: JAVA开发规模的扩大,数据量的剧增,复杂计算问题的涌现。虽然SQL得高分的指标不多,但都是权重最高的。

成熟度:5星。最成熟的。

- Linux下Telnet的安装与运行

dcj3sjt126com

linuxtelnet

Linux下Telnet的安装与运行 linux默认是使用SSH服务的 而不安装telnet服务 如果要使用telnet 就必须先安装相应的软件包 即使安装了软件包 默认的设置telnet 服务也是不运行的 需要手工进行设置 如果是redhat9,则在第三张光盘中找到 telnet-server-0.17-25.i386.rpm

- PHP中钩子函数的实现与认识

dcj3sjt126com

PHP

假如有这么一段程序:

function fun(){

fun1();

fun2();

}

首先程序执行完fun1()之后执行fun2()然后fun()结束。

但是,假如我们想对函数做一些变化。比如说,fun是一个解析函数,我们希望后期可以提供丰富的解析函数,而究竟用哪个函数解析,我们希望在配置文件中配置。这个时候就可以发挥钩子的力量了。

我们可以在fu

- EOS中的WorkSpace密码修改

蕃薯耀

修改WorkSpace密码

EOS中BPS的WorkSpace密码修改

>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>

蕃薯耀 201

- SpringMVC4零配置--SpringSecurity相关配置【SpringSecurityConfig】

hanqunfeng

SpringSecurity

SpringSecurity的配置相对来说有些复杂,如果是完整的bean配置,则需要配置大量的bean,所以xml配置时使用了命名空间来简化配置,同样,spring为我们提供了一个抽象类WebSecurityConfigurerAdapter和一个注解@EnableWebMvcSecurity,达到同样减少bean配置的目的,如下:

applicationContex

- ie 9 kendo ui中ajax跨域的问题

jackyrong

AJAX跨域

这两天遇到个问题,kendo ui的datagrid,根据json去读取数据,然后前端通过kendo ui的datagrid去渲染,但很奇怪的是,在ie 10,ie 11,chrome,firefox等浏览器中,同样的程序,

浏览起来是没问题的,但把应用放到公网上的一台服务器,

却发现如下情况:

1) ie 9下,不能出现任何数据,但用IE 9浏览器浏览本机的应用,却没任何问题

- 不要让别人笑你不能成为程序员

lampcy

编程程序员

在经历六个月的编程集训之后,我刚刚完成了我的第一次一对一的编码评估。但是事情并没有如我所想的那般顺利。

说实话,我感觉我的脑细胞像被轰炸过一样。

手慢慢地离开键盘,心里很压抑。不禁默默祈祷:一切都会进展顺利的,对吧?至少有些地方我的回答应该是没有遗漏的,是不是?

难道我选择编程真的是一个巨大的错误吗——我真的永远也成不了程序员吗?

我需要一点点安慰。在自我怀疑,不安全感和脆弱等等像龙卷风一

- 马皇后的贤德

nannan408

马皇后不怕朱元璋的坏脾气,并敢理直气壮地吹耳边风。众所周知,朱元璋不喜欢女人干政,他认为“后妃虽母仪天下,然不可使干政事”,因为“宠之太过,则骄恣犯分,上下失序”,因此还特地命人纂述《女诫》,以示警诫。但马皇后是个例外。

有一次,马皇后问朱元璋道:“如今天下老百姓安居乐业了吗?”朱元璋不高兴地回答:“这不是你应该问的。”马皇后振振有词地回敬道:“陛下是天下之父,

- 选择某个属性值最大的那条记录(不仅仅包含指定属性,而是想要什么属性都可以)

Rainbow702

sqlgroup by最大值max最大的那条记录

好久好久不写SQL了,技能退化严重啊!!!

直入主题:

比如我有一张表,file_info,

它有两个属性(但实际不只,我这里只是作说明用):

file_code, file_version

同一个code可能对应多个version

现在,我想针对每一个code,取得它相关的记录中,version 值 最大的那条记录,

SQL如下:

select

*

- VBScript脚本语言

tntxia

VBScript

VBScript 是基于VB的脚本语言。主要用于Asp和Excel的编程。

VB家族语言简介

Visual Basic 6.0

源于BASIC语言。

由微软公司开发的包含协助开发环境的事

- java中枚举类型的使用

xiao1zhao2

javaenum枚举1.5新特性

枚举类型是j2se在1.5引入的新的类型,通过关键字enum来定义,常用来存储一些常量.

1.定义一个简单的枚举类型

public enum Sex {

MAN,

WOMAN

}

枚举类型本质是类,编译此段代码会生成.class文件.通过Sex.MAN来访问Sex中的成员,其返回值是Sex类型.

2.常用方法

静态的values()方