- 输入hadoop version时,解决Cannot execute /home/hadoop/libexec/hadoop-config.sh.的方法

有奇妙能力吗

ubuntuhadoophdfslinux大数据分布式

在ubuntu用hadoopversion遇到了一个错误:Cannotexecute/home/hadoop/hadoop2.8/libexec/hadoop-config.sh.解决方法:在/etc/profile中找到了这个HADOOP_HOME全局变量,将其删除运行source/etc/profile输入vim.bashrc命令,在最后一行输入unsetHADOOP_HOMEsource.b

- 什么是Hadoop Yarn

ThisIsClark

大数据hadoop大数据分布式

HadoopYARN:分布式集群资源管理系统详解1.什么是YARN?YARN(YetAnotherResourceNegotiator)是ApacheHadoop生态系统中的资源管理和作业调度系统,最初在Hadoop2.0中引入,取代了Hadoop1.0的MapReduce1(MRv1)架构。它的核心目标是提高集群资源利用率,并支持多种计算框架(如MapReduce、Spark、Flink等)在同

- 虚拟机hadoop集群启动时DataNode进程缺失

Magicalapologize

hadooplinux大数据

虚拟机hadoop集群启动时DataNode进程缺失1.出现问题:在Linux命令窗口中输入Jps查询hadoop启动项目时缺少DataNode进程;2.问题原因:使用格式化命令之后又再次进行格式化,导致namenodeDatas文件序列号不一致使之启动失败3.解决方案:删除三台虚拟机hadoop2.7.5安装目录下/export/install/hadoop-2.7.5/hadoopDatas中

- Hadoop 端口号及常用配置文件

m0_63648117

hadoophadoop大数据分布式

一、常用端口号hadoop3.x:HDFSNameNode内部通常端口:8020/9000/9820HDFSNameNode对用户的查询端口:9870Yarn查看任务运行情况的端口:8088历史服务器:19888hadoop2.x:HDFSNameNode内部通常端口:8020/9000HDFSNameNode对用户的查询端口:50070Yarn查看任务运行情况的端口:8088历史服务器:1988

- Hadoop常用端口及配置文件

耐码

hadoop大数据

Hadoop常用端口号Hadoop常用端口号Hadoop2.XHadoop3.XHDFSNameNode内部通信端口8020/90008020/9000/9820HDFSNameNodeweb端口500709870HDFSDataNodeweb端口500759864Yarn查看任务端口80888088历史服务器通信端口1988819888Hadoop常用配置文件Hadoop3.Xcore-site

- Hadoop常用端口号和配置文件

jiedaodezhuti

hadoop大数据分布式

常用端口号有:hadoop2.xHadoop3.x访问HDFS端口500709870访问MR执行情况端口80888088历史服务器1988819888客户端访问集群端口90008020常用配置文件hadoop2.xcore-site.xml、hdfs-site.xml、mapred-site.xml、yarn-site.xmlslaveshadoop3.xcore-site.xml、hdfs-si

- Hadoop的组成,HDFS架构,YARN架构概述

计算机人哪有不疯的

hadoop数据库大数据spark

Hadoop的组成Hadoop1.X时代,Hadoop中的MapReduce同时处理业务逻辑运算和资源的调度,耦合性较大。Hadoop2.X时代,增加了Yarn,Yarn只负责资源的调度,MapReduce只负责运算。Hadoop3.X时代,在组成上并没有变化。一共有四个组成部分:MapReduce计算,Yarn资源调度,HDFS数据存储,Common辅助工具。HDFS架构HadoopDistri

- sqoop到数据到mysql报错_hadoop sqoop 同步hive数据到mysql报错 classnotfound

Sinaean Dean

今天在CDH5.4.4环境下,用sqoop导出mysql数据,然后再导入hive,成功用sqoop同步hive数据到mysql失败,求大神答疑:1.hive下有一个表testamysql下有一个表testa结构一样2.版本hadoop2.6CDH5.4.4sqoop1.4.5-CDH5.4.4JDK1.7MySQL5.53.导数命令为sqoopexport-Dmapred.job.queue.na

- ssh免密 linux 极简教程

青瓜先生

大数据hadoopssh大数据linux

解决hadoop集群ssh免密登录通信问题1、家目录/home/xxx/.ssh文件夹下[xxx@hadoop201~]$cd/home/xxx/.ssh2、生成公钥和私钥:[

[email protected]]$ssh-keygen-trsa#然后敲(三个回车),就会生成两个文件id_rsa(私钥)、id_rsa.pub(公钥)3、将公钥拷贝到要免密登录的目标机器上[xxx@hadoop201.

- hadoop+hive+spark+zookeeper+hbase大数据环境搭建

fengwuxichen

大数据hadoopsparkhbase

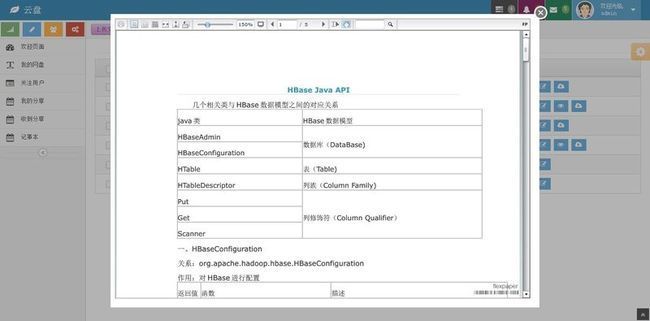

1.硬件环境主机名IP地址操作系统master172.16.34.101CentOSLinuxrelease7.3.1611slave01172.16.34.102CentOSLinuxrelease7.3.1611slave03172.16.34.103CentOSLinuxrelease7.3.16112.软件版本软件名称版本hadoop2.7.7hive1.2.2spark2.3.4zook

- 《云计算》第三版总结

冰菓Neko

书籍云计算

《云计算》第三版总结云计算体系结构云计算成本优势开源云计算架构Hadoop2.0Hadoop体系架构Hadoop访问接口Hadoop编程接口Hadoop大家族分布式组件概述ZooKeeperHbasePigHiveOozieFlumeMahout虚拟化技术服务器虚拟化存储虚拟化网络虚拟化桌面虚拟化OpenStack开源虚拟化平台NovaSwiftGlance云计算核心算法PaxosDHTGossi

- 《大数据: Spark Standalone 模式配置历史服务器》

HarkerYX

一、配置历史服务器1.上一篇说到Standalone集群模式时候客户端看不到信息,driver:8081虽然能看到日志和结果,但是体验非常差2.spark-shell本身就是客户端模式,这个是改不了为cluster模式,并且运行时候日志打印是有,但是一旦退出了再也没地方看到日志了yexiang@hadoop2:$bin/spark-shell\>--masterspark://hadoop2:70

- spark配置历史服务

都教授2000

大数据spark

1:配置spark-default.conf文件,开启Logcpspark-defaults.conf.templatespark-defaults.conf在spark-defaults.conf文件中,添加如下内容:spark.eventLog.enabledtruespark.eventLog.dirhdfs://hadoop213:9000/spark-job-log2:修改spark-e

- Hive安装与配置教程

爱编程的王小美

hivehadoop数据仓库

Hive安装与配置教程1.环境准备1.1系统要求Java8或更高版本Hadoop2.x或更高版本MySQL或其他关系型数据库(用于存储元数据)1.2安装依赖#安装Javasudoaptupdatesudoaptinstallopenjdk-8-jdk#安装MySQLsudoaptinstallmysql-server2.下载并安装Hive2.1下载Hive#创建安装目录sudomkdir-p/us

- [大数据技术与应用省赛学习记录一]——软件准备

Ench77

大数据技术与应用比赛筹备大数据

@JIAQI第一章大数据平台环境搭建在指定主机上完成Hadoop完全分布式、Spark、Flink、kafka、flume的安装配置赛前准备主办方要求使用以下相关版本软件环境,仅供参考:设备类型软件类别软件名称、版本号竞赛服务器竞赛环境大数据集群操作系统Centos7大数据平台组件unbuntu18.04Hadoop2.7.7Hive2.3.4Spark2.1.1Kafka2.0.0Redis4.

- Spark总结

等雨季

spark大数据分布式

一、Spark概念:Spark是一种基于内存的快速、通用、可扩展的大数据分析计算引擎。1、SparkandHadoop的关系(1)首先从时间节点上来看:➢Hadoop2006年1月,DougCutting加入Yahoo,领导Hadoop的开发2008年1月,Hadoop成为Apache顶级项目2011年1.0正式发布2012年3月稳定版发布2013年10月发布2.X(Yarn)版本➢Spark20

- Ubuntu下安装Hive3.1.2教程(附MySQL安装方法及安装包)

hjseo_seg

面试阿里巴巴mysqlubuntuhadoop开发语言人工智能

文章目录前言一、安装Hive1.下载压缩包并解压2.安装Hive3.配置环境变量4.修改配置文件二、MySQL安装与配置1.安装MySQL2.安装MySQLjdbc包3.为Hive创建MySQL账号三、验证Hive安装及错误处理1.启动Hadoop2.启动hive3.运行Hive实例总结前言Hive的安装需要建立在Hadoop的之上(类似于Hbase),关于Hadoop的单机安装以及伪分布式安装可

- 架构中 MapReduce 的资源管理和计算框架耦合 的问题

Yarn(全称为YetAnotherResourceNegotiator,译为"另一个资源协调者")在Hadoop2.0版本中引入,其诞生是为了解决Hadoop1.x架构中MapReduce的资源管理和计算框架耦合的问题。简而言之,就是之前MapReduce的资源管理和计算框架是耦合在一起的,为了解耦而设计出了Yarn。Yarn是一种新的Hadoop资源管理器,它是一个通用资源管理系统,提供统一的

- yarn的定义

yyywoaini~

java开发语言

###YARN的定义及其在Hadoop生态系统中的角色####1.**YARN的定义**YARN(YetAnotherResourceNegotiator)是Hadoop2.x版本引入的一个全新资源管理和作业调度框架。它的主要目标是分离资源管理和任务调度的功能,从而提高系统的灵活性和扩展性。YARN的设计允许不同的计算框架(如MapReduce、Spark、Flink等)在同一Hadoop集群中共

- 【HDFS入门】Hadoop 2.0+ HDFS核心架构深度解析:高可用设计揭秘

IT成长日记

大数据成长笔记hadoophdfs架构高可用

目录1HDFS核心架构概述2高可用设计背景3HDFS核心组件3.1Active与StandbyNameNode3.2JournalNode3.3ZKFailoverController(ZKFC)3.4DataNode4高可用设计的工作流程写入阶段:元数据同步:健康监测:故障转移:5高可用设计的优势6总结1HDFS核心架构概述Hadoop2.0及以后版本的HDFS(HadoopDistribute

- spark配置——local模式-yarn模式-spark集群

邪王真眼是最强的哦耶

sparkscalabigdata大数据

准备三台配置hadoop集群的虚拟机(分别是hadoop0、hadoop1和hadoop2)下载spark,scala,anacondaspark下载地址scala下载地址Anaconda下载地址将下载的软件上传到虚拟机上local模式解压spark和scala,并重命名到program文件夹下tar-zxvfscala-2.12.15.tgztar-zxvfspark-3.0.3-bin-had

- 【Hadoop】Yarn资源管理调度

大数据hadoopyarn

一、Yarn产生背景Yarn(全称为YetAnotherResourceNegotiator,译为"另一个资源协调者")在Hadoop2.0版本中引入,其诞生是为了解决Hadoop1.x架构中MapReduce的资源管理和计算框架耦合的问题。简而言之,就是之前MapReduce的资源管理和计算框架是耦合在一起的,为了解耦而设计出了Yarn。Yarn是一种新的Hadoop资源管理器,它是一个通用资源

- kafka connect,将数据批量写到hdfs完整过程

weixin_34162401

大数据数据库json

为什么80%的码农都做不了架构师?>>>本文是基于hadoop2.7.1,以及kafka0.11.0.0。kafka-connect是以单节点模式运行,即standalone。一.kafka和kafkaconnect简介kafka:Kafka是一种高吞吐量的分布式发布订阅消息系统,它可以处理消费者规模的网站中的所有动作流数据。比较直观的解释就是其有一个生产者(producer)和一个消费者(con

- hadoop集群配置-scp拓展使用

杜清卿

hadoop服务器大数据

任务1:在hadoop102上,将hadoop101中/opt/module/hadoop-3.1.3目录拷贝到hadoop102上。分析:使用scp进行拉取操作:先登录到hadoop2使用命令:scp-rroot@hadoop101:/opt/module/hadoop-3.1.3/opt/module/任务2:在hadoop101上操作,将hadoop100中/opt/module目录下所有目

- CentOS 7系统中hadoop的安装和环境配置

代码小张z

centoshadooplinux

1.创建Hadoop安装解压路径:mkdir-p/usr/hadoop2.进入路径:cd/usr/hadoop3.下载安装包(我这里用的是阿里云镜像压缩包):wgethttps://mirrors.aliyun.com/apache/hadoop/common/hadoop-3.3.5/hadoop-3.3.5.tar.gz4.解压安装包到hadoop文件路径:tar-zxvf/usr/hadoo

- hadoop运行java程序命令_使用命令行编译打包运行自己的MapReduce程序 Hadoop2.6.0

emi0wb

网上的MapReduceWordCount教程对于如何编译WordCount.java几乎是一笔带过…而有写到的,大多又是0.20等旧版本版本的做法,即javac-classpath/usr/local/hadoop/hadoop-1.0.1/hadoop-core-1.0.1.jarWordCount.java,但较新的2.X版本中,已经没有hadoop-core*.jar这个文件,因此编辑和打

- docker-compose -volumes 两种不同定义方式

胖胖胖胖胖虎

Dockerdockerhadoopbigdata

学习docker-compose部署hadoop集群、看到docker-compose一种不同volumes定义方式version:"3"services:namenode:image:bde2020/hadoop-namenode:2.0.0-hadoop2.7.4-java8volumes:-namenode:/hadoop/dfs/nameenvironment:-CLUSTER_NAME=

- spark程序提交到集群上_Spark集群模式&Spark程序提交

毫无特色

spark程序提交到集群上

Spark集群模式&Spark程序提交1.集群管理器Spark当前支持三种集群管理方式Standalone—Spark自带的一种集群管理方式,易于构建集群。ApacheMesos—通用的集群管理,可以在其上运行HadoopMapReduce和一些服务应用。HadoopYARN—Hadoop2中的资源管理器。Tip1:在集群不是特别大,并且没有mapReduce和Spark同时运行的需求的情况下,用

- Hadoop常用端口号

海洋 之心

Hadoop问题解决hadoophbase大数据

Hadoop是一个由多个组件构成的分布式系统,每个组件都会使用一些特定的端口号来进行通信和交互。以下是Hadoop2.x常用的端口号列表:HDFS端口号:NameNode:50070SecondaryNameNode:50090DataNode:50010DataNode(数据传输):50020YARN端口号:ResourceManager:8088NodeManager:8042MapReduc

- Ubuntu下配置安装Hadoop 2.2

weixin_30501857

大数据java运维

---恢复内容开始---这两天玩Hadoop,之前在我的Mac上配置了好长时间都没成功的Hadoop环境,今天想在win7虚拟机下的Ubuntu12.0464位机下配置,然后再建一个组群看一看。参考资料:1.InstallingsinglenodeHadoop2.2.0onUbuntu:http://bigdatahandler.com/hadoop-hdfs/installing-single-

- JAVA中的Enum

周凡杨

javaenum枚举

Enum是计算机编程语言中的一种数据类型---枚举类型。 在实际问题中,有些变量的取值被限定在一个有限的范围内。 例如,一个星期内只有七天 我们通常这样实现上面的定义:

public String monday;

public String tuesday;

public String wensday;

public String thursday

- 赶集网mysql开发36条军规

Bill_chen

mysql业务架构设计mysql调优mysql性能优化

(一)核心军规 (1)不在数据库做运算 cpu计算务必移至业务层; (2)控制单表数据量 int型不超过1000w,含char则不超过500w; 合理分表; 限制单库表数量在300以内; (3)控制列数量 字段少而精,字段数建议在20以内

- Shell test命令

daizj

shell字符串test数字文件比较

Shell test命令

Shell中的 test 命令用于检查某个条件是否成立,它可以进行数值、字符和文件三个方面的测试。 数值测试 参数 说明 -eq 等于则为真 -ne 不等于则为真 -gt 大于则为真 -ge 大于等于则为真 -lt 小于则为真 -le 小于等于则为真

实例演示:

num1=100

num2=100if test $[num1]

- XFire框架实现WebService(二)

周凡杨

javawebservice

有了XFire框架实现WebService(一),就可以继续开发WebService的简单应用。

Webservice的服务端(WEB工程):

两个java bean类:

Course.java

package cn.com.bean;

public class Course {

private

- 重绘之画图板

朱辉辉33

画图板

上次博客讲的五子棋重绘比较简单,因为只要在重写系统重绘方法paint()时加入棋盘和棋子的绘制。这次我想说说画图板的重绘。

画图板重绘难在需要重绘的类型很多,比如说里面有矩形,园,直线之类的,所以我们要想办法将里面的图形加入一个队列中,这样在重绘时就

- Java的IO流

西蜀石兰

java

刚学Java的IO流时,被各种inputStream流弄的很迷糊,看老罗视频时说想象成插在文件上的一根管道,当初听时觉得自己很明白,可到自己用时,有不知道怎么代码了。。。

每当遇到这种问题时,我习惯性的从头开始理逻辑,会问自己一些很简单的问题,把这些简单的问题想明白了,再看代码时才不会迷糊。

IO流作用是什么?

答:实现对文件的读写,这里的文件是广义的;

Java如何实现程序到文件

- No matching PlatformTransactionManager bean found for qualifier 'add' - neither

林鹤霄

java.lang.IllegalStateException: No matching PlatformTransactionManager bean found for qualifier 'add' - neither qualifier match nor bean name match!

网上找了好多的资料没能解决,后来发现:项目中使用的是xml配置的方式配置事务,但是

- Row size too large (> 8126). Changing some columns to TEXT or BLOB

aigo

column

原文:http://stackoverflow.com/questions/15585602/change-limit-for-mysql-row-size-too-large

异常信息:

Row size too large (> 8126). Changing some columns to TEXT or BLOB or using ROW_FORMAT=DYNAM

- JS 格式化时间

alxw4616

JavaScript

/**

* 格式化时间 2013/6/13 by 半仙

[email protected]

* 需要 pad 函数

* 接收可用的时间值.

* 返回替换时间占位符后的字符串

*

* 时间占位符:年 Y 月 M 日 D 小时 h 分 m 秒 s 重复次数表示占位数

* 如 YYYY 4占4位 YY 占2位<p></p>

* MM DD hh mm

- 队列中数据的移除问题

百合不是茶

队列移除

队列的移除一般都是使用的remov();都可以移除的,但是在昨天做线程移除的时候出现了点问题,没有将遍历出来的全部移除, 代码如下;

//

package com.Thread0715.com;

import java.util.ArrayList;

public class Threa

- Runnable接口使用实例

bijian1013

javathreadRunnablejava多线程

Runnable接口

a. 该接口只有一个方法:public void run();

b. 实现该接口的类必须覆盖该run方法

c. 实现了Runnable接口的类并不具有任何天

- oracle里的extend详解

bijian1013

oracle数据库extend

扩展已知的数组空间,例:

DECLARE

TYPE CourseList IS TABLE OF VARCHAR2(10);

courses CourseList;

BEGIN

-- 初始化数组元素,大小为3

courses := CourseList('Biol 4412 ', 'Psyc 3112 ', 'Anth 3001 ');

--

- 【httpclient】httpclient发送表单POST请求

bit1129

httpclient

浏览器Form Post请求

浏览器可以通过提交表单的方式向服务器发起POST请求,这种形式的POST请求不同于一般的POST请求

1. 一般的POST请求,将请求数据放置于请求体中,服务器端以二进制流的方式读取数据,HttpServletRequest.getInputStream()。这种方式的请求可以处理任意数据形式的POST请求,比如请求数据是字符串或者是二进制数据

2. Form

- 【Hive十三】Hive读写Avro格式的数据

bit1129

hive

1. 原始数据

hive> select * from word;

OK

1 MSN

10 QQ

100 Gtalk

1000 Skype

2. 创建avro格式的数据表

hive> CREATE TABLE avro_table(age INT, name STRING)STORE

- nginx+lua+redis自动识别封解禁频繁访问IP

ronin47

在站点遇到攻击且无明显攻击特征,造成站点访问慢,nginx不断返回502等错误时,可利用nginx+lua+redis实现在指定的时间段 内,若单IP的请求量达到指定的数量后对该IP进行封禁,nginx返回403禁止访问。利用redis的expire命令设置封禁IP的过期时间达到在 指定的封禁时间后实行自动解封的目的。

一、安装环境:

CentOS x64 release 6.4(Fin

- java-二叉树的遍历-先序、中序、后序(递归和非递归)、层次遍历

bylijinnan

java

import java.util.LinkedList;

import java.util.List;

import java.util.Stack;

public class BinTreeTraverse {

//private int[] array={ 1, 2, 3, 4, 5, 6, 7, 8, 9 };

private int[] array={ 10,6,

- Spring源码学习-XML 配置方式的IoC容器启动过程分析

bylijinnan

javaspringIOC

以FileSystemXmlApplicationContext为例,把Spring IoC容器的初始化流程走一遍:

ApplicationContext context = new FileSystemXmlApplicationContext

("C:/Users/ZARA/workspace/HelloSpring/src/Beans.xml&q

- [科研与项目]民营企业请慎重参与军事科技工程

comsci

企业

军事科研工程和项目 并非要用最先进,最时髦的技术,而是要做到“万无一失”

而民营科技企业在搞科技创新工程的时候,往往考虑的是技术的先进性,而对先进技术带来的风险考虑得不够,在今天提倡军民融合发展的大环境下,这种“万无一失”和“时髦性”的矛盾会日益凸显。。。。。。所以请大家在参与任何重大的军事和政府项目之前,对

- spring 定时器-两种方式

cuityang

springquartz定时器

方式一:

间隔一定时间 运行

<bean id="updateSessionIdTask" class="com.yang.iprms.common.UpdateSessionTask" autowire="byName" />

<bean id="updateSessionIdSchedule

- 简述一下关于BroadView站点的相关设计

damoqiongqiu

view

终于弄上线了,累趴,戳这里http://www.broadview.com.cn

简述一下相关的技术点

前端:jQuery+BootStrap3.2+HandleBars,全站Ajax(貌似对SEO的影响很大啊!怎么破?),用Grunt对全部JS做了压缩处理,对部分JS和CSS做了合并(模块间存在很多依赖,全部合并比较繁琐,待完善)。

后端:U

- 运维 PHP问题汇总

dcj3sjt126com

windows2003

1、Dede(织梦)发表文章时,内容自动添加关键字显示空白页

解决方法:

后台>系统>系统基本参数>核心设置>关键字替换(是/否),这里选择“是”。

后台>系统>系统基本参数>其他选项>自动提取关键字,这里选择“是”。

2、解决PHP168超级管理员上传图片提示你的空间不足

网站是用PHP168做的,反映使用管理员在后台无法

- mac 下 安装php扩展 - mcrypt

dcj3sjt126com

PHP

MCrypt是一个功能强大的加密算法扩展库,它包括有22种算法,phpMyAdmin依赖这个PHP扩展,具体如下:

下载并解压libmcrypt-2.5.8.tar.gz。

在终端执行如下命令: tar zxvf libmcrypt-2.5.8.tar.gz cd libmcrypt-2.5.8/ ./configure --disable-posix-threads --

- MongoDB更新文档 [四]

eksliang

mongodbMongodb更新文档

MongoDB更新文档

转载请出自出处:http://eksliang.iteye.com/blog/2174104

MongoDB对文档的CURD,前面的博客简单介绍了,但是对文档更新篇幅比较大,所以这里单独拿出来。

语法结构如下:

db.collection.update( criteria, objNew, upsert, multi)

参数含义 参数

- Linux下的解压,移除,复制,查看tomcat命令

y806839048

tomcat

重复myeclipse生成webservice有问题删除以前的,干净

1、先切换到:cd usr/local/tomcat5/logs

2、tail -f catalina.out

3、这样运行时就可以实时查看运行日志了

Ctrl+c 是退出tail命令。

有问题不明的先注掉

cp /opt/tomcat-6.0.44/webapps/g

- Spring之使用事务缘由(3-XML实现)

ihuning

spring

用事务通知声明式地管理事务

事务管理是一种横切关注点。为了在 Spring 2.x 中启用声明式事务管理,可以通过 tx Schema 中定义的 <tx:advice> 元素声明事务通知,为此必须事先将这个 Schema 定义添加到 <beans> 根元素中去。声明了事务通知后,就需要将它与切入点关联起来。由于事务通知是在 <aop:

- GCD使用经验与技巧浅谈

啸笑天

GC

前言

GCD(Grand Central Dispatch)可以说是Mac、iOS开发中的一大“利器”,本文就总结一些有关使用GCD的经验与技巧。

dispatch_once_t必须是全局或static变量

这一条算是“老生常谈”了,但我认为还是有必要强调一次,毕竟非全局或非static的dispatch_once_t变量在使用时会导致非常不好排查的bug,正确的如下: 1

- linux(Ubuntu)下常用命令备忘录1

macroli

linux工作ubuntu

在使用下面的命令是可以通过--help来获取更多的信息1,查询当前目录文件列表:ls

ls命令默认状态下将按首字母升序列出你当前文件夹下面的所有内容,但这样直接运行所得到的信息也是比较少的,通常它可以结合以下这些参数运行以查询更多的信息:

ls / 显示/.下的所有文件和目录

ls -l 给出文件或者文件夹的详细信息

ls -a 显示所有文件,包括隐藏文

- nodejs同步操作mysql

qiaolevip

学习永无止境每天进步一点点mysqlnodejs

// db-util.js

var mysql = require('mysql');

var pool = mysql.createPool({

connectionLimit : 10,

host: 'localhost',

user: 'root',

password: '',

database: 'test',

port: 3306

});

- 一起学Hive系列文章

superlxw1234

hiveHive入门

[一起学Hive]系列文章 目录贴,入门Hive,持续更新中。

[一起学Hive]之一—Hive概述,Hive是什么

[一起学Hive]之二—Hive函数大全-完整版

[一起学Hive]之三—Hive中的数据库(Database)和表(Table)

[一起学Hive]之四-Hive的安装配置

[一起学Hive]之五-Hive的视图和分区

[一起学Hive

- Spring开发利器:Spring Tool Suite 3.7.0 发布

wiselyman

spring

Spring Tool Suite(简称STS)是基于Eclipse,专门针对Spring开发者提供大量的便捷功能的优秀开发工具。

在3.7.0版本主要做了如下的更新:

将eclipse版本更新至Eclipse Mars 4.5 GA

Spring Boot(JavaEE开发的颠覆者集大成者,推荐大家学习)的配置语言YAML编辑器的支持(包含自动提示,