- 为了在未来的人工智能世界中取得成功,学生们必须学习人类写作的优点

睿邸管家

澳大利亚各地的学生在新学年开始使用铅笔、钢笔和键盘学习写字。在工作场所,机器也在学习写作,如此有效,几年之内,它们可能会写得比人类更好。有时它们已经做到了,就像Grammarly这样的应用程序所展示的那样。当然,人类现在的日常写作可能很快就会由具有人工智能(AI)的机器来完成。手机和电子邮件软件常用的预测文本是无数人每天都在使用的一种人工智能写作形式。据AI行业研究机构称,到2022年,人工智能及

- Anaconda 和 Miniconda:功能详解与选择建议

古月฿

python入门pythonconda

Anaconda和Miniconda详细介绍一、Anaconda的详细介绍1.什么是Anaconda?Anaconda是一个开源的包管理和环境管理工具,在数据科学、机器学习以及科学计算领域发挥着关键作用。它以Python和R语言为基础,为用户精心准备了大量预装库和工具,极大地缩短了搭建数据科学环境的时间。对于那些想要快速开展数据分析、模型训练等工作的人员来说,Anaconda就像是一个一站式的“数

- 人工智能应用研究快讯 2021-11-30

峰谷皆平

[HTML]ArtificialIntelligenceforSkinCancerDetection:ScopingReviewATakiddin,JSchneider,YYang,AAbd-Alrazaq...JournalofMedicalInternet...,2021ABSTACT:Background:Skincanceristhemostcommoncancertypeaffectin

- 机器学习必备数学与编程指南:从入门到精通

a小胡哦

机器学习基础机器学习人工智能

一、机器学习核心数学基础1.线性代数(神经网络的基础)必须掌握:矩阵运算(乘法、转置、逆)向量空间与线性变换特征值分解与奇异值分解(SVD)为什么重要:神经网络本质就是矩阵运算学习技巧:用NumPy实际操作矩阵运算2.概率与统计(模型评估的关键)核心概念:条件概率与贝叶斯定理概率分布(正态、泊松、伯努利)假设检验与p值应用场景:朴素贝叶斯、A/B测试3.微积分(优化算法的基础)重点掌握:导数与偏导

- 从振动信号到精准预警:AI 如何重塑工业设备健康管理?

缘华工业智维

人工智能计算机视觉边缘计算信息与通信

在智能制造浪潮席卷全球的当下,工业生产正经历着从传统模式向智能化、数字化转型的深刻变革。在这场变革中,AI驱动的振动分析技术犹如一颗璀璨新星,成为工业设备可靠运行的“健康卫士”。它通过在设备关键部位部署振动传感器,如同医生为患者听诊般实时采集设备运行时的振动信号,再借助强大的人工智能算法对这些“工业脉搏”进行深度解析,从而实现对工业设备从故障预警到寿命预测的全周期精准守护。一、AI振动分析:设备状

- AI 生成虚拟宠物:24 小时陪你聊天解闷

大力出奇迹985

人工智能宠物

本文围绕AI生成虚拟宠物展开,介绍这类依托人工智能技术诞生的虚拟伙伴,能实现24小时不间断陪伴聊天,为人们解闷。文中详细阐述其技术基础,包括自然语言处理、机器学习等;分析多样功能,如个性化互动、情绪回应等;探讨在独居人群、压力大者等不同群体中的应用场景,最后总结其为人们生活带来的积极影响及未来发展潜力,展现AI虚拟宠物在陪伴领域的独特价值。一、AI生成虚拟宠物的诞生背景与技术基石在快节奏的现代社会

- 基于Python的AI健康助手:开发与部署全攻略

AI算力网络与通信

AI算力网络与通信原理AI人工智能大数据架构python人工智能开发语言ai

基于Python的AI健康助手:开发与部署全攻略关键词:Python、AI健康助手、机器学习、自然语言处理、Flask、部署、健康管理摘要:本文将详细介绍如何使用Python开发一个AI健康助手,从需求分析、技术选型到核心功能实现,再到最终部署上线的完整过程。我们将使用自然语言处理技术理解用户健康咨询,通过机器学习模型提供个性化建议,并展示如何用Flask框架构建Web应用接口。文章包含大量实际代

- GPT-4 在 AIGC 中的微调技巧:让模型更懂你的需求

AIGC应用创新大全

AI人工智能与大数据应用开发MCP&Agent云算力网络AIGCai

GPT-4在AIGC中的微调技巧:让模型更懂你的需求关键词:GPT-4、AIGC、模型微调、监督学习、指令优化、过拟合预防、个性化生成摘要:AIGC(人工智能生成内容)正在重塑内容创作行业,但通用的GPT-4模型可能无法精准匹配你的垂直需求——比如写电商爆款文案时总“跑题”,或生成技术文档时专业术语不够。本文将用“教小朋友学画画”的通俗类比,从微调的底层逻辑讲到实战技巧,带你掌握让GPT-4“更懂

- AIGC内容生成实战:如何用ChatGPT+DALL·E打造高转化内容

AI大模型应用工坊

AI大模型开发实战AIGCchatgptai

AIGC内容生成实战:如何用ChatGPT+DALL·E打造高转化内容关键词:AIGC、ChatGPT、DALL·E、内容生成、高转化营销、多模态协同、提示词工程摘要:随着AIGC(人工智能生成内容)技术的爆发式发展,ChatGPT(文本生成)与DALL·E(图像生成)的组合已成为内容创作领域的“黄金搭档”。本文将深度解析二者的协同原理,结合实战案例演示从需求分析到内容落地的全流程,并揭示提升内容

- 数据分析领域中AI人工智能的发展前景展望

AI大模型应用工坊

AI大模型开发实战数据分析人工智能数据挖掘ai

数据分析领域中AI人工智能的发展前景展望关键词:数据分析、人工智能、机器学习、深度学习、数据挖掘、预测分析、自动化摘要:本文深入探讨了人工智能在数据分析领域的发展现状和未来趋势。我们将从核心技术原理出发,分析AI如何改变传统数据分析范式,详细讲解机器学习算法在数据分析中的应用,并通过实际案例展示AI驱动的数据分析解决方案。文章还将探讨行业应用场景、工具生态以及未来发展面临的挑战和机遇,为数据分析师

- AI人工智能中的数据挖掘:提升智能决策能力

AI人工智能中的数据挖掘:提升智能决策能力关键词:数据挖掘、人工智能、机器学习、智能决策、数据分析、特征工程、模型优化摘要:本文深入探讨了数据挖掘在人工智能领域中的核心作用,重点分析了如何通过数据挖掘技术提升智能决策能力。文章从基础概念出发,详细介绍了数据挖掘的关键算法、数学模型和实际应用场景,并通过Python代码示例展示了数据挖掘的全流程。最后,文章展望了数据挖掘技术的未来发展趋势和面临的挑战

- 数据中台中的数据科学工作台:Jupyter集成方案

AI大数据智能洞察

大数据与AI人工智能jupyter信息可视化ideai

数据中台中的数据科学工作台:Jupyter集成方案关键词:数据中台、数据科学工作台、JupyterNotebook、数据科学、机器学习、数据可视化、协作开发摘要:本文深入探讨了在数据中台架构中集成JupyterNotebook作为数据科学工作台的完整解决方案。我们将从数据中台的基本概念出发,详细分析Jupyter在数据科学工作流中的核心作用,介绍多种集成方案和技术实现细节,并通过实际案例展示如何构

- 2018年中南大学中英翻译

某翁

参考:20180827235856533.jpg【1】机器学习理论表明,机器学习算法能从有限个训练集样本上得到较好的泛化【1】Machinelearningtheoryshowsthatmachinelearningalgorithmcangeneralizewellfromfinitetrainingsetsampleslimited有限的infinite无限的【2】这似乎违背了一些基本的逻辑准

- 【三桥君】MCP中台,究竟如何实现多模型、多渠道、多环境的统一管控?如何以MCP为核心设计AI应用架构?

三桥君

《三桥君MCP落地方法论》《三桥君AI大模型落地方法论》#《三桥君AI产品方法论》人工智能AI产品经理MCPAPI三桥君系统架构llama

你好,我是✨三桥君✨本文介绍>>一、引言随着人工智能技术的快速发展,越来越多的企业开始引入大语言模型(LLM)以提升用户体验和运营效率。然而,如何高效、稳定地将这些AI能力落地到生产环境呢?传统的系统架构往往难以应对AI应用的高并发、低延迟和灵活扩展需求,因此,从整体架构角度设计AI应用架构显得尤为重要。本文三桥君将深入探讨以MCP为核心的AI应用架构,并分析多种部署方式的优劣势,为企业在AI落地

- 深入理解卷积神经网络(CNN)与循环神经网络(RNN)

CodeJourney.

cnnrnn人工智能

在当今的人工智能领域,神经网络无疑是最为璀璨的明珠之一。而卷积神经网络(ConvolutionalNeuralNetworks,CNN)和循环神经网络(RecurrentNeuralNetworks,RNN)作为神经网络家族中的重要成员,各自有着独特的架构和强大的功能,广泛应用于众多领域。本文将深入探讨这两种神经网络的原理、特点以及应用场景,为对深度学习感兴趣的读者提供全面的知识讲解。一、卷积神经

- 今年校招竞争真激烈

12_05

程序员满大街,都要找不到工作了。即使人工智能满大街,我也后悔当初没学机器学习,后悔当初没学Java。C++真难找工作。难道毕了业就失业吗?好担心!

- 基于随机森林的白酒风味智能分类系统:从数据到洞察的完整实践

笙囧同学

python

作者:笙囧同学|中科院计算机大模型方向硕士|全栈开发爱好者座右铭:偷懒是人生进步的阶梯联系方式:

[email protected]各大平台账号/公众号:笙囧同学前言大家好,我是笙囧同学!今天给大家分享一个超级有趣且技术含量爆表的项目——白酒风味智能分类系统。作为一个既爱技术又爱美酒的程序员,我花了大量时间研究如何用机器学习的方法来"品酒",让AI帮我们识别白酒的风味特征。这个项目融合了机器学习、数

- 如何运用深度学习打造高效AI人工智能系统

AI智能探索者

AIAgent智能体开发实战人工智能深度学习ai

如何运用深度学习打造高效AI人工智能系统关键词:深度学习、AI系统、神经网络、模型优化、实战开发摘要:本文将从深度学习的核心概念出发,结合生活实例和代码实战,系统讲解如何构建高效AI系统。我们会拆解数据准备、模型设计、训练优化、部署落地的全流程,揭秘“数据-模型-训练-推理”的协同机制,并通过具体案例演示从0到1开发AI系统的关键技巧,帮助开发者掌握打造高效AI系统的底层逻辑。背景介绍目的和范围在

- 非欧空间计算加速:图神经网络与微分几何计算的GPU优化(流形数据的内存布局优化策略)

九章云极AladdinEdu

空间计算神经网络人工智能gpu算力算法java开发语言

一、非欧空间计算的革命性意义与核心挑战在三维形状分析、社交网络建模、分子动力学模拟等领域,非欧几里得空间数据(流形数据)的处理正推动人工智能技术向更复杂的几何结构迈进。传统欧式空间优化方法在处理流形数据时面临根本性局限:黎曼度量导致距离计算失效、局部坐标系动态变化引发内存访问模式混乱、曲率变化影响并行计算效率。本文提出基于分块流形存储(BlockedManifoldStorage,BMS)与层次化

- Spring AI与机器学习:智能应用开发新范式

tmjpz04412

人工智能spring机器学习

SpringAI与机器学习的整合SpringAI是一个基于Spring生态的AI开发框架,旨在简化智能应用的开发流程。通过SpringAI,开发者可以快速集成机器学习模型,构建高效的智能应用。SpringAI支持多种机器学习库和框架,如TensorFlow、PyTorch和Scikit-learn,提供统一的API接口。SpringAI的核心优势在于其模块化设计和自动化配置。开发者无需关心复杂的依

- 响应式编程实践:Spring Boot WebFlux构建高性能非阻塞服务

fanxbl957

Webspringboot后端java

博主介绍:Java、Python、js全栈开发“多面手”,精通多种编程语言和技术,痴迷于人工智能领域。秉持着对技术的热爱与执着,持续探索创新,愿在此分享交流和学习,与大家共进步。全栈开发环境搭建运行攻略:多语言一站式指南(环境搭建+运行+调试+发布+保姆级详解)感兴趣的可以先收藏起来,希望帮助更多的人响应式编程实践:SpringBootWebFlux构建高性能非阻塞服务一、引言在当今数字化时代,互

- 企业级RAG的数据方案选择 - 向量数据库、图数据库和知识图谱

南七小僧

AI技术产品经理网站开发人工智能数据库知识图谱人工智能

如何为企业RAG选择合适的数据存储方式摘要:本文讨论了矢量数据库、图数据库和知识图谱在解决信息检索挑战方面的重要性,特别是针对企业规模的检索增强生成(RAG)。看看海外人工智能企业Writer是如何利用知识图谱增强企业级RAG。要点概要:矢量数据库高效存储数据,但缺乏上下文和关联信息。图数据库优先考虑数据点之间的关系,受益于关系结构。知识图谱在语义存储方面表现出色,由于其能够编码丰富的上下文信息,

- 【人工智能入门必看的最全Python编程实战(1)】

DFCED

人工智能python开发语言深度学习找工作就业

--------------------------------------------------------------------------------------------------------------------1.AIGC未来发展前景未完持续…1.1人工智能相关科研重要性拥有一篇人工智能科研论文及专利软著竞赛是保研考研留学深造以及找工作的关键门票!!!拥有一篇人工智能科研论文

- 2025毫米波雷达技术白皮书:智能汽车与物联网的感知核心

随着人工智能、物联网(IoT)和智能汽车产业的迅猛发展,毫米波雷达技术正成为感知领域的核心驱动力。毫米波雷达凭借其高精度、全天候和强抗干扰能力,广泛应用于智能汽车的自动驾驶、物联网的环境感知以及工业自动化。2025年,毫米波雷达技术在性能、应用场景和市场规模上都达到了一个全新的高度。本白皮书将深入探讨毫米波雷达技术的核心优势、发展趋势及其在智能汽车与物联网中的应用前景,同时推荐各大品牌的领先产品方

- 从零开始构建深度学习环境:基于Pytorch、CUDA与cuDNN的虚拟环境搭建与实践(适合初学者)

荣华富贵8

程序员的知识储备2程序员的知识储备3深度学习pytorch人工智能

摘要:深度学习正在引领人工智能技术的革新,而对于初学者来说,正确搭建深度学习环境是迈向AI研究与应用的第一步。本文将为读者提供一套详尽的教程,指导如何在本地环境中搭建Pytorch、CUDA与cuDNN,以及如何利用Anaconda和PyCharm进行高效开发。内容涵盖从环境配置、常见错误修正,到基础的深度学习模型构建及训练。我们旨在为深度学习零基础的入门者提供一个全面且易于理解的“保姆级”教程,

- 人工智能概念之九:深度学习概述

文章目录相关文章一、深度学习的定位:AI时代的基石技术1.1技术生态全景图1.2技术革命的催化剂二、深度学习的双面性:性能优势与技术挑战2.1技术优势全景扫描2.2技术挑战深度剖析三、技术演进时间轴:70年的厚积薄发四、主流框架生态对比五、未来演进方向相关文章人工智能概念之二:人工智能核心概念:网页链接一、深度学习的定位:AI时代的基石技术1.1技术生态全景图深度学习处于人工智能(AI)技术金字塔

- H800核心技术突破与行业应用实战

智能计算研究中心

其他

内容概要在人工智能技术持续迭代的背景下,H800芯片凭借自主架构优化与算力跃升,成为推动行业场景化落地的关键驱动力。本文将从技术路径、性能突破与行业应用三个维度,系统解析H800如何在高并发计算与低延时响应领域实现底层架构创新。首先聚焦其自主架构优化的核心技术路径,包括动态资源调度算法与异构计算单元的深度协同设计,揭示其在能效比与计算密度上的突破逻辑;进一步结合算力跃升的具体表现,探讨该芯片如何通

- 智慧建筑:科技引领房地产与建筑业的未来

RedPhoenix45

最新接入DeepSeek-V3模型,点击下载最新版本InsCodeAIIDE智慧建筑:科技引领房地产与建筑业的未来随着科技的飞速发展,人工智能(AI)和智能化工具正以前所未有的速度改变着各行各业。在房地产与建筑领域,这种变革尤为显著。从建筑设计到施工管理,再到物业管理,智能化技术正在重塑行业的每一个环节。本文将探讨如何利用先进的智能化工具提升房地产与建筑行业的效率,并介绍一款革命性的开发工具——它

- 智慧施工:AI技术赋能建筑安全监测新纪元

开发AI智能应用,就下载InsCodeAIIDE,一键接入DeepSeek-R1满血版大模型!智慧施工:AI技术赋能建筑安全监测新纪元在现代建筑行业中,施工安全始终是核心关注点之一。随着科技的飞速发展,人工智能(AI)和大数据分析逐渐成为提升施工安全的重要工具。本文将探讨如何利用智能化软件和大模型API来构建高效的施工安全监测系统,并介绍一款强大的开发工具——InsCodeAIIDE的应用场景及其

- 智慧工地系统:建筑行业数字化变革的引领者

青云智慧园区

java

在建筑行业积极迈向数字化转型的浪潮中,智慧工地系统凭借“数据驱动、智能管控、协同增效”的核心优势,深度融合物联网、大数据、人工智能等前沿技术,构建起覆盖工程项目全生命周期的精细化管理体系。以下将从系统架构、核心功能模块、应用价值以及未来展望等方面,全方位剖析智慧工地系统如何实现施工全过程的智能化、高效化管理。一、系统架构:打造一体化协同管理平台智慧工地系统采用先进的分层架构设计,以底层的数据采集层

- 设计模式介绍

tntxia

设计模式

设计模式来源于土木工程师 克里斯托弗 亚历山大(http://en.wikipedia.org/wiki/Christopher_Alexander)的早期作品。他经常发表一些作品,内容是总结他在解决设计问题方面的经验,以及这些知识与城市和建筑模式之间有何关联。有一天,亚历山大突然发现,重复使用这些模式可以让某些设计构造取得我们期望的最佳效果。

亚历山大与萨拉-石川佳纯和穆雷 西乐弗斯坦合作

- android高级组件使用(一)

百合不是茶

androidRatingBarSpinner

1、自动完成文本框(AutoCompleteTextView)

AutoCompleteTextView从EditText派生出来,实际上也是一个文本编辑框,但它比普通编辑框多一个功能:当用户输入一个字符后,自动完成文本框会显示一个下拉菜单,供用户从中选择,当用户选择某个菜单项之后,AutoCompleteTextView按用户选择自动填写该文本框。

使用AutoCompleteTex

- [网络与通讯]路由器市场大有潜力可挖掘

comsci

网络

如果国内的电子厂商和计算机设备厂商觉得手机市场已经有点饱和了,那么可以考虑一下交换机和路由器市场的进入问题.....

这方面的技术和知识,目前处在一个开放型的状态,有利于各类小型电子企业进入

&nbs

- 自写简单Redis内存统计shell

商人shang

Linux shell统计Redis内存

#!/bin/bash

address="192.168.150.128:6666,192.168.150.128:6666"

hosts=(${address//,/ })

sfile="staticts.log"

for hostitem in ${hosts[@]}

do

ipport=(${hostitem

- 单例模式(饿汉 vs懒汉)

oloz

单例模式

package 单例模式;

/*

* 应用场景:保证在整个应用之中某个对象的实例只有一个

* 单例模式种的《 懒汉模式》

* */

public class Singleton {

//01 将构造方法私有化,外界就无法用new Singleton()的方式获得实例

private Singleton(){};

//02 申明类得唯一实例

priva

- springMvc json支持

杨白白

json springmvc

1.Spring mvc处理json需要使用jackson的类库,因此需要先引入jackson包

2在spring mvc中解析输入为json格式的数据:使用@RequestBody来设置输入

@RequestMapping("helloJson")

public @ResponseBody

JsonTest helloJson() {

- android播放,掃描添加本地音頻文件

小桔子

最近幾乎沒有什麽事情,繼續鼓搗我的小東西。想在項目中加入一個簡易的音樂播放器功能,就像華為p6桌面上那麼大小的音樂播放器。用過天天動聽或者QQ音樂播放器的人都知道,可已通過本地掃描添加歌曲。不知道他們是怎麼實現的,我覺得應該掃描設備上的所有文件,過濾出音頻文件,每個文件實例化為一個實體,記錄文件名、路徑、歌手、類型、大小等信息。具體算法思想,

- oracle常用命令

aichenglong

oracledba常用命令

1 创建临时表空间

create temporary tablespace user_temp

tempfile 'D:\oracle\oradata\Oracle9i\user_temp.dbf'

size 50m

autoextend on

next 50m maxsize 20480m

extent management local

- 25个Eclipse插件

AILIKES

eclipse插件

提高代码质量的插件1. FindBugsFindBugs可以帮你找到Java代码中的bug,它使用Lesser GNU Public License的自由软件许可。2. CheckstyleCheckstyle插件可以集成到Eclipse IDE中去,能确保Java代码遵循标准代码样式。3. ECLemmaECLemma是一款拥有Eclipse Public License许可的免费工具,它提供了

- Spring MVC拦截器+注解方式实现防止表单重复提交

baalwolf

spring mvc

原理:在新建页面中Session保存token随机码,当保存时验证,通过后删除,当再次点击保存时由于服务器端的Session中已经不存在了,所有无法验证通过。

1.新建注解:

? 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18

- 《Javascript高级程序设计(第3版)》闭包理解

bijian1013

JavaScript

“闭包是指有权访问另一个函数作用域中的变量的函数。”--《Javascript高级程序设计(第3版)》

看以下代码:

<script type="text/javascript">

function outer() {

var i = 10;

return f

- AngularJS Module类的方法

bijian1013

JavaScriptAngularJSModule

AngularJS中的Module类负责定义应用如何启动,它还可以通过声明的方式定义应用中的各个片段。我们来看看它是如何实现这些功能的。

一.Main方法在哪里

如果你是从Java或者Python编程语言转过来的,那么你可能很想知道AngularJS里面的main方法在哪里?这个把所

- [Maven学习笔记七]Maven插件和目标

bit1129

maven插件

插件(plugin)和目标(goal)

Maven,就其本质而言,是一个插件执行框架,Maven的每个目标的执行逻辑都是由插件来完成的,一个插件可以有1个或者几个目标,比如maven-compiler-plugin插件包含compile和testCompile,即maven-compiler-plugin提供了源代码编译和测试源代码编译的两个目标

使用插件和目标使得我们可以干预

- 【Hadoop八】Yarn的资源调度策略

bit1129

hadoop

1. Hadoop的三种调度策略

Hadoop提供了3中作业调用的策略,

FIFO Scheduler

Fair Scheduler

Capacity Scheduler

以上三种调度算法,在Hadoop MR1中就引入了,在Yarn中对它们进行了改进和完善.Fair和Capacity Scheduler用于多用户共享的资源调度

2. 多用户资源共享的调度

- Nginx使用Linux内存加速静态文件访问

ronin47

Nginx是一个非常出色的静态资源web服务器。如果你嫌它还不够快,可以把放在磁盘中的文件,映射到内存中,减少高并发下的磁盘IO。

先做几个假设。nginx.conf中所配置站点的路径是/home/wwwroot/res,站点所对应文件原始存储路径:/opt/web/res

shell脚本非常简单,思路就是拷贝资源文件到内存中,然后在把网站的静态文件链接指向到内存中即可。具体如下:

- 关于Unity3D中的Shader的知识

brotherlamp

unityunity资料unity教程unity视频unity自学

首先先解释下Unity3D的Shader,Unity里面的Shaders是使用一种叫ShaderLab的语言编写的,它同微软的FX文件或者NVIDIA的CgFX有些类似。传统意义上的vertex shader和pixel shader还是使用标准的Cg/HLSL 编程语言编写的。因此Unity文档里面的Shader,都是指用ShaderLab编写的代码,然后我们来看下Unity3D自带的60多个S

- CopyOnWriteArrayList vs ArrayList

bylijinnan

java

package com.ljn.base;

import java.util.ArrayList;

import java.util.Iterator;

import java.util.List;

import java.util.concurrent.CopyOnWriteArrayList;

/**

* 总述:

* 1.ArrayListi不是线程安全的,CopyO

- 内存中栈和堆的区别

chicony

内存

1、内存分配方面:

堆:一般由程序员分配释放, 若程序员不释放,程序结束时可能由OS回收 。注意它与数据结构中的堆是两回事,分配方式是类似于链表。可能用到的关键字如下:new、malloc、delete、free等等。

栈:由编译器(Compiler)自动分配释放,存放函数的参数值,局部变量的值等。其操作方式类似于数据结构中

- 回答一位网友对Scala的提问

chenchao051

scalamap

本来准备在私信里直接回复了,但是发现不太方便,就简要回答在这里。 问题 写道 对于scala的简洁十分佩服,但又觉得比较晦涩,例如一例,Map("a" -> List(11,111)).flatMap(_._2),可否说下最后那个函数做了什么,真正在开发的时候也会如此简洁?谢谢

先回答一点,在实际使用中,Scala毫无疑问就是这么简单。

- mysql 取每组前几条记录

daizj

mysql分组最大值最小值每组三条记录

一、对分组的记录取前N条记录:例如:取每组的前3条最大的记录 1.用子查询: SELECT * FROM tableName a WHERE 3> (SELECT COUNT(*) FROM tableName b WHERE b.id=a.id AND b.cnt>a. cnt) ORDER BY a.id,a.account DE

- HTTP深入浅出 http请求

dcj3sjt126com

http

HTTP(HyperText Transfer Protocol)是一套计算机通过网络进行通信的规则。计算机专家设计出HTTP,使HTTP客户(如Web浏览器)能够从HTTP服务器(Web服务器)请求信息和服务,HTTP目前协议的版本是1.1.HTTP是一种无状态的协议,无状态是指Web浏览器和Web服务器之间不需要建立持久的连接,这意味着当一个客户端向服务器端发出请求,然后We

- 判断MySQL记录是否存在方法比较

dcj3sjt126com

mysql

把数据写入到数据库的时,常常会碰到先要检测要插入的记录是否存在,然后决定是否要写入。

我这里总结了判断记录是否存在的常用方法:

sql语句: select count ( * ) from tablename;

然后读取count(*)的值判断记录是否存在。对于这种方法性能上有些浪费,我们只是想判断记录记录是否存在,没有必要全部都查出来。

- 对HTML XML的一点认识

e200702084

htmlxml

感谢http://www.w3school.com.cn提供的资料

HTML 文档中的每个成分都是一个节点。

节点

根据 DOM,HTML 文档中的每个成分都是一个节点。

DOM 是这样规定的:

整个文档是一个文档节点

每个 HTML 标签是一个元素节点

包含在 HTML 元素中的文本是文本节点

每一个 HTML 属性是一个属性节点

注释属于注释节点

Node 层次

- jquery分页插件

genaiwei

jqueryWeb前端分页插件

//jquery页码控件// 创建一个闭包 (function($) { // 插件的定义 $.fn.pageTool = function(options) { var totalPa

- Mybatis与Ibatis对照入门于学习

Josh_Persistence

mybatisibatis区别联系

一、为什么使用IBatis/Mybatis

对于从事 Java EE 的开发人员来说,iBatis 是一个再熟悉不过的持久层框架了,在 Hibernate、JPA 这样的一站式对象 / 关系映射(O/R Mapping)解决方案盛行之前,iBaits 基本是持久层框架的不二选择。即使在持久层框架层出不穷的今天,iBatis 凭借着易学易用、

- C中怎样合理决定使用那种整数类型?

秋风扫落叶

c数据类型

如果需要大数值(大于32767或小于32767), 使用long 型。 否则, 如果空间很重要 (如有大数组或很多结构), 使用 short 型。 除此之外, 就使用 int 型。 如果严格定义的溢出特征很重要而负值无关紧要, 或者你希望在操作二进制位和字节时避免符号扩展的问题, 请使用对应的无符号类型。 但是, 要注意在表达式中混用有符号和无符号值的情况。

&nbs

- maven问题

zhb8015

maven问题

问题1:

Eclipse 中 新建maven项目 无法添加src/main/java 问题

eclipse创建maevn web项目,在选择maven_archetype_web原型后,默认只有src/main/resources这个Source Floder。

按照maven目录结构,添加src/main/ja

- (二)androidpn-server tomcat版源码解析之--push消息处理

spjich

javaandrodipn推送

在 (一)androidpn-server tomcat版源码解析之--项目启动这篇中,已经描述了整个推送服务器的启动过程,并且把握到了消息的入口即XmppIoHandler这个类,今天我将继续往下分析下面的核心代码,主要分为3大块,链接创建,消息的发送,链接关闭。

先贴一段XmppIoHandler的部分代码

/**

* Invoked from an I/O proc

- 用js中的formData类型解决ajax提交表单时文件不能被serialize方法序列化的问题

中华好儿孙

JavaScriptAjaxWeb上传文件FormData

var formData = new FormData($("#inputFileForm")[0]);

$.ajax({

type:'post',

url:webRoot+"/electronicContractUrl/webapp/uploadfile",

data:formData,

async: false,

ca

- mybatis常用jdbcType数据类型

ysj5125094

mybatismapperjdbcType

MyBatis 通过包含的jdbcType

类型

BIT FLOAT CHAR

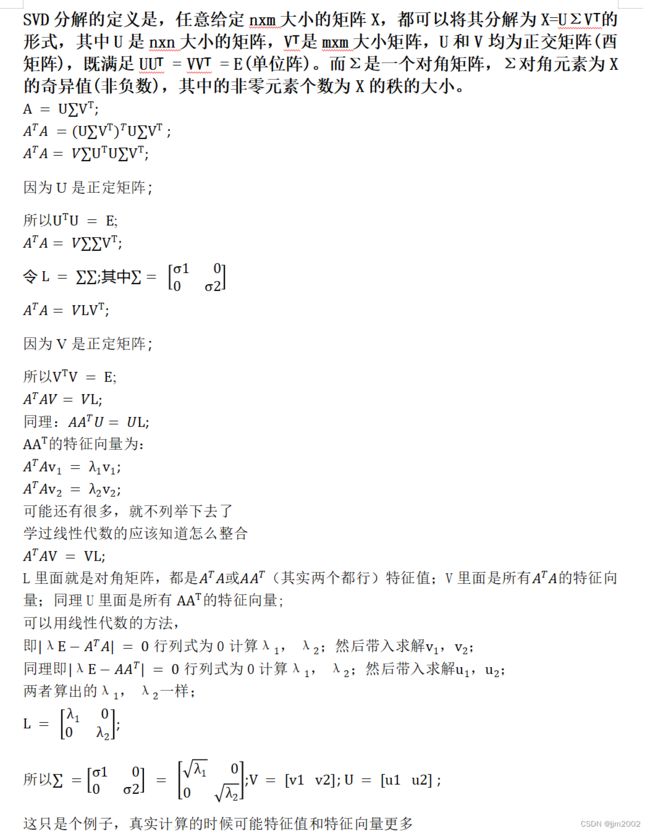

) 中对角矩阵 (

) 中对角矩阵 (  ) 的对角线元素的非负实数平方根。换句话说,如果 ( A ) 是一个大小为 (

) 的对角线元素的非负实数平方根。换句话说,如果 ( A ) 是一个大小为 (  ) 的矩阵,那么它有 (

) 的矩阵,那么它有 (  ) 个奇异值。

) 个奇异值。 ) 中的奇异值则描述了在这些方向上的缩放程度。较大的奇异值表示了更大的缩放,而较小的奇异值表示了更小的缩放。

) 中的奇异值则描述了在这些方向上的缩放程度。较大的奇异值表示了更大的缩放,而较小的奇异值表示了更小的缩放。![]() 、V

、V![]()

![]() ) 的矩阵,( U ) 是一个大小为 (

) 的矩阵,( U ) 是一个大小为 (![]() ) 的正交矩阵,(

) 的正交矩阵,( ![]() ) 是一个大小为 (

) 是一个大小为 ( ![]() ) 的对角矩阵,( V ) 是一个大小为 (

) 的对角矩阵,( V ) 是一个大小为 ( ![]() ) 的正交矩阵。这里,( U ) 的列向量称为左奇异向量,(

) 的正交矩阵。这里,( U ) 的列向量称为左奇异向量,( ![]() ) 的对角线元素称为奇异值,( V ) 的列向量称为右奇异向量。SVD的求解可以通过多种方法,其中一种常用的方法是使用特征值分解。给定一个矩阵 ( A ),我们可以计算 ( A^T A ) 和 ( A A^T ) 的特征值和特征向量。假设 ( A ) 是大小为 ( m \times n ) 的矩阵,那么 ( A^T A ) 和 ( A A^T ) 的特征值都是非负实数。然后,我们可以从这些特征值中构建 (

) 的对角线元素称为奇异值,( V ) 的列向量称为右奇异向量。SVD的求解可以通过多种方法,其中一种常用的方法是使用特征值分解。给定一个矩阵 ( A ),我们可以计算 ( A^T A ) 和 ( A A^T ) 的特征值和特征向量。假设 ( A ) 是大小为 ( m \times n ) 的矩阵,那么 ( A^T A ) 和 ( A A^T ) 的特征值都是非负实数。然后,我们可以从这些特征值中构建 ( ![]() ),并且根据 ( A^T A ) 和 ( A A^T ) 的特征向量构建 ( U ) 和 ( V )。

),并且根据 ( A^T A ) 和 ( A A^T ) 的特征向量构建 ( U ) 和 ( V )。