- 数据分析:低代码平台助力大数据时代的飞跃发展

快乐非自愿

数据分析低代码大数据

随着信息技术的突飞猛进,我们身处于一个数据量空前增长的时代——大数据时代。在这个时代背景下,数据分析已经成为企业决策、政策制定、科学研究等众多领域不可或缺的重要工具。然而,面对海量的数据和日益复杂多变的分析需求,传统的数据分析方法往往捉襟见肘,难以应对。幸运的是,低代码平台的兴起为大数据分析注入了新的活力,成为推动大数据时代发展的重要力量。低代码平台,顾名思义,是一种通过少量甚至无需编写代码,就能

- Apache Kafka的伸缩性探究:实现高性能、弹性扩展的关键

i289292951

kafkakafka

引言ApacheKafka作为当今最流行的消息中间件之一,以其强大的伸缩性著称。在大数据处理、流处理和实时数据集成等领域,Kafka的伸缩性为其在面临急剧增长的数据流量和多样化业务需求时提供了无与伦比的扩展能力。本文将深入探讨Kafka如何通过其独特的架构设计实现高水平的伸缩性,以及在实际部署中如何优化和利用这一特性。一、Kafka伸缩性的核心设计分区(Partitioning)与水平扩展Kafk

- Azkaban各种类型的Job编写

__元昊__

一、概述原生的Azkaban支持的plugin类型有以下这些:command:Linuxshell命令行任务gobblin:通用数据采集工具hadoopJava:运行hadoopMR任务java:原生java任务hive:支持执行hiveSQLpig:pig脚本任务spark:spark任务hdfsToTeradata:把数据从hdfs导入TeradatateradataToHdfs:把数据从Te

- 山东省大数据局副局长禹金涛一行莅临聚合数据走访调研

聚合数据

API大数据人工智能API

3月19日,山东省大数据局党组成员、副局长禹金涛莅临聚合数据展开考察调研。山东省大数据局数据应用管理与安全处处长杨峰,副处长都海明参加调研,苏州市大数据局副局长汤晶陪同。聚合数据董事长左磊等人接待来访。调研组一行参观了聚合数据展厅,了解了聚合数据的发展历程、数据产品、应用案例、奖项荣誉等情况。并就企业在数据处理和应用方面取得的成绩进行了深入交流。作为最早一批进入大数据行业的企业,聚合数据深耕行业十

- 智慧公厕的先进技术应用

中期科技ZONTREE

智慧厕所智慧公厕智慧城市

公共厕所一直以来都是城市管理中一个重要的工作,但设施老化、环境脏乱、服务质量低下等问题一直困扰着城市居民。然而,随着科技的进步和数字技术的应用,智慧公厕的建设正在改变这一现状。智慧公厕通过对所在辖区内所有公共厕所的全域感知、全网协同、全业务融合和全场景智慧的赋能,“千厕一云”的公共厕所云管理模式应运而生。智慧公厕的云端多屏管理,将各个公厕连接在一起,实现信息的共享和管理的集中化。通过大数据、云计算

- 关于HDP的20道高级运维面试题

编织幻境的妖

运维

1.描述HDP的主要组件及其作用。HDP(HortonworksDataPlatform)的主要组件包括Hadoop框架、HDFS、MapReduce、YARN以及Hadoop生态系统中的其他关键工具,如Spark、Flink、Hive、HBase等。以下是对这些组件及其作用的具体描述:Hadoop框架:Hadoop是一个开源的分布式计算框架,用Java语言编写,用于存储和处理大规模数据集。它广义

- 【Hadoop】使用Scala与Spark连接ClickHouse进行数据处理

音乐学家方大刚

ScalaHadoophadoopscalaspark

风不懂不懂得叶的梦月不听不听闻窗里琴声意难穷水不见不曾见绿消红霜不知不知晓将别人怎道珍重落叶有风才敢做一个会飞的梦孤窗有月才敢登高在夜里从容桃花有水才怕身是客身是客此景不能久TieYann(铁阳)、薄彩生《不知晓》在大数据分析和处理领域,ApacheSpark是一个广泛使用的高性能、通用的计算框架,而ClickHouse作为一个高性能的列式数据库,特别适合在线分析处理(OLAP)。结合Scala语

- 一文详解大数据时代与低代码开发应用

快乐非自愿

大数据低代码

随着信息技术的飞速发展,我们迎来了一个崭新的时代——大数据时代。在这个时代,数据成为了一种新的资源,大数据技术的应用成为了推动社会进步的关键力量。而在大数据技术的浪潮中,低代码开发应用也逐渐崭露头角,以其高效、灵活的特点,成为大数据时代的重要支撑。大数据时代的来临随着科技的飞速发展和互联网的广泛普及,我们迎来了一个被称为“大数据时代”的全新时代。这个时代,数据无处不在,无时不刻不在增长,其规模之大

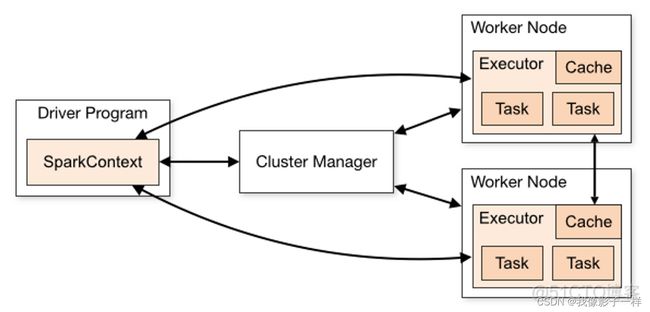

- Spark面试整理-Spark是什么?

不务正业的猿

面试Sparkspark大数据分布式

ApacheSpark是一个开源的分布式计算系统,它提供了一个用于大规模数据处理的快速、通用、易于使用的平台。它最初是在加州大学伯克利分校的AMPLab开发的,并于2010年开源。自那时起,Spark已经成为大数据处理中最受欢迎和广泛使用的框架之一。下面是Spark的一些关键特点:速度:Spark使用了先进的DAG(有向无环图)执行引擎,可以支持循环数据流和内存计算。这使得Spark在数据处理方面

- 请介绍一下大数据主要是干什么的?决策支持预测分析用户行为分析个性化服务操作优化风险管理创新与产品开发加拿大卡尔加里大学历史背景学术结构研究和创新校园设施

盛溪的猫猫

感悟大数据英语加拿大

目录请介绍一下大数据主要是干什么的?决策支持预测分析用户行为分析个性化服务操作优化风险管理创新与产品开发加拿大卡尔加里大学历史背景学术结构研究和创新校园设施国际化学生生活大语言模型目前的问题卡尔加里经济地理和气候文化和活动教育交通绿色城市AVL树的旋转单右旋(LL旋转)单左旋(RR旋转)左右旋(LR旋转)右左旋(RL旋转)请介绍一下大数据主要是干什么的?大数据是一个涉及从极其庞大和复杂的数据集中提

- GEE在灾害预警中的遥感云大数据应用及GPT模型辅助分析

AIzmjl

GPT生态遥感大数据gptgee灾害预警水体湿地遥感

随着遥感技术的快速发展,云大数据在灾害、水体与湿地领域的应用日益广泛。通过遥感云大数据,我们能够实时获取灾害发生地的影像信息,为灾害预警、应急响应提供有力支持。同时,在水体与湿地监测方面,遥感云大数据也发挥着重要作用,帮助我们了解水体的分布、变化以及湿地的生态状况。近年来,GPT模型在自然语言处理领域取得了显著成果,其强大的文本生成和理解能力为遥感云大数据的应用提供了新的可能。通过将GPT模型与遥

- 大数据毕设 图像识别-人脸识别与疲劳检测 - python opencv

fawubio_A

python算法

文章目录0前言1课题背景2Dlib人脸识别2.1简介2.2Dlib优点2.3相关代码2.4人脸数据库2.5人脸录入加识别效果3疲劳检测算法3.1眼睛检测算法3.2打哈欠检测算法3.3点头检测算法4PyQt54.1简介4.2相关界面代码0前言这两年开始毕业设计和毕业答辩的要求和难度不断提升,传统的毕设题目缺少创新和亮点,往往达不到毕业答辩的要求,这两年不断有学弟学妹告诉学长自己做的项目系统达不到老师

- 大数据开发(Hive面试真题-卷二)

Key-Key

大数据hive面试

大数据开发(Hive面试真题)1、举几个Hive开窗函数例子?什么要有开窗函数,和聚集函数区别?2、说下Hive是什么?跟数据仓库区别?3、Hive架构?4、Hive数据倾斜以及解决方案?5、Hive如果不用参数调优,在map和reduce端应该做什么?6、Hive的三种自定义函数是什么?实现步骤与流程?它们之间的区别?作用是什么?7、Hive分区和分桶的区别?8、Hive的执行流程?9、Hive

- 【大数据面试题】014 Flink CDC 用过吗,请简要描述

Jiweilai1

一天一道面试题flink大数据面试flinkcdc

一步一个脚印,一天一道面试题。FlinkCDC的诞生背景FlinkCDC的全称是ChangeDataCapture(变更数据捕获)每一项技术的诞生都是为了解决某个问题,某个痛点。而FlinkCDC的诞生就是为了解决在读取,监控MySQL这样的数据库时,不会因为读取数据库,对数据库本身造成压力,影响性能。同时,保证了数据源的准确,正确。FlinkCDC原理方式一:通过查询来获取更新的数据。如查询数据

- 【大数据】Flink SQL 语法篇(五):Regular Join、Interval Join

G皮T

#FlinkSQL大数据flinksqlRegularJoinIntervalJoin双流Join

《FlinkSQL语法篇》系列,共包含以下10篇文章:FlinkSQL语法篇(一):CREATEFlinkSQL语法篇(二):WITH、SELECT&WHERE、SELECTDISTINCTFlinkSQL语法篇(三):窗口聚合(TUMBLE、HOP、SESSION、CUMULATE)FlinkSQL语法篇(四):Group聚合、Over聚合FlinkSQL语法篇(五):RegularJoin、I

- 有一点动心

段duan

《有一点动心》是6月4日新上映的一部影片,在香山国际影城的支持下,与水姐观影群的伙伴们共同观看了这部影片。随着社会意识形态的不断变化,人们对感情的态度,也呈现出多元化的状态。爱情,自从人类诞生之日起,不论朝代如何更替变迁,都是生命的一大核心主题,演绎出无数个动人的故事,让经历者体验其中,让倾听者无比动容。从调查出来的大数据来看,适龄人群的不婚比例,是空前高的一个数字,越来越多的适婚人士,加入了不婚

- Spark Q&A

耐心的农夫2020

Q:在读取文件的时候,如何忽略空gzip文件?A:从Spark2.1开始,你可以通过启用spark.sql.files.ignoreCorruptFiles选项来忽略损毁的文件。可以将下面的选项添加到你的spark-submit或者pyspark命令中。--confspark.sql.files.ignoreCorruptFiles=true另外spark支持的选项可以通过在spark-shell

- 大数据开发(Kafka面试真题-卷一)

Key-Key

大数据kafka面试

大数据开发(Kafka面试真题)1、请解释以下ApacheKafka是什么?它在大数据系统中的角色是什么?2、请解释以下Kafka的工作原理和它与传统消息队列服务的不同之处?3、解释以下ApacheKafka的作用以及它与常见消息队列系统(如RabbitMQ)之间的区别?4、如何使用ApacheKafka来实现实时数据流处理?5、Flinkcheckpoint和Kafkaoffset的关联是什么?

- 什么是分布式搜索引擎

罗彬桦

分布式搜索引擎搜索引擎分布式

什么是分布式搜索引擎搜索引擎所谓搜索引擎,就是根据用户需求与一定算法,运用特定策略从互联网检索出制定信息反馈给用户的一门检索技术。搜索引擎依托于多种技术,如网络爬虫技术、检索排序技术、网页处理技术、大数据处理技术、自然语言处理技术等,为信息检索用户提供快速、高相关性的信息服务。搜索引擎技术的核心模块一般包括爬虫、索引、检索和排序等,同时可添加其他一系列辅助模块,以为用户创造更好的网络使用环境。分布

- 挑战杯 大数据商城人流数据分析与可视化 - python 大数据分析

laafeer

python

0前言优质竞赛项目系列,今天要分享的是基于大数据的基站数据分析与可视化该项目较为新颖,适合作为竞赛课题方向,学长非常推荐!学长这里给一个题目综合评分(每项满分5分)难度系数:3分工作量:3分创新点:3分更多资料,项目分享:https://gitee.com/dancheng-senior/postgraduate课题背景随着当今个人手机终端的普及,出行群体中手机拥有率和使用率已达到相当高的比例,手

- Java开发从入门到精通(七):Java的面向对象编程OOP:常用API

HACKNOE

Java开发从入门到精通javaintellij-idea

Java大数据开发和安全开发(一)Java的常用API1.1Object类1.1toString1.1equals方法1.1对象克隆clone1.1Objects类1.1包装类1.1StringBuilder1.1StringBuffer1.1StringJoiner1.1Math、System、Runtime1.1BigDecimal1.1传统时间:Date日期类、SimpleDateForma

- linux安装单机版spark3.5.0

爱上雪茄

大数据JAVA知识spark大数据分布式

一、spark介绍是一种通用的大数据计算框架,正如传统大数据技术Hadoop的MapReduce、Hive引擎,以及Storm流式实时计算引擎等.Spark主要用于大数据的计算二、spark下载spark3.5.0三、spark环境变量配置exportJAVA_HOME=/usr/local/jdk1.8.0_391exportJRE_HOME=/usr/local/jdk1.8.0_391/jr

- Hadoop简介

程序员小郭同学

hadoop

简介大数据简介概述大数据的说法从出现到现在,也经历了十多年时间的发展。而在这十几年的发展过程中,非常多的机构、组织都试图对大数据做出过定义,例如:研究机构Gartner给出了这样的定义:"大数据"是需要新处理模式才能具有更强的决策力、洞察发现力和流程优化能力的海量、高增长率和多样化的信息资产。再例如根据维基百科的定义,大数据是指无法在可承受的时间范围内用常规软件工具进行捕捉、管理和处理的数据集合。

- 数大数据时代的关键:融合数据治理与AI为企业增值_光点科技

光点数据治理

人工智能大数据科技

在数据驱动的今天,企业不能再将数据治理和人工智能(AI)视作孤立的实体。它们之间的协同作用已经成为推动企业增长的强大引擎。本文将探索数据治理与AI如何相互作用,形成闭环,以及企业如何利用这一关系来提升数据价值,实现数字化转型。数据治理与AI的依存共生数据治理是整理和优化数据的过程,以确保其质量、安全性和可用性。而AI,尤其是大模型,是解析和应用这些数据的工具。没有高质量的数据治理,AI无法发挥其最

- 2024年阿里云大数据acp认证条件

腾科教育

阿里云大数据云计算

阿里云大数据acp认证考试没有条件,在校大学生、应届毕业生、在职员工均可报考。acp认证考试预约流程1.账户注册,认证人员登录阿里云认证全球培训中心网站,在页面右上角点击“立即注册”2.选择专业。账户注册成功会自动返回到网站首页,认证人员根据实际需要进行报考,3,认证购买。进入专业介绍页后点击“购买认证"跳转到认证购买页,点击对应专业认证名称再点击“立即购买”,确认订单后完成支付即可。4.考试预约

- Redis 的 RDB 和 AOF

龙大.

Redisredis数据库

1.RDB(RedisDatabase)定义:RDB是Redis的持久化机制之一,它会在指定的时间间隔内生成数据集的时间点快照。工作原理:当RDB持久化被触发时,Redis会创建一个子进程来执行实际的数据保存工作,父进程则继续处理客户端请求。子进程将内存中的数据写入到一个临时RDB文件中,完成后替换旧的RDB文件。优点:快速恢复大数据集。子进程创建的方式减少了主进程的内存消耗。RDB文件是一个紧凑

- 挑战杯 机器学习股票大数据量化分析与预测系统 - python 挑战杯

laafeer

python

文章目录0前言1课题背景2实现效果UI界面设计web预测界面RSRS选股界面3软件架构4工具介绍Flask框架MySQL数据库LSTM5最后0前言优质竞赛项目系列,今天要分享的是机器学习股票大数据量化分析与预测系统该项目较为新颖,适合作为竞赛课题方向,学长非常推荐!学长这里给一个题目综合评分(每项满分5分)难度系数:3分工作量:3分创新点:3分更多资料,项目分享:https://gitee.com

- 03hive数仓安装与基础使用

daydayup9527

hadoop_hive运维hadoop

hiveHive概述Hive是基于Hadoop的一个数据仓库工具。可以将结构化的数据文件映射为一张表,并提供完整的sql查询功能,本质上还是一个文件底层是将sql语句转换为MapReduce任务进行运行本质上是一种大数据离线分析工具学习成本相当低,不用开发复杂的mapreduce应用,十分适合数据仓库的统计分析hive可以用来进行数据提取、转化、加载,这是一种可以存储、查询和分析存储在hadoop

- Spark的数据结构——RDD

bluedraam_pp

Sparkspark数据结构大数据

RDD的5个特征下面来说一下RDD这东西,它是ResilientDistributedDatasets的简写。咱们来看看RDD在源码的解释。Alistofpartitions:在大数据领域,大数据都是分割成若干个部分,放到多个服务器上,这样就能做到多线程的处理数据,这对处理大数据量是非常重要的。分区意味着,可以使用多个线程了处理。Afunctionforcomputingeachsplit:作用在

- Hbase集群搭建超详细教程

笑看风云路

集群搭建系列hbasehbasehadoop大数据

Hbase集群搭建前言详细步骤1、下载安装包2、解压3、修改配置文件3.1修改hbase-env.sh文件3.2修改hbase-site.xml3.3修改regionservers文件4、分发hbase目录5、启动HBase集群6、查看HBaseWebUI大家好,我是风云,欢迎大家关注我的博客,在未来的日子里我们一起来学习大数据相关的技术,一起努力奋斗,遇见更好的自己!前言HBase是一个开源的、

- 辗转相处求最大公约数

沐刃青蛟

C++漏洞

无言面对”江东父老“了,接触编程一年了,今天发现还不会辗转相除法求最大公约数。惭愧惭愧!

为此,总结一下以方便日后忘了好查找。

1.输入要比较的两个数a,b

忽略:2.比较大小(因为后面要的是大的数对小的数做%操作)

3.辗转相除(用循环不停的取余,如a%b,直至b=0)

4.最后的a为两数的最大公约数

&

- F5负载均衡会话保持技术及原理技术白皮书

bijian1013

F5负载均衡

一.什么是会话保持? 在大多数电子商务的应用系统或者需要进行用户身份认证的在线系统中,一个客户与服务器经常经过好几次的交互过程才能完成一笔交易或者是一个请求的完成。由于这几次交互过程是密切相关的,服务器在进行这些交互过程的某一个交互步骤时,往往需要了解上一次交互过程的处理结果,或者上几步的交互过程结果,服务器进行下

- Object.equals方法:重载还是覆盖

Cwind

javagenericsoverrideoverload

本文译自StackOverflow上对此问题的讨论。

原问题链接

在阅读Joshua Bloch的《Effective Java(第二版)》第8条“覆盖equals时请遵守通用约定”时对如下论述有疑问:

“不要将equals声明中的Object对象替换为其他的类型。程序员编写出下面这样的equals方法并不鲜见,这会使程序员花上数个小时都搞不清它为什么不能正常工作:”

pu

- 初始线程

15700786134

暑假学习的第一课是讲线程,任务是是界面上的一条线运动起来。

既然是在界面上,那必定得先有一个界面,所以第一步就是,自己的类继承JAVA中的JFrame,在新建的类中写一个界面,代码如下:

public class ShapeFr

- Linux的tcpdump

被触发

tcpdump

用简单的话来定义tcpdump,就是:dump the traffic on a network,根据使用者的定义对网络上的数据包进行截获的包分析工具。 tcpdump可以将网络中传送的数据包的“头”完全截获下来提供分析。它支 持针对网络层、协议、主机、网络或端口的过滤,并提供and、or、not等逻辑语句来帮助你去掉无用的信息。

实用命令实例

默认启动

tcpdump

普通情况下,直

- 安卓程序listview优化后还是卡顿

肆无忌惮_

ListView

最近用eclipse开发一个安卓app,listview使用baseadapter,里面有一个ImageView和两个TextView。使用了Holder内部类进行优化了还是很卡顿。后来发现是图片资源的问题。把一张分辨率高的图片放在了drawable-mdpi文件夹下,当我在每个item中显示,他都要进行缩放,导致很卡顿。解决办法是把这个高分辨率图片放到drawable-xxhdpi下。

&nb

- 扩展easyUI tab控件,添加加载遮罩效果

知了ing

jquery

(function () {

$.extend($.fn.tabs.methods, {

//显示遮罩

loading: function (jq, msg) {

return jq.each(function () {

var panel = $(this).tabs(&

- gradle上传jar到nexus

矮蛋蛋

gradle

原文地址:

https://docs.gradle.org/current/userguide/maven_plugin.html

configurations {

deployerJars

}

dependencies {

deployerJars "org.apache.maven.wagon

- 千万条数据外网导入数据库的解决方案。

alleni123

sqlmysql

从某网上爬了数千万的数据,存在文本中。

然后要导入mysql数据库。

悲剧的是数据库和我存数据的服务器不在一个内网里面。。

ping了一下, 19ms的延迟。

于是下面的代码是没用的。

ps = con.prepareStatement(sql);

ps.setString(1, info.getYear())............;

ps.exec

- JAVA IO InputStreamReader和OutputStreamReader

百合不是茶

JAVA.io操作 字符流

这是第三篇关于java.io的文章了,从开始对io的不了解-->熟悉--->模糊,是这几天来对文件操作中最大的感受,本来自己认为的熟悉了的,刚刚在回想起前面学的好像又不是很清晰了,模糊对我现在或许是最好的鼓励 我会更加的去学 加油!:

JAVA的API提供了另外一种数据保存途径,使用字符流来保存的,字符流只能保存字符形式的流

字节流和字符的难点:a,怎么将读到的数据

- MO、MT解读

bijian1013

GSM

MO= Mobile originate,上行,即用户上发给SP的信息。MT= Mobile Terminate,下行,即SP端下发给用户的信息;

上行:mo提交短信到短信中心下行:mt短信中心向特定的用户转发短信,你的短信是这样的,你所提交的短信,投递的地址是短信中心。短信中心收到你的短信后,存储转发,转发的时候就会根据你填写的接收方号码寻找路由,下发。在彩信领域是一样的道理。下行业务:由SP

- 五个JavaScript基础问题

bijian1013

JavaScriptcallapplythisHoisting

下面是五个关于前端相关的基础问题,但却很能体现JavaScript的基本功底。

问题1:Scope作用范围

考虑下面的代码:

(function() {

var a = b = 5;

})();

console.log(b);

什么会被打印在控制台上?

回答:

上面的代码会打印 5。

&nbs

- 【Thrift二】Thrift Hello World

bit1129

Hello world

本篇,不考虑细节问题和为什么,先照葫芦画瓢写一个Thrift版本的Hello World,了解Thrift RPC服务开发的基本流程

1. 在Intellij中创建一个Maven模块,加入对Thrift的依赖,同时还要加上slf4j依赖,如果不加slf4j依赖,在后面启动Thrift Server时会报错

<dependency>

- 【Avro一】Avro入门

bit1129

入门

本文的目的主要是总结下基于Avro Schema代码生成,然后进行序列化和反序列化开发的基本流程。需要指出的是,Avro并不要求一定得根据Schema文件生成代码,这对于动态类型语言很有用。

1. 添加Maven依赖

<?xml version="1.0" encoding="UTF-8"?>

<proj

- 安装nginx+ngx_lua支持WAF防护功能

ronin47

需要的软件:LuaJIT-2.0.0.tar.gz nginx-1.4.4.tar.gz &nb

- java-5.查找最小的K个元素-使用最大堆

bylijinnan

java

import java.util.Arrays;

import java.util.Random;

public class MinKElement {

/**

* 5.最小的K个元素

* I would like to use MaxHeap.

* using QuickSort is also OK

*/

public static void

- TCP的TIME-WAIT

bylijinnan

socket

原文连接:

http://vincent.bernat.im/en/blog/2014-tcp-time-wait-state-linux.html

以下为对原文的阅读笔记

说明:

主动关闭的一方称为local end,被动关闭的一方称为remote end

本地IP、本地端口、远端IP、远端端口这一“四元组”称为quadruplet,也称为socket

1、TIME_WA

- jquery ajax 序列化表单

coder_xpf

Jquery ajax 序列化

checkbox 如果不设定值,默认选中值为on;设定值之后,选中则为设定的值

<input type="checkbox" name="favor" id="favor" checked="checked"/>

$("#favor&quo

- Apache集群乱码和最高并发控制

cuisuqiang

apachetomcat并发集群乱码

都知道如果使用Http访问,那么在Connector中增加URIEncoding即可,其实使用AJP时也一样,增加useBodyEncodingForURI和URIEncoding即可。

最大连接数也是一样的,增加maxThreads属性即可,如下,配置如下:

<Connector maxThreads="300" port="8019" prot

- websocket

dalan_123

websocket

一、低延迟的客户端-服务器 和 服务器-客户端的连接

很多时候所谓的http的请求、响应的模式,都是客户端加载一个网页,直到用户在进行下一次点击的时候,什么都不会发生。并且所有的http的通信都是客户端控制的,这时候就需要用户的互动或定期轮训的,以便从服务器端加载新的数据。

通常采用的技术比如推送和comet(使用http长连接、无需安装浏览器安装插件的两种方式:基于ajax的长

- 菜鸟分析网络执法官

dcj3sjt126com

网络

最近在论坛上看到很多贴子在讨论网络执法官的问题。菜鸟我正好知道这回事情.人道"人之患好为人师" 手里忍不住,就写点东西吧. 我也很忙.又没有MM,又没有MONEY....晕倒有点跑题.

OK,闲话少说,切如正题. 要了解网络执法官的原理. 就要先了解局域网的通信的原理.

前面我们看到了.在以太网上传输的都是具有以太网头的数据包.

- Android相对布局属性全集

dcj3sjt126com

android

RelativeLayout布局android:layout_marginTop="25dip" //顶部距离android:gravity="left" //空间布局位置android:layout_marginLeft="15dip //距离左边距

// 相对于给定ID控件android:layout_above 将该控件的底部置于给定ID的

- Tomcat内存设置详解

eksliang

jvmtomcattomcat内存设置

Java内存溢出详解

一、常见的Java内存溢出有以下三种:

1. java.lang.OutOfMemoryError: Java heap space ----JVM Heap(堆)溢出JVM在启动的时候会自动设置JVM Heap的值,其初始空间(即-Xms)是物理内存的1/64,最大空间(-Xmx)不可超过物理内存。

可以利用JVM提

- Java6 JVM参数选项

greatwqs

javaHotSpotjvmjvm参数JVM Options

Java 6 JVM参数选项大全(中文版)

作者:Ken Wu

Email:

[email protected]

转载本文档请注明原文链接 http://kenwublog.com/docs/java6-jvm-options-chinese-edition.htm!

本文是基于最新的SUN官方文档Java SE 6 Hotspot VM Opt

- weblogic创建JMC

i5land

weblogicjms

进入 weblogic控制太

1.创建持久化存储

--Services--Persistant Stores--new--Create FileStores--name随便起--target默认--Directory写入在本机建立的文件夹的路径--ok

2.创建JMS服务器

--Services--Messaging--JMS Servers--new--name随便起--Pers

- 基于 DHT 网络的磁力链接和BT种子的搜索引擎架构

justjavac

DHT

上周开发了一个磁力链接和 BT 种子的搜索引擎 {Magnet & Torrent},本文简单介绍一下主要的系统功能和用到的技术。

系统包括几个独立的部分:

使用 Python 的 Scrapy 框架开发的网络爬虫,用来爬取磁力链接和种子;

使用 PHP CI 框架开发的简易网站;

搜索引擎目前直接使用的 MySQL,将来可以考虑使

- sql添加、删除表中的列

macroli

sql

添加没有默认值:alter table Test add BazaarType char(1)

有默认值的添加列:alter table Test add BazaarType char(1) default(0)

删除没有默认值的列:alter table Test drop COLUMN BazaarType

删除有默认值的列:先删除约束(默认值)alter table Test DRO

- PHP中二维数组的排序方法

abc123456789cba

排序二维数组PHP

<?php/*** @package BugFree* @version $Id: FunctionsMain.inc.php,v 1.32 2005/09/24 11:38:37 wwccss Exp $*** Sort an two-dimension array by some level

- hive优化之------控制hive任务中的map数和reduce数

superlxw1234

hivehive优化

一、 控制hive任务中的map数: 1. 通常情况下,作业会通过input的目录产生一个或者多个map任务。 主要的决定因素有: input的文件总个数,input的文件大小,集群设置的文件块大小(目前为128M, 可在hive中通过set dfs.block.size;命令查看到,该参数不能自定义修改);2.

- Spring Boot 1.2.4 发布

wiselyman

spring boot

Spring Boot 1.2.4已于6.4日发布,repo.spring.io and Maven Central可以下载(推荐使用maven或者gradle构建下载)。

这是一个维护版本,包含了一些修复small number of fixes,建议所有的用户升级。

Spring Boot 1.3的第一个里程碑版本将在几天后发布,包含许多