BN、LN、IN、GN的区别

一、Batch Normalization

卷积神经网络的出现,网络参数量大大减低,使得几十层的深层网络成为可能。然而,在残差网络出现之前,网络的加深使得网络训练变得非常不稳定,甚至出现网络长时间不更新甚至不收敛的现象,同时网络对超参数比较敏感,超参数的微量扰动也会导致网络的训练轨迹完全改变。

2015年,Google研究人员SergeyIoffe等提出了一种参数标准化(Normalize)的手段,并基于参数标准化设计了BatchNomalization(简写为BatchNorm,或BN)层。BN层的提出,使得网络的超参数的设定更加自由,比如更大的学习率、更随意的网络初始化等,同时网络的收敛速度更快,性能也更好。BN层提出后便广泛地应用在各种深度网络模型上,卷积层、BN层、ReLU层、池化层一度成为网络模型的标配单元块,通过堆叠ConvBN-ReLU-Pooling方式往往可以获得不错的模型性能。

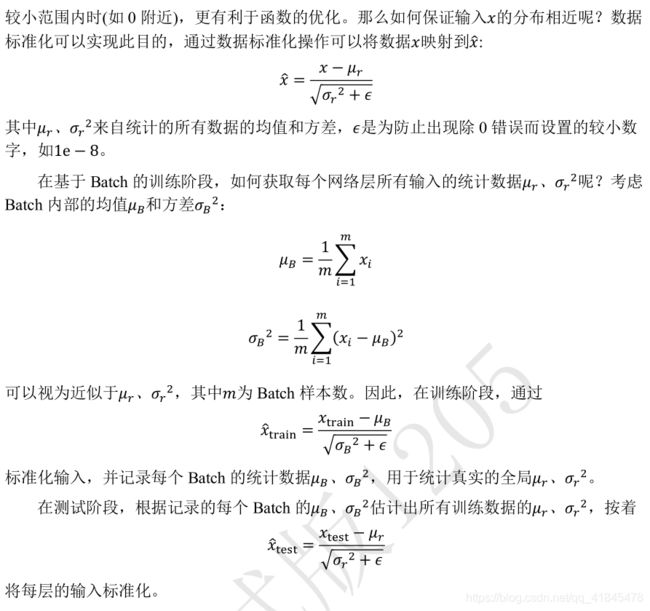

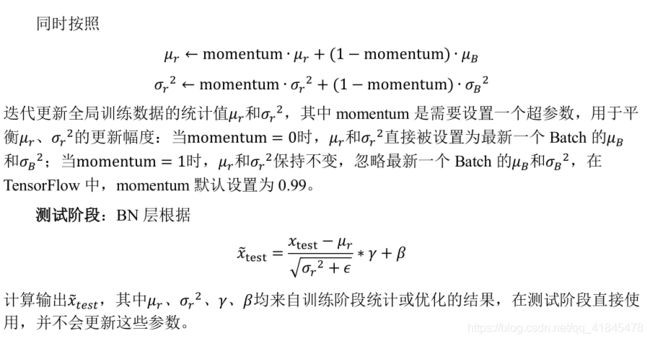

首先我们来探索,为什么需要对网络中的数据进行标准化操作?这个问题很难从理论层面解释透彻,即使是BN层的作者给出的解释也未必让所有人信服。与其纠结其缘由,不如通过具体问题来感受数据标准化后的好处。

考虑Sigmoid激活函数和它的梯度分布,如下图10.39所示,Sigmoid函数在x∈[−2, 2] 区间的导数值在[0.1, 0.25] 区间分布;当x > 2或 x < −2 时,Sigmoid函数的导数变得很小,逼近于0,从而容易出现梯度弥散现象。为了避免因为输入较大或者较小而导致Sigmoid函数出现梯度弥散现象,将函数输入 x 标准化映射到 0 附近的一段较小区间将变得非常重要,可以从图10.39看到,通过标准化重映射后,值被映射在0附近,此处的导数值不至于过小,从而不容易出现梯度弥散现象。这是使用标准化手段受益的一个例子。

我们再看另一个例子。考虑 2 个输入节点的线性模型,如图 10.40(a)所示:

L L L = a = x 1 w 1 + x 2 w 2 + b x_1w1 + x_2w2 + b x1w1+x2w2+b

讨论如下 2 种输入分布下的优化问题:

i ) i) i) 输入 x 1 ∈ [ 1 , 10 ] x_1\in[1, 10] x1∈[1,10], x 2 ∈ [ 1 , 10 ] x_2\in[1, 10] x2∈[1,10]

i i ) ii) ii) 输入 x 1 ∈ [ 1 , 10 ] x_1\in[1, 10] x1∈[1,10], x 2 ∈ [ 100 , 1000 ] x_2\in[100, 1000] x2∈[100,1000]

由于模型相对简单,可以绘制出2种 x 1 x_1 x1, x 2 x_2 x2 下,函数的损失等高线图,图10.40(b)是 x 1 ∈ [ 1 , 10 ] x_1\in[1, 10] x1∈[1,10], x 2 ∈ [ 100 , 1000 ] x_2\in[100, 1000] x2∈[100,1000] 时的某条优化轨迹线示意图,图10.40©是 x 1 ∈ [ 1 , 10 ] x_1\in[1, 10] x1∈[1,10], x 2 ∈ [ 1 , 10 ] x_2\in[1, 10] x2∈[1,10]时的某条优化轨迹线示意图,图中的圆环中心即为全局极值点。

二、BN、LN、IN、GN的区别

一、我们将输入的feature map shape 记为[N, C, H, W], N 表示batch size, C 表示通道数, H 和 W 分别表示高度和宽度, 区别:

i ) i) i) BN 是在 Batch 上,对N、H、W做归一化, BN对较小的batch size 效果不好,BN适用于固定深度的前向神经网络,如CNN,不适用与RNN。

i i ) ii) ii) LN 是在 通道方向上,对 C、H 、W做归一化, 统计每个样本的所有特征的均值和方差 ,主要对RNN效果明显。

i i i ) iii) iii) IN 是在图像像素上, 对H、W做归一化, 统计每个样本的每个通道上特征的均值和方差,用在风格化迁移。

i i i i ) iiii) iiii) GN 先将 C 通道分为若干组, 统计每个样本的通道组内的特征均值和方差

如果把特征图比喻成一摞书,这摞书总共有 N 本,每本有 C 页,每页有 H 行,每行 有W 个字符。

- BN 求均值时,相当于把这些书按页码一一对应地加起来(例如第1本书第36页,第2本书第36页…),再除以每个页码下的字符总数:N×H×W,因此可以把 BN 看成求“平均书”的操作(注意这个“平均书”每页只有一个字),求标准差时也是同理。

- LN 求均值时,相当于把每一本书的所有字加起来,再除以这本书的字符总数:C×H×W,即求整本书的“平均字”,求标准差时也是同理。

- IN 求均值时,相当于把一页书中所有字加起来,再除以该页的总字数:H×W,即求每页书的“平均字”,求标准差时也是同理。

- GN 相当于把一本 C 页的书平均分成 G 份,每份成为有 C/G 页的小册子,求每个小册子的“平均字”和字的“标准差”。