- OpenSIPS 邂逅 Kafka:构建高效 VoIP 消息处理架构

c_zyer

opensipsSIP消息队列kafkaopensipsvoip

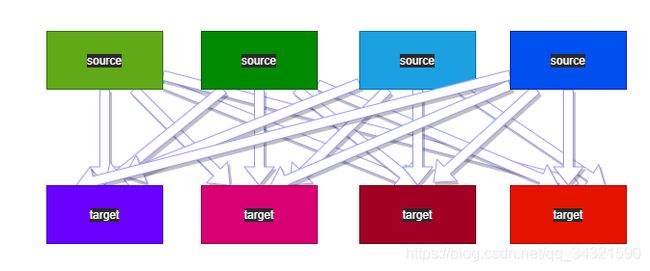

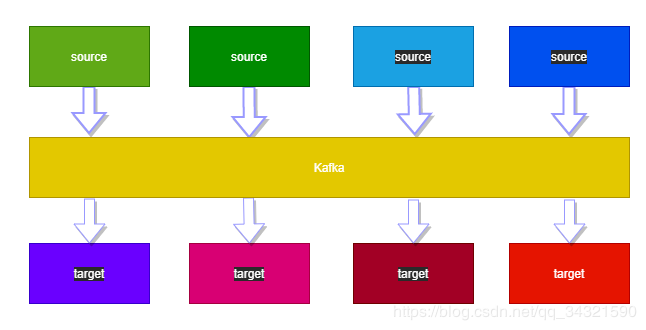

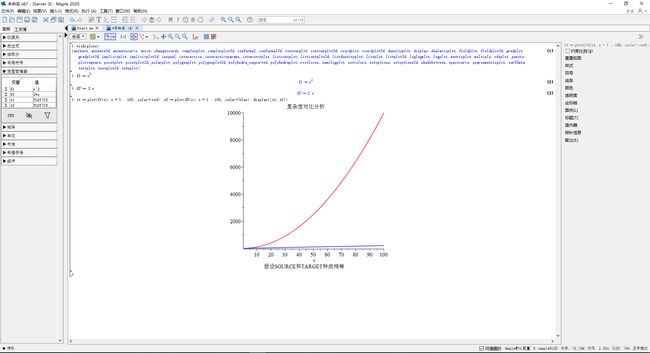

使用场景使用步骤引入模块组装&发送数据消费数据故障转移使用场景异步日志处理:将OpenSIPS中的SIP信令日志、通话记录(CDR)等数据发送到Kafka队列中。事件通知与监控:利用OpenSIPS的event_interface模块将SIP事件(如呼叫建立、断开、注册等)推送到KafkaOpenSIPS中事件接口有以下类型:EVENT_DATAGRAM-PublishJSON-RPCnotifi

- Kafka事务机制详解

一碗黄焖鸡三碗米饭

Kafka全景解析kafka分布式Java副本事务分区大数据

目录Kafka事务机制详解1.Kafka中的事务概述2.Kafka事务的基本概念2.1精确一次处理(ExactlyOnceSemantics,EOS)2.2Kafka事务的工作流程3.Kafka事务的配置与使用3.1生产者端的事务配置3.2消费者端的事务配置4.Kafka事务的优势与限制4.1Kafka事务的优势4.2Kafka事务的限制5.总结在分布式系统中,事务性操作(如数据库事务)是非常重要

- kafka的ISR机制详解

inori1256

kafka分布式

Kafka的ISR机制ISR(In-SyncReplicas同步副本集)机制是一种用于确保数据可靠性和一致性的重要机制。一、ISR的定义ISR是指与Kafka分区中的Leader副本保持同步的Follower副本集合。这些副本已经复制了Leader副本的所有数据,并且它们的落后时间在一定范围内,因此被认为是可靠的、可以用于故障转移和数据恢复的副本。二、ISR的作用数据复制:当消息被写入Kafka的

- 一句话读懂Kafka:5W1H带你解锁分布式消息队列的奥密

落霞归雁

AI编程教育电商微信开放平台rabbitmq中间件

一句话读懂Kafka:5W1H带你解锁分布式消息队列的奥秘在当今数字化时代,消息队列(MessageQueue,简称MQ)已经成为分布式系统中不可或缺的组件,而ApacheKafka作为其中的佼佼者,以其卓越的性能和广泛的应用场景脱颖而出。今天,就让我们用一句话读懂Kafka,并通过5W1H(What、Why、Who、When、Where、How)的方式,深入剖析它的核心价值与技术魅力。一句话读懂

- Kafka——两种集群搭建详解 k8s

Michaelwubo

kafka分布式

1、简介Kafka是一个能够支持高并发以及流式消息处理的消息中间件,并且Kafka天生就是支持集群的,今天就主要来介绍一下如何搭建Kafka集群。Kafka目前支持使用Zookeeper模式搭建集群以及KRaft模式(即无Zookeeper)模式这两种模式搭建集群,这两种模式各有各的好处,今天就来分别介绍一下这两种方式1.1、Kafka集群中的节点类型一个Kafka集群是由下列几种类型的节点构成的

- 零基础学习性能测试第九章:全链路追踪-系统中间件节点监控

试着

性能测试学习中间件性能测试零基础

目录一、为什么需要监控中间件节点?二、主流中间件监控方案1.监控体系架构2.监控工具矩阵三、环境搭建实战1.部署Prometheus2.部署Grafana四、中间件监控配置实战1.Nginx监控2.Redis监控3.Kafka监控4.MySQL监控五、全链路追踪中的中间件监控1.SkyWalking与Prometheus集成2.全链路视角的中间件监控六、性能瓶颈定位实战1.瓶颈分析流程图2.典型瓶

- Kafka 去 ZooKeeper 化实战:KRaft 架构高可用部署实践与运维提升之道

derek2026

部署实践kafka运维持续部署

Kafka去ZooKeeper化实战:KRaft架构高可用部署实践与运维提升之道一、为什么选择Kafka-Kraft架构?Kafka作为分布式消息系统的标杆,长期依赖ZooKeeper进行元数据管理。但Kafka-Kraft模式通过引入自管理的元数据仲裁机制,彻底摆脱了ZooKeeper依赖,带来三大核心优势:部署简化:减少运维组件,降低系统复杂度性能提升:元数据操作延迟降低40%稳定性增强:消除

- RocketMQ常见问题梳理

kk在加油

rocketmq

MQ常见问题深度剖析:消息不丢失、顺序性、幂等性与积压处理本文基于RocketMQ核心原理,结合Kafka/RabbitMQ对比,深入分析MQ四大核心问题解决方案一、消息不丢失保障机制消息丢失风险点跨网络传输:生产者→Broker、Broker→消费者、主从同步Broker缓存机制:PageCache异步刷盘导致数据未持久化极端故障:整个MQ集群宕机生产者保证方案1.发送确认机制//RocketM

- Flink Oracle CDC logminer ogg 对比, PDB logminer CDC 测试

维度FlinkCDC(主库)FlinkCDC(备库)Flinkconnector(Kafka)ADG(ActiveDataGuard)同步机制基于LogMiner解析RedoLog需通过OGG同步备库基于LogMiner解析RedoLog需通过OGG捕获日志后写入Kafka物理复制,主备数据块一致架构特点需直连主库独立进程,低侵入性独立进程,低侵入性仅支持查询,无法捕获实时变更数据链路oracle

- kafka的消息存储机制和查询机制

不辉放弃

kafka大数据开发数据库pyspark

Kafka作为高性能的分布式消息队列,其消息存储机制和查询机制是保证高吞吐、低延迟的核心。以下从存储机制和查询机制两方面详细讲解,包含核心原理、关键组件及工作流程。一、Kafka消息存储机制Kafka的消息存储机制围绕高可用、高吞吐、可扩展设计,核心是通过分区、副本、日志分段和索引实现高效存储与管理。1.基本组织单位:主题(Topic)与分区(Partition)主题(Topic):消息的逻辑容器

- 【kafka4源码学习系列】kafka4总体架构介绍

oraen

学习kafka架构

二kafka架构介绍学习一个系统之前很重要的一点就是先了解这个系统整体的架构,这能够使我们对整个系统有个总体的认识,清楚地知道这个系统有什么能力。这不仅帮助我们学习时快速定位到我们想要的内容,还能避免我们学习过程中在庞大的系统中迷失自己。所以首先我会介绍一下kafka的整体架构,包括这个kafka系统的整体架构,模块组成,模块的功能以及模块之间关系,以及各个模块之间是怎么共同构成这套系统的。kaf

- ogg同步Kafka到oracle,ORACLE OGG同步到KAFKA

ORACLEOGG同步到KAFKA1、介绍Kafka是一种高效的消息队列实现,经过订阅kafka的消息队列,下游系统能够实时获取在线Oracle系统的数据变动状况,实现业务系统javaogg同步全量数据方式:①经过数据泵方式基于SCN导出并导入到目标端,此方式用于Oracle到Oracle的ogg同步环境中。②经过ogg自己的初始化方式,初始化全量数据到目标端,此方式通用于全部环境,可是速度相对较

- oracle ogg 全量 增量,1.利用ogg实现oracle到kafka的增量数据实时同步.md

##利用ogg实现oracle到kafka的增量数据实时同步####前言>ogg即OracleGoldenGate是Oracle的同步工具,本文讲如何配置ogg以实现Oracle数据库增量数据实时同步到kafka中,其中同步消息格式为json。下面是源端和目标端的一些配置信息:|--|版本|OGG版本|IP|别名||:---------|:--:|-----------:|:-----------

- 第四篇:深入探讨Kafka消费者的架构和原理

Gemini技术窝

kafka架构java后端中间件

大家好!今天我们要深入探讨Kafka消费者的架构和原理。Kafka消费者是从Kafka集群中读取消息的客户端应用,其设计和实现直接影响消息处理的效率和可靠性。本文将介绍Kafka消费者和消费者组的原理和作用,使用示例代码和源码剖析消费者的参数和功能,并详细介绍Kafka消费者如何订阅主题和分区。希望通过这篇文章,你能全面理解Kafka消费者的工作机制。准备好了吗?让我们开始吧!文章目录一、Kafk

- Kafka消费者负载均衡策略

⼀个消费者组中的⼀个分⽚对应⼀个消费者成员,他能保证每个消费者成员都能访问,如果组中成员太多会有空闲的成员Kafka消费者负载均衡策略详解从分区分配算法到Rebalance机制,全面解析Kafka如何实现消费者间的负载均衡,并提供调优建议和问题解决方案。1.核心概念术语作用类比ConsumerGroup共享消费任务的消费者组外卖骑手团队PartitionTopic的物理分片配送区域划分Rebala

- 狂神说Linux笔记

是你牛天成

项目部署linux

B站视频狂神说LinuxJava开发之路:JavaSE,MySQL,前端(html,css,js),javaweb,SSM框架,SpringBootvue,SpringCloud,(mybatis-plusgit)LinuxLinux操作系统:Window、Mac消息队列(Kafka,RabbitMQ,RockeetMQ)缓存(Redis)搜索引擎(ElasticSearch)集群分布式(需要购买

- Kafka消费者负载均衡和数据积压问题

抱紧大佬大腿不松开

kafka负载均衡分布式大数据

在大数据领域中,ApacheKafka是一个常用的分布式消息队列系统,它被广泛应用于实时数据处理和流式数据处理场景。Kafka的消费者负载均衡机制和数据积压问题是使用Kafka时需要关注和解决的重要议题。消费者负载均衡机制是指如何将消息分配给多个消费者,以实现高吞吐量和高可扩展性。Kafka通过使用消费者组(consumergroup)的概念来实现负载均衡。一个消费者组可以包含多个消费者,每个消费

- kafka的消费者负载均衡机制

不辉放弃

kafka负载均衡分布式数据库

Kafka的消费者负载均衡机制是保证消息高效消费的核心设计,通过将分区合理分配给消费者组内的消费者,实现并行处理和负载均衡。以下从核心概念、分配策略、重平衡机制等方面详细讲解。一、核心概念理解消费者负载均衡前,需明确三个关键概念:消费者组(ConsumerGroup)多个消费者组成的逻辑组,共同消费一个或多个主题的消息。组内消费者共享一个group.id标识,Kafka通过该标识区分不同消费组。分

- 实时流式计算

实时流式计算一般流式计算会与批量计算相比较。在流式计算模型中,输入是持续的,可以认为在时间上是无界的,也就意味着,永远拿不到全量数据去做计算。同时,计算结果是持续输出的,也即计算结果在时间上也是无界的。流式计算一般对实时性要求较高,同时一般是先定义目标计算,然后数据到来之后将计算逻辑应用于数据。同时为了提高计算效率,往往尽可能采用增量计算代替全量计算。KafkaStreamKafkaStream是

- 数据科学与大数据技术专业的核心课程体系及发展路径全解析

YangYang9YangYan

大数据

CDA数据分析师证书含金量高,适应了未来数字化经济和AI发展趋势,难度不高,行业认可度高,对于找工作很有帮助。一、课程体系三维地图二、核心课程能力矩阵课程模块关键技能行业应用场景工具链分布式计算Spark调优用户行为日志分析AWSEMR/Databricks数据挖掘特征工程金融反欺诈模型Scikit-learn实时数据处理Flink窗口计算物联网设备监控Kafka+Flink数据治理元数据管理企业

- Kafka MQ 消费者应用场景

二六八

MQ消息队列kafkalinq分布式java

KafkaMQ消费者应用场景1消费者自动提交的时机在Kafka中默认的消费位移的提交方式是自动提交,这个由消费者客户端参数enable.auto.commit配置,默认值为true。当然这个默认的自动提交不是每消费一条消息就提交一次,而是定期提交,这个定期的周期时间由客户端参数auto.commit.interval.ms配置,默认值为5秒,此参数生效的前提是enable.auto.commit参

- Oracle数据发送到kafka传输数据

Oracle数据发送到kafka传输数据配置OGGADPATERFORKAFKA需要的kafka包:Kafka0.8.2.1kafka-clients-0.8.2.1.jarlz4-1.2.0.jarslf4j-api-1.7.6.jarsnappy-java-1.1.1.6.jar#######配置OGG主库dbloginuseridgoldengate,passwordoggpassworda

- Kafka分区副本分配规则

罗纳尔光

Kafkakafkajava分区副本机架扩缩分区

Kafka分区副本分配规则文章目录Kafka分区副本分配规则1、前言2、自动分配a.无机架方式分配b.有机架方式分配(1)机架介绍(2)有机架方式分配的目的(3)分配规则c.问题3、指定分配规则分配参考文献1、前言 我们在创建topic或者是新增分区时,如果不指定分区副本的分配方式,Kafka会自动帮我们分配,那Kafka是如何帮我们分配的呢?我们如果指定分区副本的分配方式,Kafka会做哪些事情

- Python领域Tornado的消息队列集成

PythonAI编程架构实战家

Python编程之道pythontornado开发语言ai

Python领域Tornado的消息队列集成关键词:Tornado、消息队列、异步编程、集成架构、高性能、微服务、事件驱动摘要:本文深入探讨如何在Tornado框架中高效集成消息队列,解决高并发场景下的异步通信问题。通过解析Tornado的异步IO模型与消息队列的核心原理,结合RabbitMQ、Kafka等主流队列的集成案例,详细演示异步生产者/消费者的实现方法,涵盖性能优化、异常处理和实战应用。

- java kafka监听,使用非注解形式的javaConfig配置进行kafka消息监听

幻想青年卢六六

javakafka监听

最近在做平台的kafka消息监听的改造,以前用的是平台自己封装jar,现在统一改用spring-kafka.jar,这样的好处是减少特殊处理,便于统一维护。以下是配置:importjava.util.*;/***@Description:kafka配置类*@Author:LiuBing*@Date:13:422018/9/12*/@ConfigurationpublicclassKafkaConf

- Kafka——多线程开发消费者实例

引言在分布式系统领域,Kafka凭借高吞吐量、低延迟的特性成为消息队列的事实标准。随着硬件技术的飞速发展,服务器多核CPU已成常态——一台普通的云服务器动辄配备16核、32核甚至更多核心。然而,KafkaJavaConsumer的设计却长期保持着"单线程"的核心架构,这看似与硬件发展趋势相悖的设计背后,隐藏着怎样的考量?当我们面对每秒数十万条消息的处理需求时,单线程消费的瓶颈会愈发明显:消息堆积、

- 【方案白嫖】Kafka如何监听动态改变的topic

橙皇cc

Kafkajavakafkaspring数据库

问题简述:服务运行过程中,需要根据实际情况(配置)动态改变监听的topic。方案一:如果想改变的topic可以符合一定的规则,能做到正则限定范围,在限定的范围内变动,可以直接配置KafkaListener监听正则规则。@Configuration@EnableKafkapublicclassKafkaConfig{privatestaticfinalStringKAFKA_SERVERS_CONF

- prometheus + kafka_exporter监听kafka

一、下载kafka_exporter安装包1、本地下载后上传到linux服务器下载地址:https://github.com/danielqsj/kafka_exporter/releases/2、直接在linux服务器上wget方式下载#进入目标目录cd/data/prometheus#下载wgethttps://github.com/danielqsj/kafka_exporter/relea

- 2022-08-05 Kafka Shell操作

一、Kafka提供的shell操作命令下面只列出常用选项,其他选项请参考官方文档1.kafka-topics.sh(1)语法kafka-topics.sh--bootstrap-serverhost1:port1,...--(list|describe|create|alter|delete)[--可选选项](2)必要选项选项名描述bootstrap-serverhost1:prot1,...指定

- kafka如何保证数据不丢失

不辉放弃

kafka数据库大数据开发pyspark

下面我将使用Python代码示例,从生产者、集群和消费者三个层面详细讲解Kafka如何保证数据不丢失。我们将使用kafka-python库来实现相关功能。一、生产者层面的数据不丢失保证生产者通过配置确认机制、重试策略和幂等性来确保数据不丢失。fromkafkaimportKafkaProducerfromkafka.errorsimportKafkaErrorimporttimedefcreate

- java封装继承多态等

麦田的设计者

javaeclipsejvmcencapsulatopn

最近一段时间看了很多的视频却忘记总结了,现在只能想到什么写什么了,希望能起到一个回忆巩固的作用。

1、final关键字

译为:最终的

&

- F5与集群的区别

bijian1013

weblogic集群F5

http请求配置不是通过集群,而是F5;集群是weblogic容器的,如果是ejb接口是通过集群。

F5同集群的差别,主要还是会话复制的问题,F5一把是分发http请求用的,因为http都是无状态的服务,无需关注会话问题,类似

- LeetCode[Math] - #7 Reverse Integer

Cwind

java题解MathLeetCodeAlgorithm

原题链接:#7 Reverse Integer

要求:

按位反转输入的数字

例1: 输入 x = 123, 返回 321

例2: 输入 x = -123, 返回 -321

难度:简单

分析:

对于一般情况,首先保存输入数字的符号,然后每次取输入的末位(x%10)作为输出的高位(result = result*10 + x%10)即可。但

- BufferedOutputStream

周凡杨

首先说一下这个大批量,是指有上千万的数据量。

例子:

有一张短信历史表,其数据有上千万条数据,要进行数据备份到文本文件,就是执行如下SQL然后将结果集写入到文件中!

select t.msisd

- linux下模拟按键输入和鼠标

被触发

linux

查看/dev/input/eventX是什么类型的事件, cat /proc/bus/input/devices

设备有着自己特殊的按键键码,我需要将一些标准的按键,比如0-9,X-Z等模拟成标准按键,比如KEY_0,KEY-Z等,所以需要用到按键 模拟,具体方法就是操作/dev/input/event1文件,向它写入个input_event结构体就可以模拟按键的输入了。

linux/in

- ContentProvider初体验

肆无忌惮_

ContentProvider

ContentProvider在安卓开发中非常重要。与Activity,Service,BroadcastReceiver并称安卓组件四大天王。

在android中的作用是用来对外共享数据。因为安卓程序的数据库文件存放在data/data/packagename里面,这里面的文件默认都是私有的,别的程序无法访问。

如果QQ游戏想访问手机QQ的帐号信息一键登录,那么就需要使用内容提供者COnte

- 关于Spring MVC项目(maven)中通过fileupload上传文件

843977358

mybatisspring mvc修改头像上传文件upload

Spring MVC 中通过fileupload上传文件,其中项目使用maven管理。

1.上传文件首先需要的是导入相关支持jar包:commons-fileupload.jar,commons-io.jar

因为我是用的maven管理项目,所以要在pom文件中配置(每个人的jar包位置根据实际情况定)

<!-- 文件上传 start by zhangyd-c --&g

- 使用svnkit api,纯java操作svn,实现svn提交,更新等操作

aigo

svnkit

原文:http://blog.csdn.net/hardwin/article/details/7963318

import java.io.File;

import org.apache.log4j.Logger;

import org.tmatesoft.svn.core.SVNCommitInfo;

import org.tmateso

- 对比浏览器,casperjs,httpclient的Header信息

alleni123

爬虫crawlerheader

@Override

protected void doGet(HttpServletRequest req, HttpServletResponse res) throws ServletException, IOException

{

String type=req.getParameter("type");

Enumeration es=re

- java.io操作 DataInputStream和DataOutputStream基本数据流

百合不是茶

java流

1,java中如果不保存整个对象,只保存类中的属性,那么我们可以使用本篇文章中的方法,如果要保存整个对象 先将类实例化 后面的文章将详细写到

2,DataInputStream 是java.io包中一个数据输入流允许应用程序以与机器无关方式从底层输入流中读取基本 Java 数据类型。应用程序可以使用数据输出流写入稍后由数据输入流读取的数据。

- 车辆保险理赔案例

bijian1013

车险

理赔案例:

一货运车,运输公司为车辆购买了机动车商业险和交强险,也买了安全生产责任险,运输一车烟花爆竹,在行驶途中发生爆炸,出现车毁、货损、司机亡、炸死一路人、炸毁一间民宅等惨剧,针对这几种情况,该如何赔付。

赔付建议和方案:

客户所买交强险在这里不起作用,因为交强险的赔付前提是:“机动车发生道路交通意外事故”;

如果是交通意外事故引发的爆炸,则优先适用交强险条款进行赔付,不足的部分由商业

- 学习Spring必学的Java基础知识(5)—注解

bijian1013

javaspring

文章来源:http://www.iteye.com/topic/1123823,整理在我的博客有两个目的:一个是原文确实很不错,通俗易懂,督促自已将博主的这一系列关于Spring文章都学完;另一个原因是为免原文被博主删除,在此记录,方便以后查找阅读。

有必要对

- 【Struts2一】Struts2 Hello World

bit1129

Hello world

Struts2 Hello World应用的基本步骤

创建Struts2的Hello World应用,包括如下几步:

1.配置web.xml

2.创建Action

3.创建struts.xml,配置Action

4.启动web server,通过浏览器访问

配置web.xml

<?xml version="1.0" encoding="

- 【Avro二】Avro RPC框架

bit1129

rpc

1. Avro RPC简介 1.1. RPC

RPC逻辑上分为二层,一是传输层,负责网络通信;二是协议层,将数据按照一定协议格式打包和解包

从序列化方式来看,Apache Thrift 和Google的Protocol Buffers和Avro应该是属于同一个级别的框架,都能跨语言,性能优秀,数据精简,但是Avro的动态模式(不用生成代码,而且性能很好)这个特点让人非常喜欢,比较适合R

- lua set get cookie

ronin47

lua cookie

lua:

local access_token = ngx.var.cookie_SGAccessToken

if access_token then

ngx.header["Set-Cookie"] = "SGAccessToken="..access_token.."; path=/;Max-Age=3000"

end

- java-打印不大于N的质数

bylijinnan

java

public class PrimeNumber {

/**

* 寻找不大于N的质数

*/

public static void main(String[] args) {

int n=100;

PrimeNumber pn=new PrimeNumber();

pn.printPrimeNumber(n);

System.out.print

- Spring源码学习-PropertyPlaceholderHelper

bylijinnan

javaspring

今天在看Spring 3.0.0.RELEASE的源码,发现PropertyPlaceholderHelper的一个bug

当时觉得奇怪,上网一搜,果然是个bug,不过早就有人发现了,且已经修复:

详见:

http://forum.spring.io/forum/spring-projects/container/88107-propertyplaceholderhelper-bug

- [逻辑与拓扑]布尔逻辑与拓扑结构的结合会产生什么?

comsci

拓扑

如果我们已经在一个工作流的节点中嵌入了可以进行逻辑推理的代码,那么成百上千个这样的节点如果组成一个拓扑网络,而这个网络是可以自动遍历的,非线性的拓扑计算模型和节点内部的布尔逻辑处理的结合,会产生什么样的结果呢?

是否可以形成一种新的模糊语言识别和处理模型呢? 大家有兴趣可以试试,用软件搞这些有个好处,就是花钱比较少,就算不成

- ITEYE 都换百度推广了

cuisuqiang

GoogleAdSense百度推广广告外快

以前ITEYE的广告都是谷歌的Google AdSense,现在都换成百度推广了。

为什么个人博客设置里面还是Google AdSense呢?

都知道Google AdSense不好申请,这在ITEYE上也不是讨论了一两天了,强烈建议ITEYE换掉Google AdSense。至少,用一个好申请的吧。

什么时候能从ITEYE上来点外快,哪怕少点

- 新浪微博技术架构分析

dalan_123

新浪微博架构

新浪微博在短短一年时间内从零发展到五千万用户,我们的基层架构也发展了几个版本。第一版就是是非常快的,我们可以非常快的实现我们的模块。我们看一下技术特点,微博这个产品从架构上来分析,它需要解决的是发表和订阅的问题。我们第一版采用的是推的消息模式,假如说我们一个明星用户他有10万个粉丝,那就是说用户发表一条微博的时候,我们把这个微博消息攒成10万份,这样就是很简单了,第一版的架构实际上就是这两行字。第

- 玩转ARP攻击

dcj3sjt126com

r

我写这片文章只是想让你明白深刻理解某一协议的好处。高手免看。如果有人利用这片文章所做的一切事情,盖不负责。 网上关于ARP的资料已经很多了,就不用我都说了。 用某一位高手的话来说,“我们能做的事情很多,唯一受限制的是我们的创造力和想象力”。 ARP也是如此。 以下讨论的机子有 一个要攻击的机子:10.5.4.178 硬件地址:52:54:4C:98

- PHP编码规范

dcj3sjt126com

编码规范

一、文件格式

1. 对于只含有 php 代码的文件,我们将在文件结尾处忽略掉 "?>" 。这是为了防止多余的空格或者其它字符影响到代码。例如:<?php$foo = 'foo';2. 缩进应该能够反映出代码的逻辑结果,尽量使用四个空格,禁止使用制表符TAB,因为这样能够保证有跨客户端编程器软件的灵活性。例

- linux 脱机管理(nohup)

eksliang

linux nohupnohup

脱机管理 nohup

转载请出自出处:http://eksliang.iteye.com/blog/2166699

nohup可以让你在脱机或者注销系统后,还能够让工作继续进行。他的语法如下

nohup [命令与参数] --在终端机前台工作

nohup [命令与参数] & --在终端机后台工作

但是这个命令需要注意的是,nohup并不支持bash的内置命令,所

- BusinessObjects Enterprise Java SDK

greemranqq

javaBOSAPCrystal Reports

最近项目用到oracle_ADF 从SAP/BO 上调用 水晶报表,资料比较少,我做一个简单的分享,给和我一样的新手 提供更多的便利。

首先,我是尝试用JAVA JSP 去访问的。

官方API:http://devlibrary.businessobjects.com/BusinessObjectsxi/en/en/BOE_SDK/boesdk_ja

- 系统负载剧变下的管控策略

iamzhongyong

高并发

假如目前的系统有100台机器,能够支撑每天1亿的点击量(这个就简单比喻一下),然后系统流量剧变了要,我如何应对,系统有那些策略可以处理,这里总结了一下之前的一些做法。

1、水平扩展

这个最容易理解,加机器,这样的话对于系统刚刚开始的伸缩性设计要求比较高,能够非常灵活的添加机器,来应对流量的变化。

2、系统分组

假如系统服务的业务不同,有优先级高的,有优先级低的,那就让不同的业务调用提前分组

- BitTorrent DHT 协议中文翻译

justjavac

bit

前言

做了一个磁力链接和BT种子的搜索引擎 {Magnet & Torrent},因此把 DHT 协议重新看了一遍。

BEP: 5Title: DHT ProtocolVersion: 3dec52cb3ae103ce22358e3894b31cad47a6f22bLast-Modified: Tue Apr 2 16:51:45 2013 -070

- Ubuntu下Java环境的搭建

macroli

java工作ubuntu

配置命令:

$sudo apt-get install ubuntu-restricted-extras

再运行如下命令:

$sudo apt-get install sun-java6-jdk

待安装完毕后选择默认Java.

$sudo update- alternatives --config java

安装过程提示选择,输入“2”即可,然后按回车键确定。

- js字符串转日期(兼容IE所有版本)

qiaolevip

TODateStringIE

/**

* 字符串转时间(yyyy-MM-dd HH:mm:ss)

* result (分钟)

*/

stringToDate : function(fDate){

var fullDate = fDate.split(" ")[0].split("-");

var fullTime = fDate.split("

- 【数据挖掘学习】关联规则算法Apriori的学习与SQL简单实现购物篮分析

superlxw1234

sql数据挖掘关联规则

关联规则挖掘用于寻找给定数据集中项之间的有趣的关联或相关关系。

关联规则揭示了数据项间的未知的依赖关系,根据所挖掘的关联关系,可以从一个数据对象的信息来推断另一个数据对象的信息。

例如购物篮分析。牛奶 ⇒ 面包 [支持度:3%,置信度:40%] 支持度3%:意味3%顾客同时购买牛奶和面包。 置信度40%:意味购买牛奶的顾客40%也购买面包。 规则的支持度和置信度是两个规则兴

- Spring 5.0 的系统需求,期待你的反馈

wiselyman

spring

Spring 5.0将在2016年发布。Spring5.0将支持JDK 9。

Spring 5.0的特性计划还在工作中,请保持关注,所以作者希望从使用者得到关于Spring 5.0系统需求方面的反馈。